Curno, Mirjam ; Oeben, Stephanie «Scientific Excellence at Scale: Open Access journals have a clear citation advantage over subscription journals» Frontiers, 2018

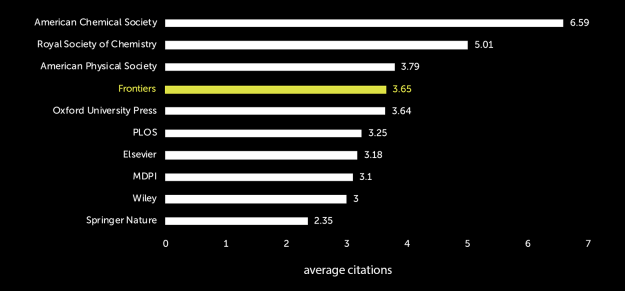

Frontiers es el cuarto editor más citado entre los 20 mayores editores, clasificados por el promedio de citas en un período de tres años (2015-2017). El mismo análisis también revela una ventaja de las revistas de acceso abierto sobre las revistas de suscripción en los últimos tres años.

En 2017, el 16% de los artículos revisados por pares de todo el mundo se publicaron en revistas de acceso totalmente abierto, según SCImago (2018). Después de más de dos décadas de la revolución del Acceso Abierto, esto está muy lejos del aspirado 100% . Una de las muchas razones por las que la transición al acceso abierto resultó ser tan difícil es el debate sobre si el acceso abierto puede producir excelencia científica.

En este post de blog se realiza un análisis de revistas contrastando revistas de acceso abierto y revistas de suscripción basadas en datos de SCImago (2018, los datos de SCImago se basan en la base de datos Scopus de Elsevier). El conjunto de datos completo está disponible en Figshare. Estos datos fueron presentados en el EuroScience Open Forum 2018, aquí dispones del powerpoint y la videoconferencia.

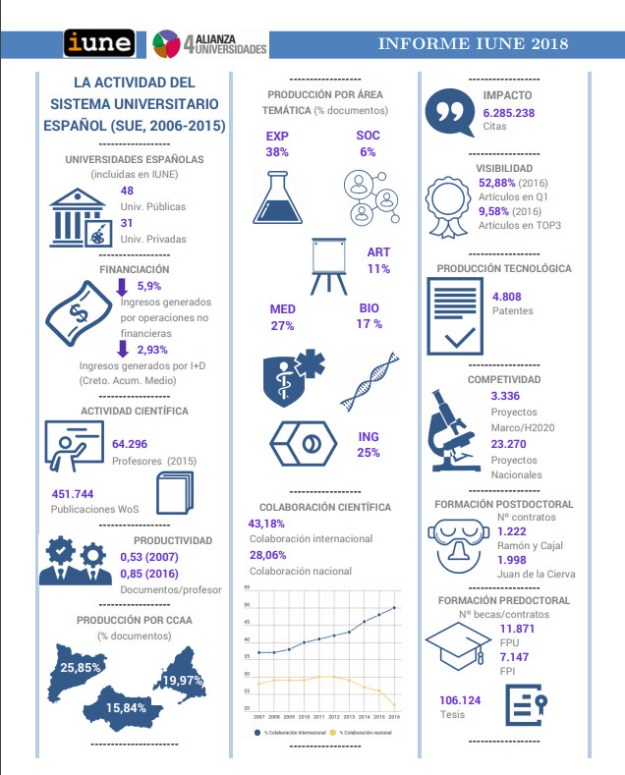

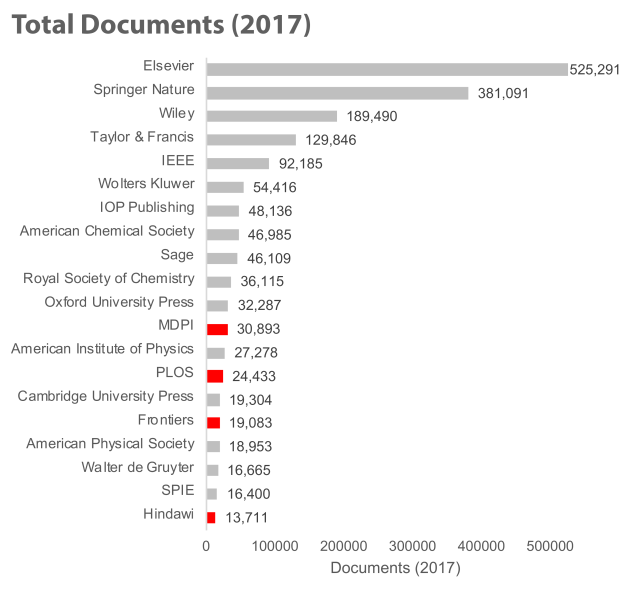

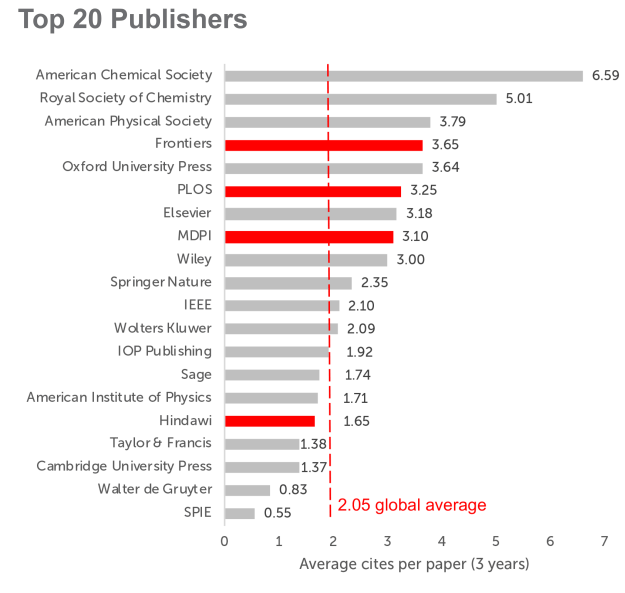

En 2017, cuatro de los 20 mayores editores son editores de acceso abierto (Figura 1), 16 son editores de suscripción tradicionales con una gama de revistas de suscripción, híbridas y de acceso abierto.

Figura 1. Los 20 primeros editores por volumen en 2017 en SCImago (2018), En rojo son editores de Acceso Abierto completo.

Si se observa la media de citas en un período de tres años (2015-2017) entre los 20 mayores editores, el rendimiento de los editores de acceso totalmente abierto es notable (Figura 2).

Figura 2. Promedio de citas por artículo, de los artículos publicados en 2015, 2016 y 2017 para los 20 principales editores en 2017 (SCImago, 2018). En rojo están todos los editores de acceso abierto

Frontiers ocupa el cuarto lugar entre los 20 editores más importantes por el promedio de citas por artículo publicado entre 2015 y 2017. La tasa de citación media de Frontiers es de 3,65 por artículo y muy por encima de la media de 2,7 para las revistas de suscripción y 2,9 para las de acceso abierto. Entre los editores clasificados, sólo las sociedades científicas especializadas en un campo único y muy citado, como la química o la física, ocupan un lugar más destacado. Entre los editores multidisciplinarios, Frontiers tiene la tasa de citación media más alta.

Otros editores de acceso totalmente abierto también se sitúan por encima de la media en las tasas de citación: PLOS ocupa el sexto lugar con una tasa de citación promedio de 3.25 y MDPI el octavo con una tasa de citación promedio de 3.10 (Figura 2).

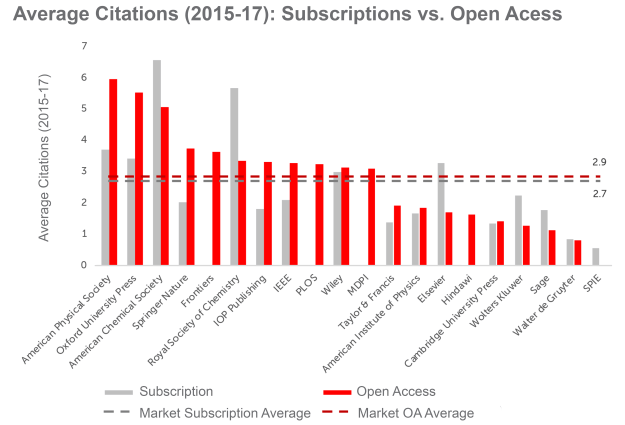

En general, a lo largo de los últimos tres años, las revistas de acceso abierto reciben en promedio un 7% más de citas que las revistas de suscripción (Figura 3). Curiosamente, las revistas de acceso abierto publicadas por editores de suscripción tradicionales están logrando en general un mayor impacto dentro del mismo editor.

Figura 3. Promedio de citas por artículo en un período de tres años (2015-17) para los 20 principales editores en 2017 en SCImago (2018),

Si desglosamos las revistas de acceso abierto y de suscripción de esos 20 editores, las revistas de acceso abierto tienen una ventaja en las citas, con una media de 2,9 citas por artículo para las revistas de acceso abierto frente a 2,7 citas por artículo para las revistas de suscripción (incluidos los híbridos, Figura 3).

Mientras que 10 de las 16 editoriales tradicionales muestran una clara ventaja de citas para sus revistas de acceso abierto, hay algunas variaciones, que probablemente reflejen estrategias diferentes con los títulos, así como la posición de los editores en términos del contenido que atraen.

Estos resultados están en línea con un reciente Libro Blanco publicado por Springer Nature y Digital Science, que demostró una clara ventaja de los artículos de acceso abierto sobre los artículos de pago en revistas de suscripción híbridas. Los artículos publicados en el formato de acceso abierto fueron 1,6 veces más citados que los artículos de pago en las mismas revistas.

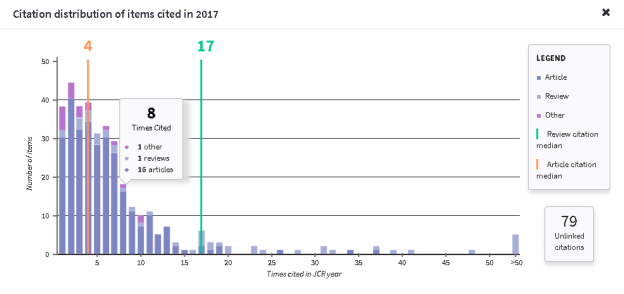

Los hallazgos también están en línea con la ventaja de las citas de las revistas en Frontiers Open Access journals in the 2017 Journal Citation Reports and 2017 CiteSc

Muchos han apreciado los beneficios de la Ciencia Abierta para la sociedad; el descubrimiento, la innovación, el crecimiento económico y el acceso público al conocimiento científico. Estos datos ahora muestran claramente que las revistas de acceso abierto superan a las revistas de suscripción tradicionales en las métricas de citas y ofrecen un mejor impacto para los autores.