Peters, Jay. 2026. “AI Research Papers Are Getting Better, and It’s a Big Problem for Scientists.” The Verge, mayo de 2026. https://www.theverge.com/ai-artificial-intelligence/930522/ai-research-papers-slop-peer-review-problem

Se analiza una creciente preocupación dentro de la comunidad científica internacional: la expansión de artículos académicos generados parcial o totalmente mediante inteligencia artificial y el impacto que este fenómeno está teniendo sobre el sistema de revisión por pares. Lo que hace apenas dos años se identificaba fácilmente como “AI slop” —textos plagados de errores, referencias inventadas y frases incoherentes— ha evolucionado rápidamente hacia trabajos aparentemente sofisticados, bien redactados y difíciles de detectar incluso para expertos. Investigadores y editores científicos advierten que la automatización masiva de la escritura académica amenaza con saturar los mecanismos tradicionales de validación científica.

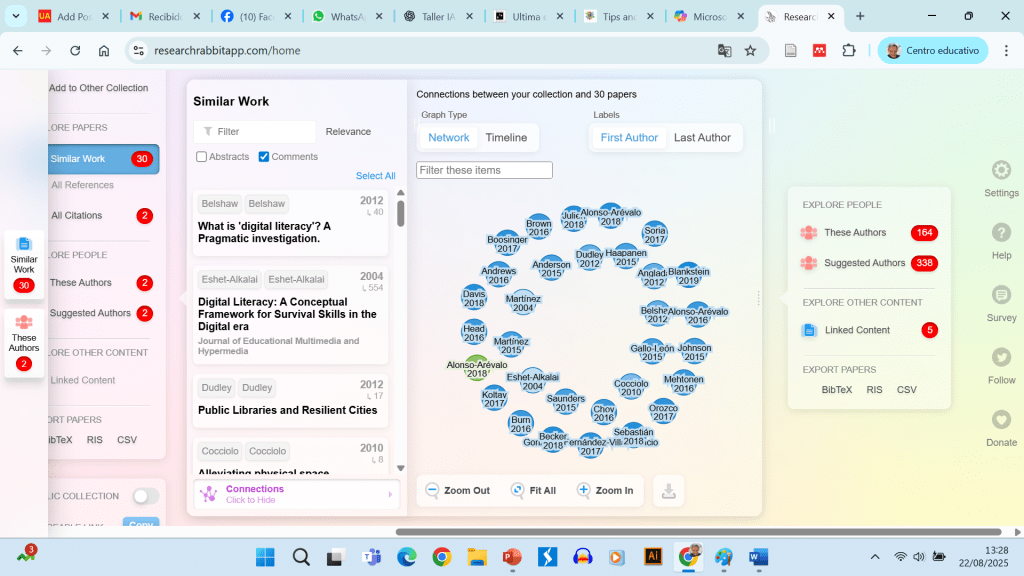

El reportaje explica que los modelos de lenguaje actuales son capaces de producir artículos completos en cuestión de minutos utilizando bases de datos públicas, gráficos automatizados y síntesis bibliográficas generadas algorítmicamente. Herramientas agentivas de IA permiten ya redactar hipótesis, construir marcos teóricos, producir análisis estadísticos e incluso responder automáticamente a comentarios de revisores. El problema no reside únicamente en la existencia de errores, sino en la enorme escala de producción. Según varios investigadores citados, la IA puede generar trabajos mucho más rápido de lo que los científicos humanos pueden leerlos o evaluarlos.

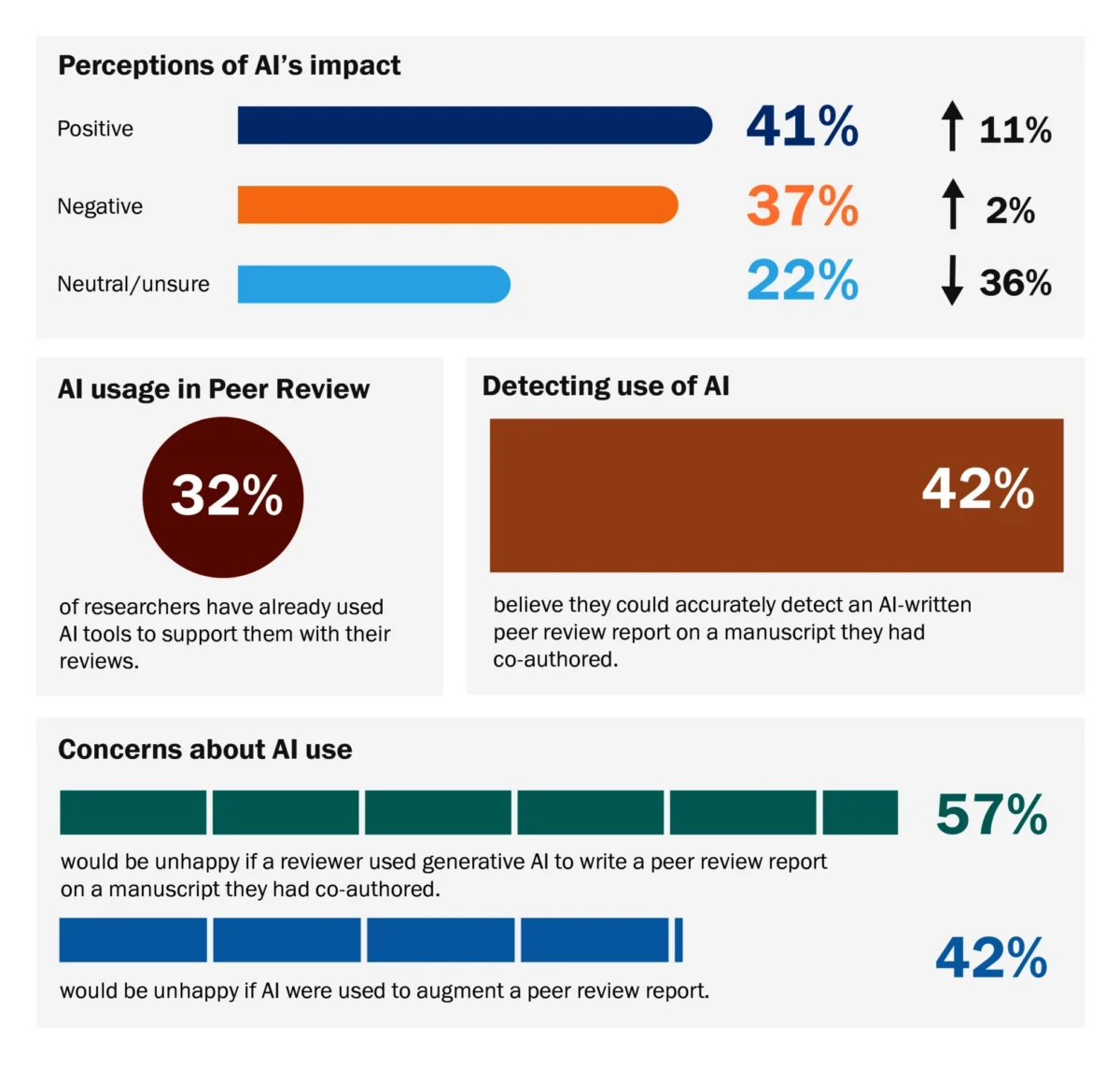

Uno de los aspectos más preocupantes es el deterioro progresivo del sistema de revisión por pares, históricamente considerado uno de los pilares de la credibilidad científica. Revisores y editores describen un entorno cada vez más difícil de gestionar debido al incremento de manuscritos redundantes, superficiales o engañosos. El artículo señala que muchos de estos textos utilizan lenguaje técnico convincente y estructuras académicas correctas, pero aportan escaso valor científico real. Esto obliga a los revisores a invertir más tiempo verificando datos, referencias y metodologías. La carga de trabajo se multiplica mientras la calidad media de las contribuciones disminuye.

La situación ha llevado a plataformas científicas a adoptar medidas drásticas. El repositorio científico arXiv anunció recientemente que prohibirá durante un año a los autores que publiquen trabajos con evidencia clara de contenido generado por IA no verificado, incluyendo referencias inventadas o comentarios residuales dejados por modelos lingüísticos. Además, quienes sean sancionados deberán demostrar posteriormente que sus investigaciones han sido aceptadas en publicaciones revisadas por pares antes de poder volver a subir artículos a la plataforma. Esta decisión refleja la preocupación institucional por preservar la confianza y la integridad académica en un contexto de creciente automatización textual.

El artículo también subraya que la crisis no puede entenderse únicamente como un problema tecnológico, sino como una consecuencia de las propias dinámicas estructurales del sistema académico contemporáneo. La presión por publicar, conseguir financiación y mantener productividad científica favorece comportamientos donde la cantidad de publicaciones se valora más que la calidad o la originalidad. La IA amplifica estas dinámicas al reducir drásticamente el coste y el tiempo necesarios para producir artículos. Algunos expertos comparan la situación con una “tragedia de los comunes”: cada investigador obtiene beneficios individuales al aumentar su productividad mediante IA, pero colectivamente el ecosistema científico se degrada debido a la saturación y pérdida de confianza.

Otro problema destacado es la aparición de errores sofisticados difíciles de detectar. Investigaciones recientes muestran que incluso conferencias científicas de alto prestigio han aceptado trabajos con referencias completamente inventadas generadas por IA. Estos fallos no siempre resultan evidentes porque los modelos producen citas plausibles, nombres verosímiles y estructuras metodológicas aparentemente coherentes. El riesgo no es solo la publicación de investigaciones deficientes, sino la contaminación progresiva del propio ecosistema científico con datos falsos, referencias inexistentes y conocimiento difícilmente verificable.

Paradójicamente, mientras algunos sectores intentan frenar el “AI slop”, otros comienzan a utilizar inteligencia artificial para aliviar precisamente la crisis de revisión. Algunos proyectos experimentales, como los desarrollados en conferencias de inteligencia artificial, ya emplean sistemas automatizados capaces de revisar miles de artículos en menos de un día. Sus defensores argumentan que la IA puede detectar errores técnicos y debilidades metodológicas con gran rapidez, aunque críticos advierten de que esto puede generar revisiones homogéneas, sesgadas y fácilmente manipulables mediante ajustes estilísticos. El debate gira así en torno a una paradoja creciente: utilizar IA para controlar los problemas creados por la propia IA.

Las reacciones en comunidades académicas y tecnológicas reflejan una mezcla de alarma, resignación y escepticismo. En foros como Reddit, numerosos investigadores consideran que el problema no se limita a los modelos lingüísticos, sino a un sistema científico que ya estaba sobrecargado antes de la llegada de la IA generativa. Algunos usuarios sostienen que el verdadero riesgo es que el volumen de textos automatizados haga imposible distinguir entre investigación genuina y producción mecánica. Otros creen que la crisis obligará a replantear prácticas fundamentales de evaluación científica, desde la verificación de referencias hasta la exigencia de compartir datos experimentales completos.

La inteligencia artificial no solo está transformando la manera de escribir artículos científicos, sino que está alterando profundamente los mecanismos de validación del conocimiento académico. La revisión por pares, concebida históricamente como filtro de calidad y garantía de rigor, enfrenta ahora un escenario donde la producción automatizada amenaza con superar la capacidad humana de evaluación. El desafío ya no consiste únicamente en detectar textos generados por IA, sino en redefinir qué significa producir conocimiento fiable en una época dominada por la automatización intelectual.