Mickle, Tripp, Cade Metz, Dylan Freedman, Teresa Mondría Terol y Keith Collins. «How Accurate Are Google’s A.I. Overviews?» The New York Times, 7 de abril de 2026. https://www.nytimes.com/2026/04/07/technology/google-ai-overviews-accuracy.html

.

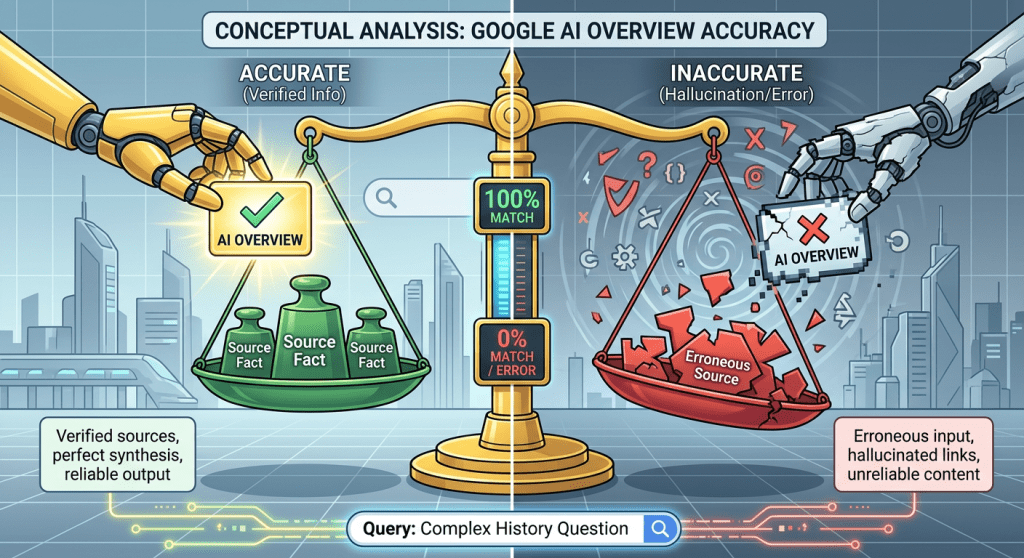

El funcionamiento y la fiabilidad de Google AI Overviews, el sistema de respuestas generadas por inteligencia artificial que aparece directamente en los resultados de búsqueda. El informe se centra en una cuestión clave del ecosistema digital actual: hasta qué punto estos resúmenes automáticos pueden considerarse fiables cuando están mediando entre los usuarios y la información en la web.

La investigación parte de una evaluación técnica realizada con metodologías de benchmarking, que sugiere que, aunque el sistema muestra un alto nivel de acierto general, sigue produciendo un volumen significativo de errores debido a la naturaleza probabilística de los modelos de lenguaje.

Uno de los hallazgos principales es que los AI Overviews alcanzan aproximadamente entre un 90% y 91% de precisión en tareas evaluadas, lo que en términos relativos puede parecer un rendimiento elevado. Sin embargo, el artículo subraya que esta cifra adquiere otra dimensión cuando se aplica a la escala masiva de Google, que procesa billones de consultas anuales. En este contexto, incluso un margen de error del 9–10% se traduce en millones de respuestas incorrectas difundidas diariamente, lo que plantea un problema estructural de fiabilidad en la infraestructura informativa global.

El texto también profundiza en la naturaleza del error en los sistemas de inteligencia artificial generativa. A diferencia de los motores de búsqueda tradicionales, que devuelven enlaces a fuentes externas, los AI Overviews sintetizan respuestas directamente. Este proceso implica que los modelos no “verifican” la verdad de la información, sino que generan textos basados en patrones estadísticos de lenguaje. Como resultado, pueden producir afirmaciones plausibles pero incorrectas, especialmente cuando las fuentes subyacentes son ambiguas, contradictorias o de baja calidad.

Otro aspecto relevante del análisis es el impacto epistemológico de este tipo de tecnología. El artículo señala que la integración de respuestas generadas por IA en la parte superior de los resultados de búsqueda transforma la relación entre usuarios e ინფორმაცია: en lugar de acceder a múltiples fuentes para contrastar información, los usuarios reciben una síntesis única que puede ocultar la diversidad o el conflicto entre datos. Esto introduce una tensión entre eficiencia y verificación, ya que la rapidez del acceso a la información puede debilitar los procesos de comprobación crítica.

El informe plantea implicaciones más amplias para el ecosistema digital y la confianza pública en la información en línea. Aunque Google defiende que el sistema mejora continuamente y reduce errores, el estudio sugiere que la escala del problema sigue siendo significativa. En consecuencia, el artículo concluye que la cuestión central no es solo la precisión técnica del sistema, sino su impacto en la arquitectura del conocimiento digital: la forma en que la inteligencia artificial reconfigura qué información se ve, cómo se interpreta y en qué medida puede considerarse fiable en un entorno informativo cada vez más mediado por algoritmos.