The Chronicle of Higher Education. “Faculty Views on AI.” The Chronicle of Higher Education, consultado el 7 de mayo de 2026. The Chronicle of Higher Education

El informe presenta un panorama claro: la IA ya está transformando la enseñanza superior, pero su adopción está marcada por la tensión entre utilidad práctica y riesgo pedagógico. Los docentes valoran su capacidad para ahorrar tiempo, generar materiales y apoyar tareas rutinarias, pero temen que debilite el esfuerzo intelectual, favorezca el engaño y erosione competencias fundamentales. La conclusión implícita es que el problema no es solo tecnológico, sino estratégico: las universidades deberán decidir si la IA será un simple atajo operativo o una herramienta integrada críticamente dentro de un nuevo modelo educativo.

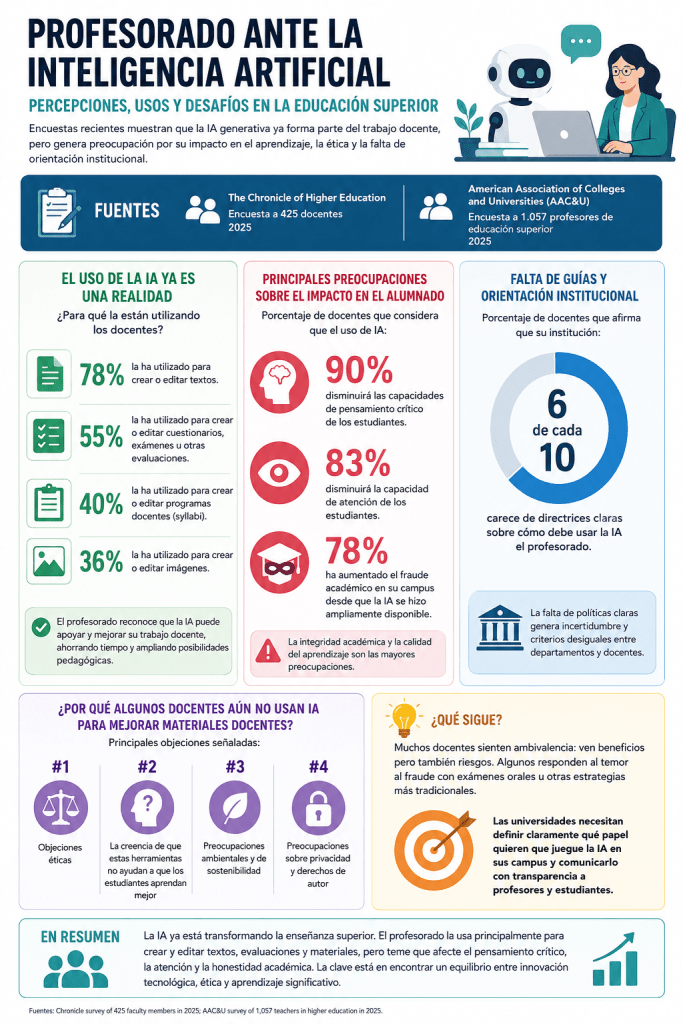

El informe Faculty Views on AI refleja una posición profundamente ambivalente del profesorado universitario ante la inteligencia artificial generativa. Por un lado, una mayoría reconoce que estas herramientas ya están siendo útiles para mejorar ciertos aspectos de la docencia; por otro, existe una preocupación muy fuerte por su impacto negativo en el aprendizaje, la ética académica y la falta de regulación institucional. El estudio combina datos de una encuesta de The Chronicle of Higher Education a 425 docentes en 2025 y otra de la American Association of Colleges and Universities (AAC&U) a 1.057 profesores de educación superior en 2025, lo que permite observar tendencias consolidadas en el ámbito universitario.

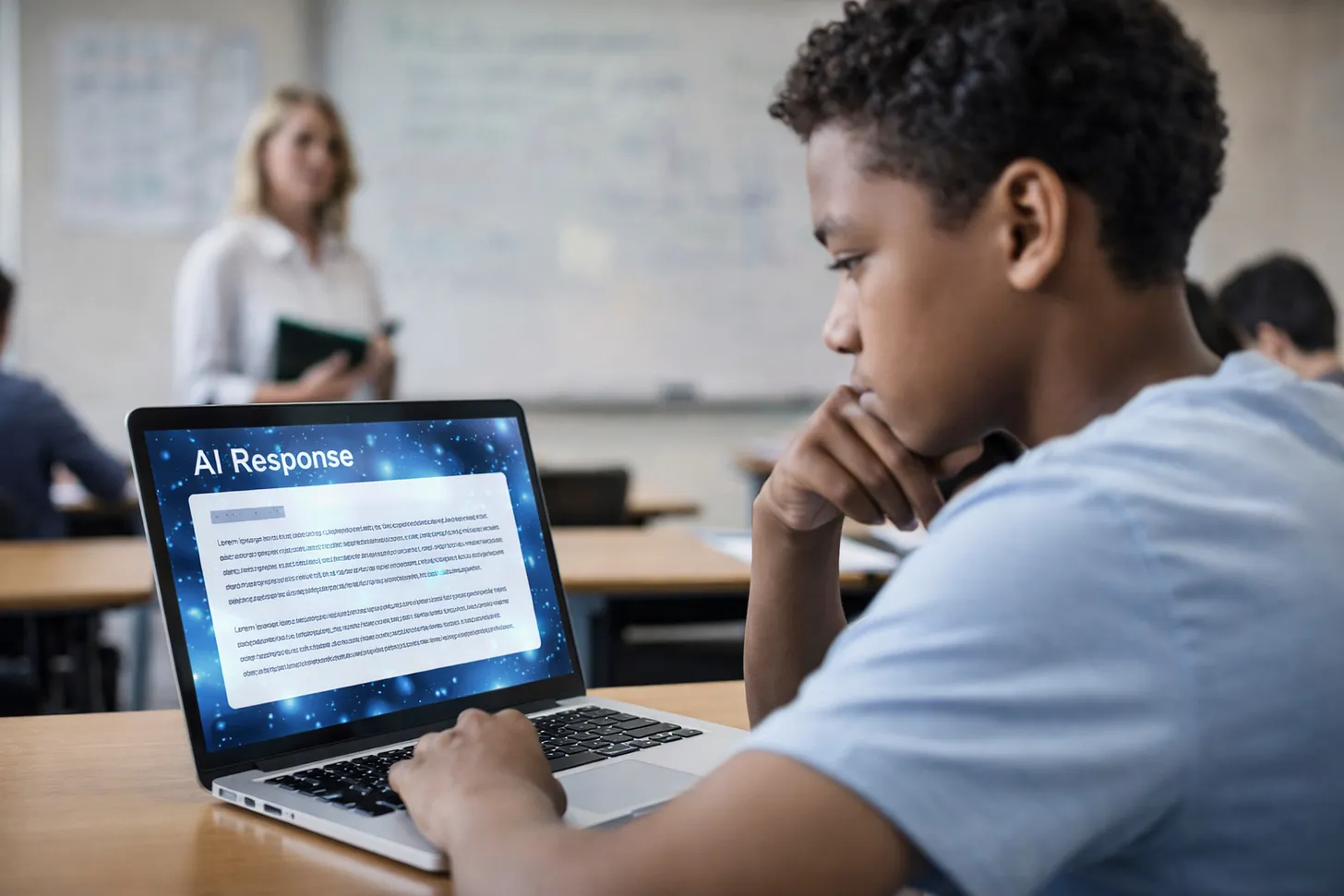

Uno de los datos más significativos es que el profesorado ya está incorporando la IA a su trabajo cotidiano. El 78 % afirma haber utilizado herramientas de IA para crear o editar textos, lo que indica que estas aplicaciones se están convirtiendo en asistentes habituales para redactar materiales, instrucciones o contenidos académicos. Además, el 55 % las ha empleado para crear o revisar cuestionarios, exámenes u otras evaluaciones, mientras que el 40 % dice haberlas usado para elaborar o modificar programas docentes (syllabi). También el 36 % las ha utilizado para crear o editar imágenes, señal de que la IA comienza a desempeñar un papel relevante en la producción de recursos visuales para las clases. Estos porcentajes muestran que, lejos de ser una novedad marginal, la IA ya forma parte de las prácticas docentes en muchas instituciones.

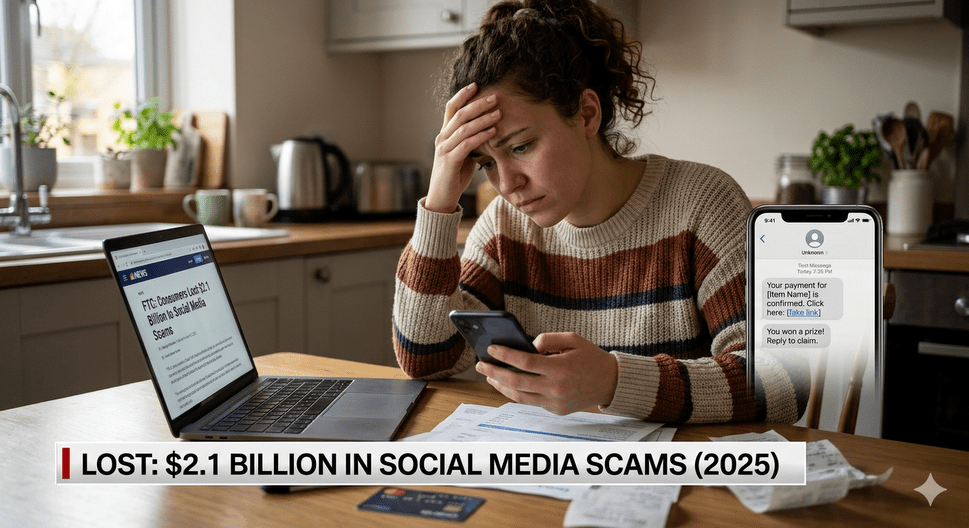

Sin embargo, junto a este uso creciente aparecen temores muy marcados sobre sus consecuencias educativas. El 90 % del profesorado considera que el uso de IA reducirá las capacidades de pensamiento crítico del alumnado, lo que revela una inquietud central: que los estudiantes deleguen procesos intelectuales complejos en la máquina y pierdan autonomía analítica. Asimismo, el 83 % cree que la IA disminuirá la capacidad de atención, reforzando la idea de que el acceso inmediato a respuestas puede fomentar hábitos de concentración superficial. Otro dato especialmente revelador es que el 78 % sostiene que el fraude académico o las trampas en el campus han aumentado desde que la IA se popularizó, lo que sitúa la integridad académica como una de las grandes preocupaciones actuales.

A estos temores se suma un problema institucional importante: la ausencia de normas claras. Más de seis de cada diez profesores afirman que sus universidades carecen de directrices claras sobre cómo debe usarse la IA por parte del profesorado. Esto genera incertidumbre y respuestas desiguales entre departamentos o facultades. En muchos casos, cada docente decide por su cuenta si la permite, la restringe o la integra, lo que produce incoherencia pedagógica y desconcierto entre los estudiantes. El informe subraya que las universidades necesitan definir con mayor claridad qué papel desean otorgar a estas tecnologías y comunicarlo de forma transparente a toda la comunidad académica.

Entre quienes todavía no utilizan IA para mejorar materiales docentes, las razones principales también resultan reveladoras. La objeción más citada son los problemas éticos, seguida de las dudas sobre si realmente ayuda a aprender mejor, las preocupaciones medioambientales y de sostenibilidad, y finalmente los temores relacionados con privacidad y derechos de autor. Esto demuestra que la resistencia no se debe únicamente a desconocimiento tecnológico, sino también a debates legítimos sobre valores, impacto social y calidad educativa.