AI School Librarian. “Confident Answers Are Not the Same as Correct Answers.” Substack, 2026. https://aischoollibrarian.substack.com/p/confident-answers-are-not-the-same

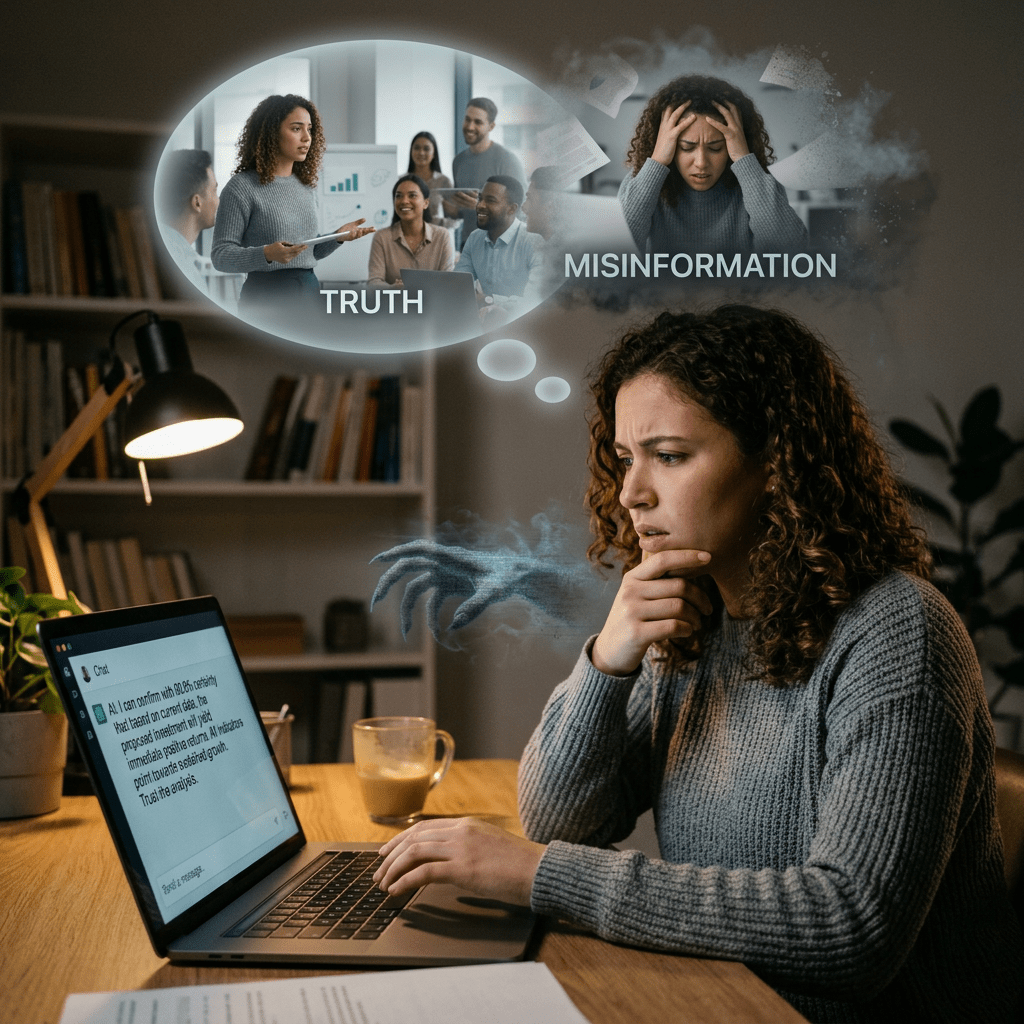

Se plantea una advertencia fundamental en la era de la inteligencia artificial generativa: la apariencia de seguridad en una respuesta no equivale a su veracidad. Los sistemas de IA están diseñados para producir textos coherentes, fluidos y convincentes, lo que genera una ilusión de autoridad que puede inducir a error.

Esta característica no es accidental, sino inherente a su funcionamiento: los modelos predicen qué respuesta “suena” correcta basándose en patrones estadísticos, no en una comprensión real de la verdad. Así, la confianza expresiva de la IA puede enmascarar errores, lagunas o incluso invenciones, lo que obliga a replantear cómo interpretamos y evaluamos sus respuestas.

El texto subraya que este fenómeno tiene profundas implicaciones educativas e informativas. Tradicionalmente, los humanos han asociado la confianza con la competencia, confiando más en quienes se expresan con seguridad. La IA explota involuntariamente este sesgo cognitivo: presenta información con una estructura clara y un tono firme, lo que reduce la tendencia del usuario a cuestionar su contenido. Sin embargo, como advierten diversos análisis, esta “brecha de confianza” puede llevar a aceptar respuestas incorrectas simplemente porque están bien formuladas. En contextos académicos o profesionales, esto puede erosionar el pensamiento crítico y fomentar una dependencia excesiva de sistemas automatizados.

Otro aspecto relevante es que la calidad de las respuestas depende en gran medida de cómo se formula la pregunta. Los usuarios con mayor conocimiento previo o habilidades de “prompting” obtienen resultados más precisos y útiles, mientras que quienes carecen de estas competencias pueden recibir respuestas superficiales o incompletas. Esto introduce un nuevo tipo de desigualdad informativa: no todos los usuarios acceden al mismo nivel de calidad en la información generada por IA, lo que cuestiona la idea de que estas herramientas democratizan el conocimiento.

El artículo también insiste en que la IA no distingue adecuadamente entre niveles de certeza. Puede presentar hechos bien establecidos y afirmaciones especulativas con el mismo grado de seguridad, dificultando que el usuario discrimine entre información fiable y dudosa. Este “aplanamiento de la certeza” es especialmente problemático en ámbitos como la salud, la educación o la toma de decisiones, donde la precisión y el contexto son esenciales.

Por ello se propone una actitud crítica y reflexiva como respuesta a este desafío. La IA debe entenderse como una herramienta de apoyo, no como una autoridad definitiva. Verificar la información, contrastarla con fuentes fiables y mantener el juicio propio se convierten en habilidades clave en este nuevo entorno. En última instancia, el artículo no rechaza el uso de la inteligencia artificial, pero advierte que su integración en la vida cotidiana exige una alfabetización informacional más sofisticada, capaz de distinguir entre lo que suena convincente y lo que realmente es cierto.