Foran, Helen, y Howard Bilodeau. 2026. “Shifting Perceptions of Misinformation in Canada: Trends in Exposure, Detection and Trust.” Insights on Canadian Society. Statistics Canada, 13 de mayo de 2026. https://www150.statcan.gc.ca/n1/pub/75-006-x/2026001/article/00006-eng.htm

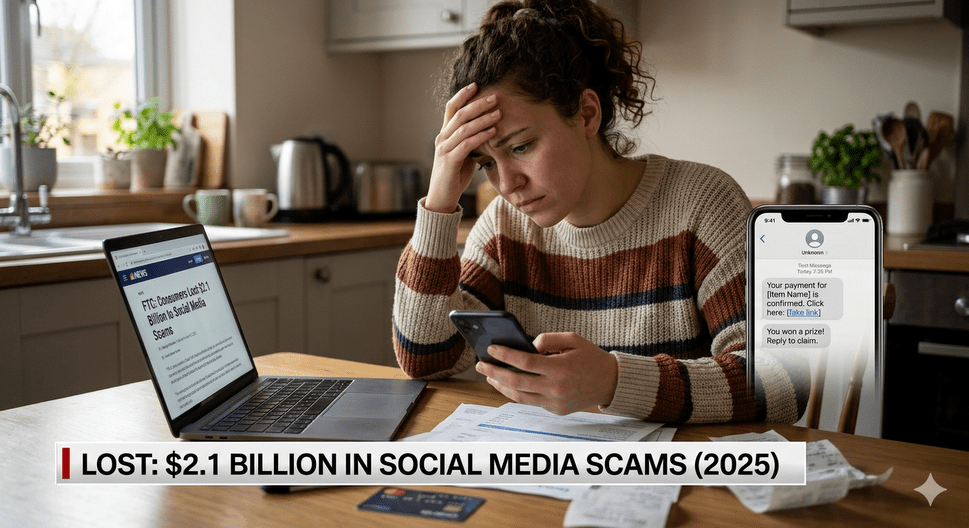

En 2025, el 80 % de los canadienses declaró haber visto noticias o información en internet que sospechaban que era engañosa, falsa o inexacta al menos una vez al mes. Estas experiencias son una de las principales preocupaciones de los canadienses, y la mayoría (61 %) manifestó estar «muy preocupada» o «extremadamente preocupada» por la desinformación en línea en 2025.

El estudio analiza cómo los canadienses perciben, detectan y experimentan la desinformación en el entorno digital, así como su relación con la confianza en los medios y la confianza interpersonal. A partir de datos de la Canadian Social Survey (2025) y comparaciones con la Survey Series on People and their Communities (2023), el informe explora la evolución de la exposición a noticias falsas, la capacidad de los ciudadanos para distinguir entre información verdadera y falsa, y el impacto de este fenómeno en la confianza social.

Uno de los hallazgos centrales es la alta exposición a la desinformación: en 2025, el 80% de los canadienses afirmó haber visto al menos mensualmente información que consideraba engañosa o falsa. Esta exposición es prácticamente transversal en términos de edad, género y nivel educativo, lo que indica que la desinformación es un fenómeno estructural del ecosistema informativo digital. Sin embargo, los mayores de 75 años reportan una menor exposición, posiblemente por diferencias en los hábitos de consumo informativo.

El estudio también muestra cómo los ciudadanos acceden a la información. Las fuentes más habituales son los medios de comunicación (66%), contactos cercanos (62%), redes sociales (54%) y la televisión (52%). Sin embargo, existen diferencias generacionales claras: los jóvenes (15–34 años) dependen principalmente de las redes sociales (78%), mientras que los mayores confían más en medios tradicionales como la televisión y los medios informativos. Estas diferencias reflejan una fragmentación del ecosistema mediático según la edad y el nivel educativo.

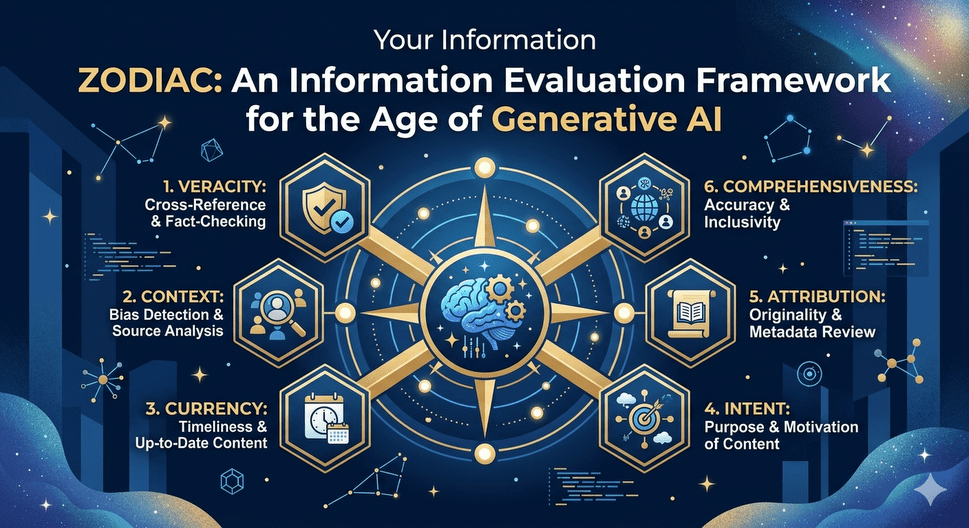

En cuanto a la percepción de la veracidad informativa, el 47% de los canadienses declara que en 2025 le resulta más difícil distinguir entre información verdadera y falsa que hace tres años. Además, el 61% expresa una preocupación alta o muy alta por la desinformación en línea. El informe destaca que esta dificultad no es uniforme, sino que se relaciona con variables como el nivel educativo, la confianza en los medios y la confianza interpersonal.

Otro aspecto relevante es la relación entre desinformación y confianza social. Los resultados muestran que las personas con mayor confianza en los medios canadienses y en otras personas tienden a tener más seguridad en su capacidad para detectar información falsa. Por el contrario, quienes muestran menor confianza en los medios o en los demás reportan mayores dificultades para identificar contenidos engañosos. Esto sugiere que la desinformación no solo es un problema informativo, sino también un fenómeno vinculado al capital social y la confianza institucional.

En conjunto, el estudio concluye que la desinformación es una experiencia común y persistente en la sociedad canadiense, y que sus efectos no se limitan a la exposición, sino que influyen en la percepción de la realidad y en la confianza en las instituciones. Aunque la preocupación por este fenómeno se mantiene estable entre 2023 y 2025, el reto principal es la creciente complejidad del entorno digital y la dificultad creciente para distinguir entre información fiable y falsa.