Euronews. “EU finds Meta in breach of digital rules over children on Instagram and Facebook.” Euronews Next, 29 de abril de 2026. https://www.euronews.com/next/2026/04/29/eu-finds-meta-in-breach-of-digital-rules-over-children-on-instagram-and-facebook

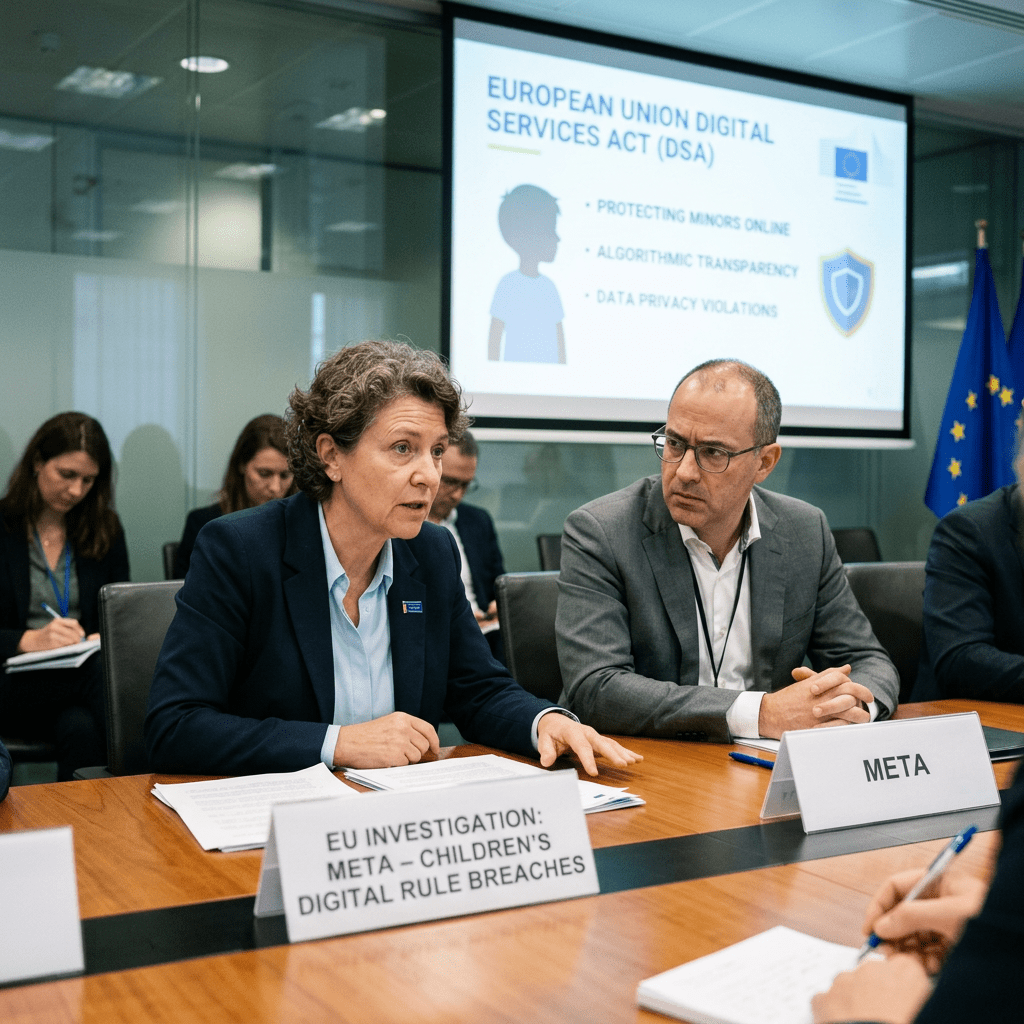

La Comisión Europea ha emitido una conclusión preliminar en la que sostiene que Meta incumple la Digital Services Act al no implementar medidas eficaces para impedir que menores de 13 años utilicen sus plataformas, especialmente Instagram y Facebook.

La investigación, que se ha prolongado durante cerca de dos años, concluye que los sistemas actuales de control de edad son insuficientes, ya que permiten a los usuarios registrarse introduciendo fechas de nacimiento falsas sin mecanismos reales de verificación. Como resultado, entre un 10% y un 12% de los menores de 13 años en la Unión Europea estarían utilizando estos servicios, contradiciendo las propias evaluaciones internas de la compañía.

El informe también critica que Meta no ha evaluado adecuadamente los riesgos que estas plataformas suponen para los menores. Según la Comisión, la empresa habría ignorado evidencia científica disponible que señala la especial vulnerabilidad de los niños frente a contenidos perjudiciales y dinámicas potencialmente adictivas en redes sociales. Esto implica un incumplimiento no solo técnico, sino también conceptual, ya que la normativa europea exige que las grandes plataformas identifiquen, analicen y mitiguen los riesgos sistémicos derivados de sus servicios, especialmente cuando afectan a colectivos vulnerables como los menores.

Otro aspecto relevante del caso es la debilidad de los mecanismos para detectar y eliminar cuentas de menores una vez creadas. La Comisión considera que las herramientas de supervisión y reporte no funcionan con la eficacia necesaria, lo que permite que muchos usuarios por debajo de la edad mínima permanezcan activos en las plataformas. Este fallo estructural evidencia una brecha entre las políticas declaradas por la empresa —que fijan los 13 años como edad mínima— y su aplicación real en el entorno digital.

Por su parte, Meta ha rechazado las conclusiones preliminares, defendiendo que ya dispone de herramientas para identificar y eliminar cuentas de menores y subrayando que la verificación de edad es un desafío que afecta a toda la industria tecnológica. La empresa ha anunciado que seguirá colaborando con las autoridades europeas y que introducirá nuevas medidas en el corto plazo para reforzar la protección de los usuarios jóvenes.

El procedimiento aún no ha concluido y Meta tiene la oportunidad de responder a las acusaciones antes de una decisión final. No obstante, si se confirma el incumplimiento, la compañía podría enfrentarse a sanciones significativas, que en el marco de la legislación europea pueden alcanzar hasta el 6% de su facturación global anual. Más allá del caso concreto, este proceso refleja una creciente preocupación en Europa por el impacto de las redes sociales en la infancia y refuerza la tendencia hacia una regulación más estricta de las grandes plataformas digitales en materia de seguridad y bienestar de los usuarios