Cosstick, John. “AI Misinformation vs AI Hallucinations: What’s the Difference.” Tech Life Future, 2025. https://www.techlifefuture.com/ai-misinformation-vs-ai-hallucinations/

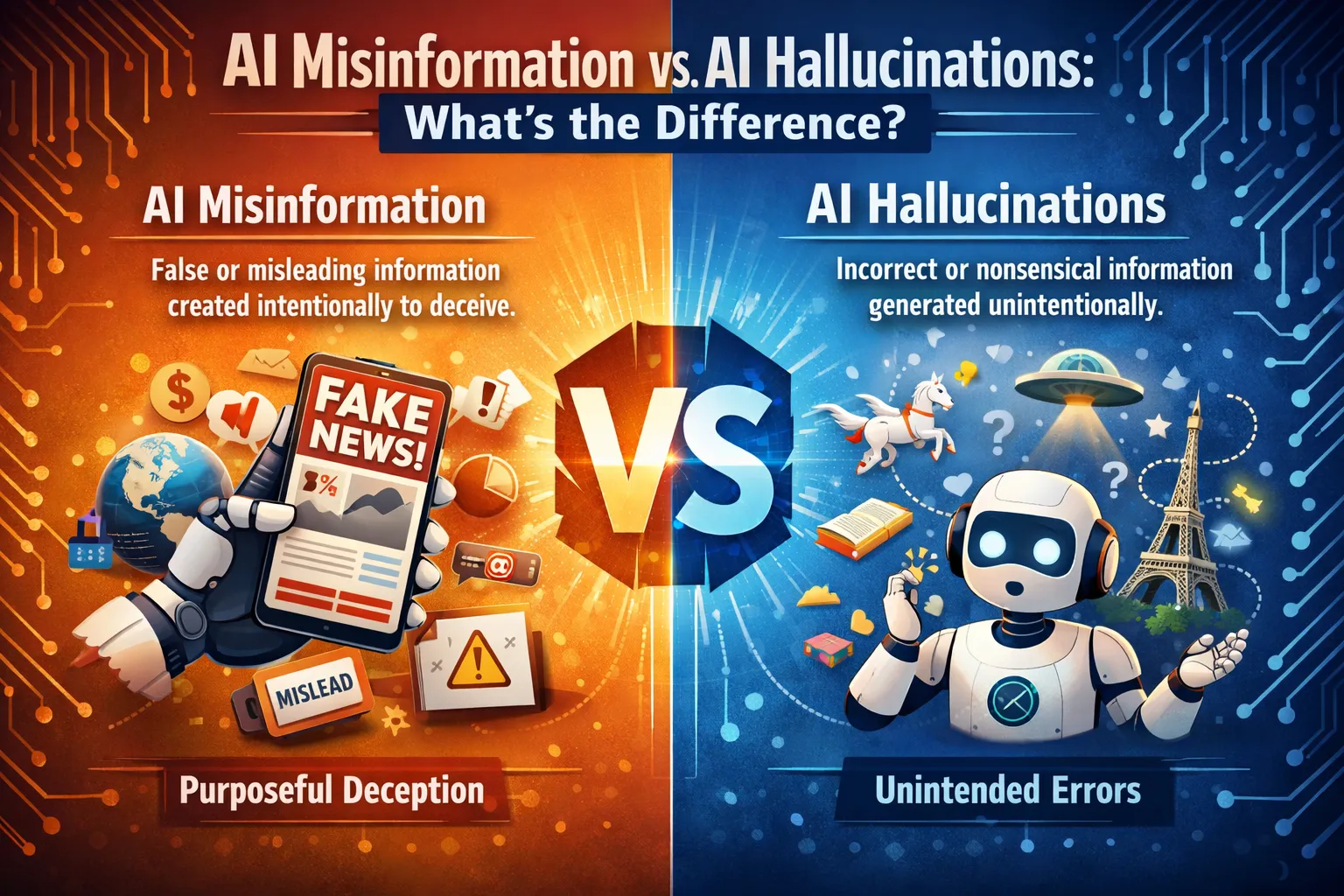

Se analiza una distinción clave en el ecosistema informativo contemporáneo: la diferencia entre la desinformación generada por inteligencia artificial y las llamadas “alucinaciones” de la IA. Aunque ambos fenómenos implican la producción de información falsa o engañosa, su origen y naturaleza son distintos.

La desinformación en IA suele estar vinculada a la intención humana: se genera o difunde contenido falso de manera deliberada para manipular, influir o engañar. En cambio, las alucinaciones son errores inherentes al funcionamiento de los modelos de lenguaje, que producen información incorrecta sin intención maliciosa, simplemente porque “rellenan” lagunas con contenido plausible pero no verificado.

El texto profundiza en las causas técnicas de las alucinaciones, señalando que estas surgen de limitaciones estructurales de los sistemas de IA. Los modelos funcionan mediante generación probabilística: predicen qué texto es más probable en función de patrones aprendidos, no de una verificación factual. Esto puede llevar a la invención de datos, citas académicas inexistentes o errores históricos. Factores como datos de entrenamiento incompletos o sesgados, así como limitaciones en la arquitectura de los modelos, contribuyen a este fenómeno. En esencia, la IA no “miente”, sino que construye respuestas verosímiles a partir de patrones, lo que puede resultar en afirmaciones erróneas presentadas con gran coherencia.

Por otro lado, la desinformación impulsada por IA se inscribe en dinámicas sociales más amplias. No depende tanto de fallos técnicos como de usos intencionados de la tecnología: desde la creación de contenidos engañosos mediante técnicas como el prompt engineering hasta su difusión masiva a través de redes sociales, bots o influencers. Este tipo de desinformación explota los sesgos cognitivos de los usuarios y puede tener consecuencias especialmente graves en ámbitos como la política, la salud o la opinión pública.

El artículo subraya que, aunque ambos fenómenos pueden parecer similares para el usuario —información falsa presentada de forma convincente—, requieren estrategias distintas de mitigación. Las alucinaciones demandan mejoras técnicas en los modelos, como mejores datos de entrenamiento o sistemas de verificación interna. La desinformación, en cambio, exige respuestas sociales, regulatorias y educativas, incluyendo alfabetización mediática y control de los canales de difusión.

Por último, se destaca que el auge de la inteligencia artificial ha intensificado el problema de la fiabilidad de la información. Estudios recientes muestran que una proporción significativa de respuestas generadas por IA puede ser incorrecta o engañosa, lo que pone en riesgo la integridad del ecosistema informativo. En este contexto, comprender la diferencia entre desinformación y alucinación no es solo una cuestión técnica, sino una competencia crítica para navegar en un entorno cada vez más mediado por algoritmos.