Zuckerberg, M. (2025). Personal Superintelligence. Meta. https://www.meta.com/superintelligence/

Mark Zuckerberg ha presentado recientemente una visión ambiciosa y polémica: construir una «superinteligencia personal», una inteligencia artificial que no solo sea más inteligente que los humanos, sino que esté profundamente personalizada para cada usuario.

Mark Zuckerberg está apostando el futuro de Meta —y buena parte de su capital— a la creación de una inteligencia artificial que transforme la relación entre las personas y la tecnología. Esta “superinteligencia personal” promete eficiencia, libertad y una nueva era de experiencias asistidas por IA. Pero también plantea interrogantes críticos sobre la economía de la atención, la privacidad, el modelo de negocio y los riesgos éticos que supone poner un asistente todopoderoso en manos de una compañía con intereses comerciales tan potentes como Meta.

Esta idea fue expuesta tanto en su carta pública titulada Personal Superintelligence (Meta, julio de 2025) como durante la presentación de resultados del segundo trimestre de Meta, donde también se destacó un crecimiento récord de ingresos, impulsado por mejoras en productos gracias a la IA.

En su manifiesto, Zuckerberg describe esta superinteligencia como un asistente que gestionará prácticamente todos los aspectos de la vida diaria del usuario: desde la organización de tareas hasta la creatividad personal, pasando por relaciones sociales, entretenimiento y desarrollo personal. El objetivo declarado es liberar a las personas del tiempo que pasan frente a las pantallas y permitir que vivan experiencias más ricas con la ayuda de interfaces más naturales, como gafas inteligentes. Meta ya ha dado pasos significativos en esa dirección con la popularización de sus gafas Ray-Ban con IA, cuyas ventas se triplicaron en el último año.

Zuckerberg subraya que la ventaja competitiva de Meta reside en su escala: la posibilidad de entrenar sistemas con datos procedentes de miles de millones de usuarios. Esto permitiría crear AIs altamente personalizadas y eficientes, que vayan mucho más allá de los chatbots actuales. En paralelo, Meta ha abierto sus modelos LLaMA 3, lo que fortalece su imagen como impulsora del desarrollo de IA abierta, aunque persisten dudas sobre cuán abierta es realmente esta apertura.

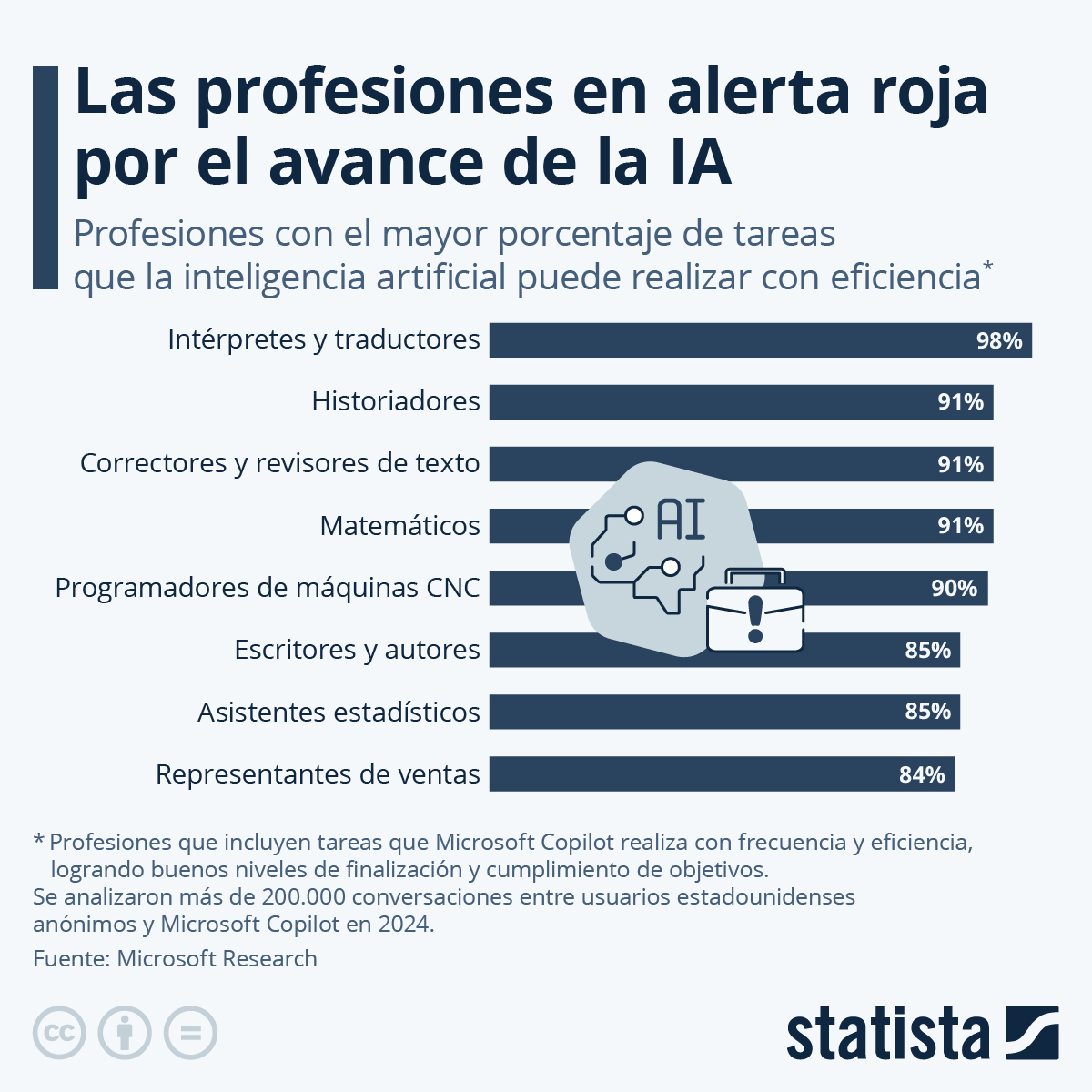

Sin embargo, esta visión no está exenta de tensiones ni contradicciones. Mientras Zuckerberg promete un futuro en el que pasamos menos tiempo frente a pantallas, los propios informes financieros muestran que las mejoras en IA han llevado a un aumento del 5–6% en el tiempo que los usuarios pasan en Facebook e Instagram. Es decir, la IA actual de Meta está siendo usada principalmente para captar atención, no para liberarla. A esto se suma la paradoja de que, si los usuarios pasan menos tiempo en las plataformas, el modelo de negocio basado en publicidad se vuelve menos rentable. Una posible solución sería migrar hacia un sistema de comisiones por transacciones realizadas mediante IA, similar al modelo que Sam Altman propone para ChatGPT.

Además, el término “superinteligencia” ha sido históricamente asociado a advertencias sobre riesgos existenciales. Aunque Zuckerberg matiza que el problema no está en la inteligencia en sí, sino en su mal uso, su visión entra en territorio delicado: el de delegar a una IA decisiones íntimas, emocionales y éticas. La confianza del usuario en Meta será clave para que esta propuesta tenga éxito, y esa confianza, históricamente, ha sido frágil debido a los escándalos de privacidad y manipulación algorítmica.

Más información

Wired. Mark Zuckerberg Details Meta’s Plan for Self-Improving, Superintelligent AI. https://www.wired.com/story/meta-earnings-superintelligence-q2-2025/

Mashable. Zuck outlines Meta’s vision for AI ‘personal superintelligence’. https://mashable.com/article/mark-zuckerberg-outlines-metas-vision-ai-personal-superintelligence

Business Insider. Mark Zuckerberg just shared his vision for ‘personal superintelligence’. https://www.businessinsider.com/mark-zuckerberg-meta-personal-superintelligence-ai-letter-meta-2025-7

The Neuron. Mark releases his vision for “personal superintelligence”. Via The AI Report. 31 de julio de 2025.