Chicago Tribune. “Illinois Bill Would Stop Publishers From Charging Libraries More Than Public for E-Books and Audiobooks.” Chicago Tribune, April 23, 2026 https://www.yahoo.com/news/articles/illinois-bill-stop-publishers-charging-100000843.html

El estado de Illinois debate una propuesta legislativa que podría transformar el acceso digital en bibliotecas públicas. El proyecto de ley busca impedir que las editoriales cobren a las bibliotecas más dinero que al público general por el mismo libro electrónico o audiolibro. La medida responde a una queja creciente del sector bibliotecario: las instituciones públicas pagan licencias temporales mucho más caras que el precio minorista, pese a financiarse con fondos públicos y prestar un servicio esencial de acceso a la cultura.

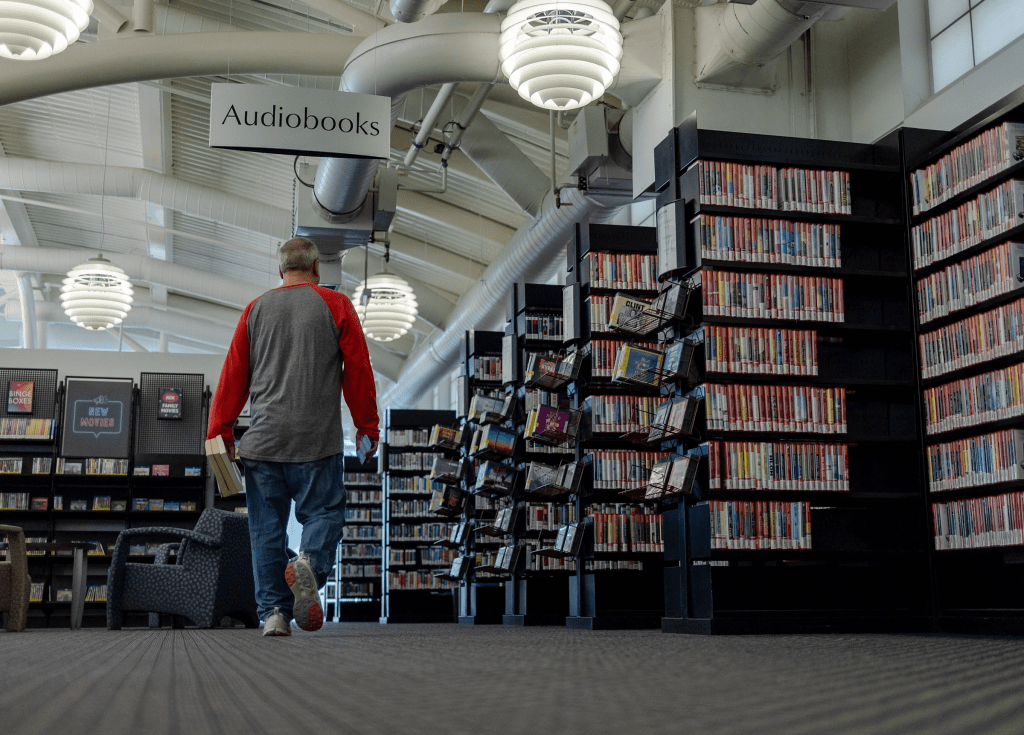

Según responsables bibliotecarios citados en la cobertura periodística, una parte cada vez mayor de los presupuestos de adquisiciones se destina a licencias digitales. Algunas bibliotecas estarían empleando cerca del 50 % de sus fondos de colecciones en e-books y audiolibros. Esto provoca listas de espera prolongadas para los usuarios y limita la capacidad de mantener colecciones equilibradas entre formatos impresos y digitales. En la práctica, cuanto más popular es un título, más costoso resulta ofrecerlo al público mediante préstamo electrónico.

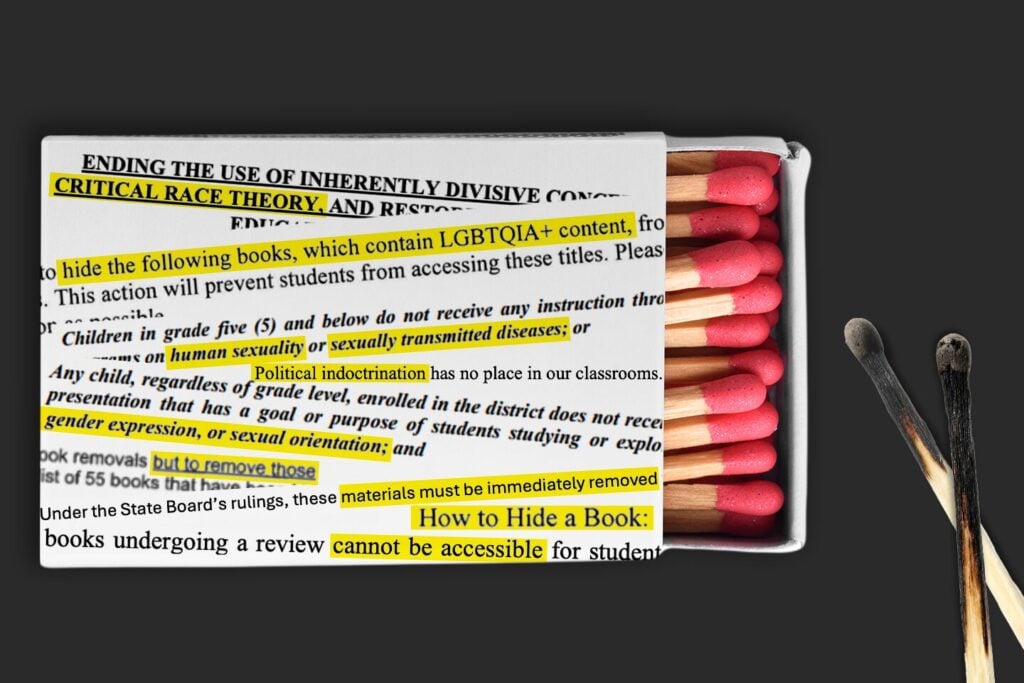

La iniciativa legislativa no solo aborda los precios. También pretende prohibir restricciones contractuales consideradas abusivas por los bibliotecarios, como límites en el número de préstamos permitidos por licencia, obstáculos al préstamo interbibliotecario o topes al número de copias digitales que una biblioteca puede adquirir. El objetivo es equiparar las funciones tradicionales de las bibliotecas en el entorno digital y evitar que los contratos privados vacíen de contenido su misión pública.

Frente a ello, asociaciones de editores y autores se oponen con firmeza. Argumentan que el actual sistema de licencias protege la remuneración de escritores, creadores y pequeñas librerías, y que una regulación demasiado estricta podría hacer inviable la oferta digital a bibliotecas. Sostienen que, si no pueden operar bajo condiciones sostenibles, algunas editoriales podrían retirar catálogos o reducir la disponibilidad de títulos para préstamo público.

El conflicto refleja un debate más amplio sobre propiedad intelectual y acceso público en la era digital. Mientras que un libro impreso comprado por una biblioteca puede prestarse repetidamente, los libros electrónicos suelen venderse bajo licencia y con condiciones específicas impuestas por las plataformas. Esto cambia radicalmente la economía del préstamo bibliotecario y coloca a las instituciones en una posición negociadora débil frente a grandes grupos editoriales y distribuidores tecnológicos.

Si Illinois aprueba finalmente esta ley, podría convertirse en referencia para otros estados norteamericanos. No sería solo una cuestión presupuestaria, sino un precedente sobre quién controla el acceso a la lectura digital: las bibliotecas como servicio público o los titulares privados de los catálogos. El resultado será observado con atención por bibliotecarios, editoriales y legisladores de todo el país.