LaFlamme, Marcel, y Natalie Meyers. Enacting AI Disclosure in Scholarly Publishing. Preprint, Open Anthropology Research Repository (OARR), 2025.

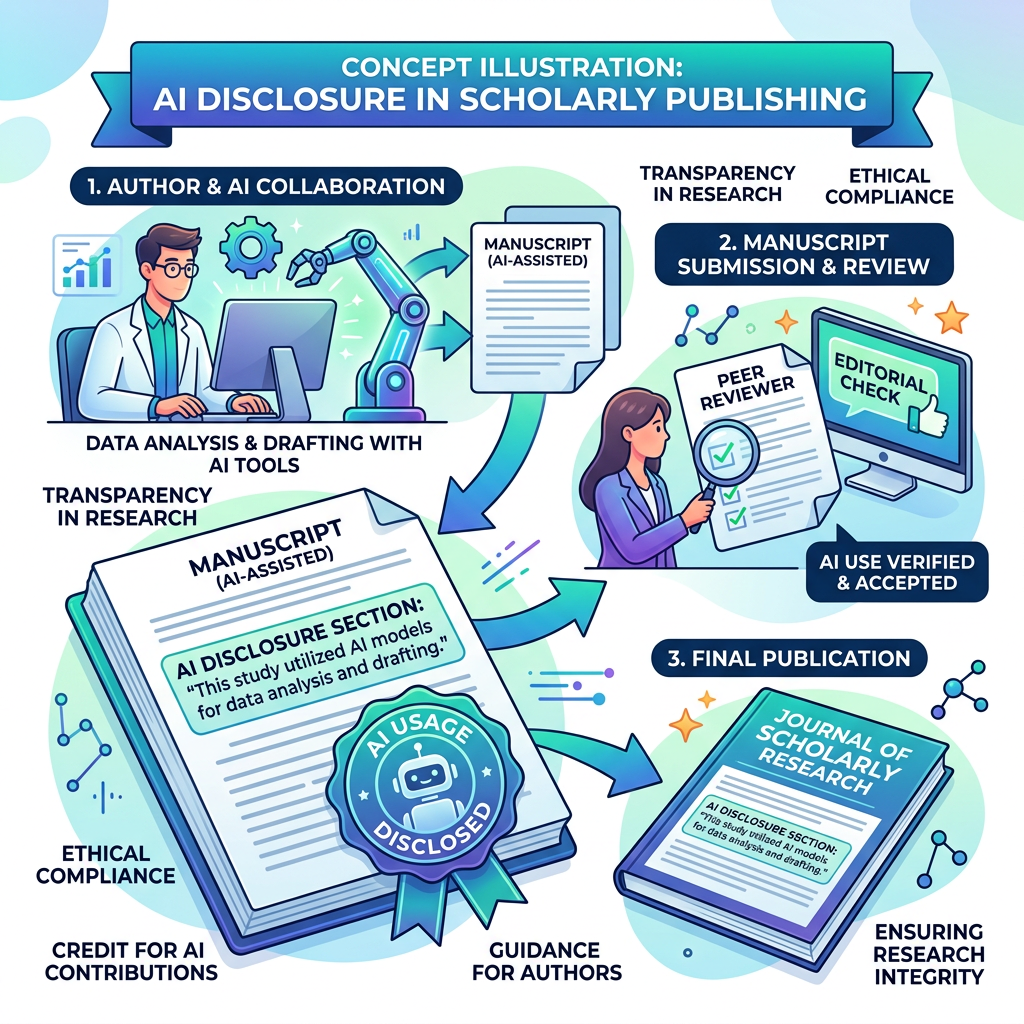

El artículo aborda un fenómeno emergente en la comunicación científica contemporánea: la creciente exigencia de que los autores académicos declaren si han utilizado inteligencia artificial generativa (IA) y de qué manera en la elaboración de sus trabajos. Los autores sitúan esta cuestión en un contexto de rápida expansión de herramientas de IA en la investigación y la escritura académica, lo que ha generado nuevas tensiones en torno a la transparencia, la autoría y la responsabilidad intelectual. En este escenario, la divulgación del uso de IA se perfila como una práctica clave para mantener la integridad del sistema científico, aunque todavía carece de estándares homogéneos y plenamente consolidados.

El texto ofrece un mapa del panorama actual de prácticas de divulgación y atribución de la IA, mostrando que estas se encuentran en una fase incipiente, caracterizada por la diversidad de enfoques entre editoriales, disciplinas y organismos reguladores. Los autores destacan que, aunque existe un consenso general en torno a la necesidad de transparencia, las formas concretas de declarar el uso de IA —qué se debe declarar, cómo hacerlo y en qué parte del artículo— siguen siendo objeto de debate. Esta falta de estandarización genera incertidumbre tanto para autores como para editores, y dificulta la comparabilidad entre publicaciones.

Un aspecto central del artículo es su enfoque disciplinar, particularmente en relación con la antropología. Los autores sostienen que cualquier modelo de divulgación de IA debe adaptarse a los compromisos epistemológicos y éticos específicos de cada campo, en lugar de aplicarse de manera uniforme. En disciplinas como la antropología, donde la interpretación, la reflexividad y la relación con los sujetos de estudio son fundamentales, el uso de IA plantea cuestiones adicionales sobre la mediación tecnológica en la producción de conocimiento. Por ello, la divulgación no debe entenderse solo como un requisito técnico, sino como una práctica situada que refleja valores disciplinares.

El artículo también propone recomendaciones concretas para implementar la divulgación de IA, basadas en prácticas ya existentes en la publicación académica. Entre ellas, se sugiere integrar la información sobre el uso de IA en secciones ya consolidadas, como la metodología o los agradecimientos, así como desarrollar descripciones claras del tipo de uso realizado (por ejemplo, edición lingüística, generación de texto o análisis de datos). Estas recomendaciones buscan evitar soluciones completamente nuevas y, en su lugar, aprovechar infraestructuras editoriales ya establecidas para facilitar la adopción de la transparencia.

Además, el trabajo amplía su perspectiva más allá del ámbito editorial para analizar cómo la exigencia de divulgar el uso de IA está siendo codificada en distintos niveles —profesionales, institucionales y regulatorios—. Esto permite entender la divulgación no solo como una práctica académica, sino como parte de una tendencia más amplia hacia la rendición de cuentas en el uso de tecnologías automatizadas. En este sentido, las decisiones que tomen las disciplinas individuales deben interpretarse dentro de un ecosistema global en el que la transparencia tecnológica se está convirtiendo en un principio normativo transversal.

En conjunto, el artículo defiende que la divulgación del uso de IA no es simplemente una cuestión administrativa, sino un elemento crucial para preservar la confianza en la investigación, clarificar la autoría humana y hacer visibles los procesos de producción del conocimiento. Sin embargo, advierte que el desafío no radica únicamente en exigir transparencia, sino en diseñar modelos de divulgación que sean significativos, consistentes y sensibles a las particularidades de cada disciplina.