Los investigadores, financiadores e instituciones están interesados en comprender y cuantificar la difusión y el impacto de la investigación, especialmente en lo que se refiere a la comunicación con el público. Tradicionalmente, las citaciones han sido una medida de impacto primario; sin embargo, las citaciones requieren de un lento proceso para acumularse y enfocarse en el uso académico.

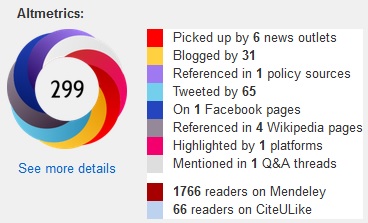

Recientemente se ha sugerido la utilización medidas altmétricas, que registran formas alternativas de difusión (por ejemplo, los medios sociales) como complemento de las métricas basadas en citaciones. Este estudio examina la relación entre la altermetria y las medidas tradicionales: citas de artículos de revistas y recuento de accesos. Los investigadores recopilaron en Web of Science y Altmetric.com artículos publicados en revistas de HPE entre 2013-2015. Identificaron 2.486 artículos.

Los datos se analizaron mediante modelos binomiales y de regresión lineal negativa. En este recuento, los blogs se asociaron con el mayor aumento de citas (13% de incremento), mientras que los Tweets (1,2%) y Mendeley (1%) se asociaron con aumentos menores. El factor de impacto en revistas (JIF) se asoció con un aumento del 21% en las citas. Los artículos libremente accesibles al público se asociaron con una disminución del 19%, pero el efecto interactivo entre los artículos accesibles y el Factor de impacto se asoció con un aumento del 12%. Al examinar las cuentas de acceso, los artículos libremente accesibles al público tuvieron un aumento de 170, mientras que los blogs se asociaron con una disminución de 87 accesos.

Este estudio sugiere que varios puntos de las métricas alternativas están positivamente asociados con las citas, y que la accesibilidad pública, manteniendo constantes todas las demás variables independientes, está positivamente relacionada con el acceso al artículo. Dado el enfoque evolutivo de la comunidad científica en la difusión-incluyendo al público-los hallazgos tienen implicaciones para las partes interesadas, proporcionando una visión de los factores que pueden mejorar las citas y el acceso a los artículos.