Bounds, Lia Holland and Jade Pfaefflin. 2023. «E-Books Are Fast Becoming Tools of Corporate Surveillance». Fast Company. 12 de diciembre de 2023. https://www.fastcompany.com/90996547/e-books-are-fast-becoming-tools-of-corporate-surveillance.

Mientras Internet Archive apela una decisión judicial que bloquea alternativas a las licencias de libros digitales sujetas a vigilancia, un nuevo informe revela que la editorial más grande del mundo puede estar vendiendo datos personales íntimos de sus lectores al mejor postor.

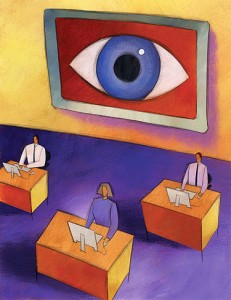

Tres de cada diez estadounidenses leen libros digitales. Ya sea que estén accediendo a libros de texto en línea o consultando el último e-book más vendido de la biblioteca pública, la mayoría de estos lectores están sujetos tanto a la codicia de las grandes editoriales como a las prioridades de las grandes empresas tecnológicas. De hecho, Kindle de Amazon tenía el 72% del mercado de lectores electrónicos en 2022. Y si hay algo que sabemos sobre las grandes empresas tecnológicas como Amazon, su verdadero producto no es el libro, sino los datos del usuario.

Las principales editoriales están dando carta blanca a las grandes empresas tecnológicas para observar lo que lees y dónde, incluyendo libros sobre temas sensibles, como si tomaras un libro de autocuidado después de un aborto. Peor aún, las corporaciones tecnológicas y editoriales están recogiendo datos más allá de tus hábitos de lectura; hoy en día, no hay leyes federales que los detengan de vigilar a personas que leen libros digitales en todo Internet.

La vigilancia de los lectores es una amenaza profundamente interseccional, según una carta del Congreso emitida la semana pasada por una coalición de grupos cuyos intereses abarcan derechos civiles, contra la vigilancia, contra la prohibición de libros, justicia racial, justicia reproductiva, LGBTQ+, inmigrantes y antimonopolio. La carta insta a los legisladores federales a investigar los daños del poderoso control de las corporaciones tecnológicas y editoriales sobre el acceso a libros digitales.

Esta investigación es un primer paso esencial para revivir el derecho a leer sin temor a que tus intereses se utilicen en tu contra. Porque, lamentablemente, ese derecho está en cuidados intensivos cuando se trata de libros digitales.

En este momento, hay un esfuerzo concertado por parte de legisladores antiaborto y vigilantes para descubrir quiénes están obteniendo o apoyando un aborto, y los recolectores de datos ya han sido demandados por compilar datos de visitantes a centros de salud reproductiva. Pero aún no hay protecciones federales significativas de la privacidad de los datos para detener el flujo de datos personales íntimos.

Amenazas al estilo de «1984» tejidas en la vida cotidiana de las personas son particularmente insidiosas. La persona promedio que busca un aborto no sabe cómo navegar de manera segura en un estado de vigilancia, y saber que pueden estar siendo vigiladas lleva a que las personas no accedan a la atención reproductiva o de aborto que necesitan, que no busquen el apoyo mental y emocional que requieren y que pospongan la atención hasta más avanzado en un embarazo no deseado. Todas estas elecciones ponen en peligro a la persona embarazada.

En la era de la inteligencia artificial, la capacidad para analizar datos detallados de manera insondable sobre individuos, crear informes e inferencias sobre esas personas y usar todo eso para entrenar modelos de IA está mejorando constantemente. Los incentivos para explotar los datos de los lectores son los más fuertes que jamás hayan sido.

Las grandes editoriales claramente no ven más que signos de dólar mientras aplicaciones como Hoopla recogen datos vinculados a la identidad de los lectores. Entonces, sería natural depositar nuestra esperanza en las bibliotecas públicas, que ven la privacidad del usuario como un derecho fundamental esencial para una democracia funcional. En la comunidad de derechos humanos, la resistencia de las bibliotecas contra la vigilancia gubernamental bajo la Ley PATRIOT es legendaria.

Desafortunadamente, las grandes editoriales han demandado para evitar que las bibliotecas presten libros digitales libres de vigilancia, ganando un fallo en un tribunal inferior que la organización sin fines de lucro Internet Archive apelará antes de que termine el año. A menos que ese fallo sea anulado o se aprueben nuevas leyes, las bibliotecas no tienen otra alternativa que licenciar libros digitales que probablemente estén llenos de programas espías.

Sabemos menos sobre la vigilancia en las bibliotecas públicas porque, según un informe de noviembre de la Coalición de Publicaciones Académicas y Recursos Académicos, las grandes editoriales han sido cada vez más astutas en cuanto a privacidad y vigilancia en sus contratos con las bibliotecas. Esto es un juego directo del manual del Sillicon Valley: ocultar mal comportamiento con enlaces externos no responsables o acuerdos de no divulgación que prohíben a las bibliotecas advertir a sus usuarios.

Sin leyes para detenerlos, es razonable esperar que aplicaciones populares de bibliotecas como Hoopla y Libby estén ocultando un comportamiento similar detrás de cortinas legales. Ya se ha documentado bien lo absurdo de la recopilación de datos de Amazon Kindle y es una fuente del poder monopsonístico general de Amazon en el mercado de libros.

Con las bibliotecas enfrentando la aniquilación legal desde todos los lados si intentan crear espacios libres de vigilancia para libros digitales, el futuro de la lectura está en la última hora. Los legisladores deben lanzar de inmediato una investigación para proteger no solo a los pacientes de aborto, sino a todos los lectores en todo el país.