Desaire, Heather, Aleesa E. Chua, Madeline Isom, Romana Jarosova, y David Hua. «Distinguishing Academic Science Writing from Humans or ChatGPT with over 99% Accuracy Using Off-the-Shelf Machine Learning Tools». Cell Reports Physical Science 0, n.o 0 (7 de junio de 2023). https://doi.org/10.1016/j.xcrp.2023.101426.

Investigadores de la Universidad de Kansas afirman tener una precisión del 99% en la detección de falsificaciones de ChatGPT. Los investigadores afirman que su algoritmo puede detectar escritos científicos realizados por robots con una precisión sorprendente

Científicos de la Universidad de Kansas publicaron un artículo el miércoles en el que detallan un algoritmo que, según dicen, detecta la escritura académica de ChatGPT con una precisión de más del 99%.

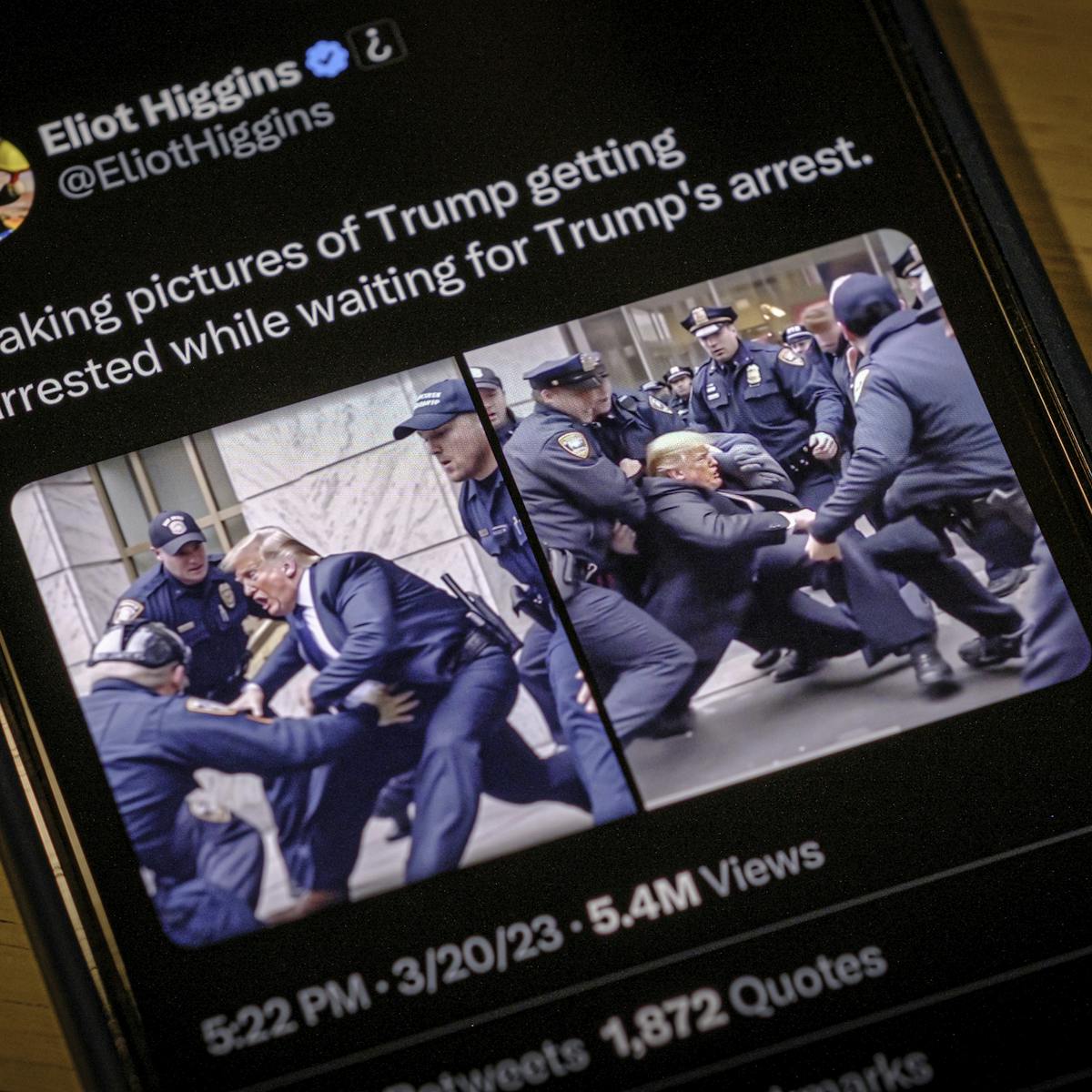

A medida que el contenido del chatbot de IA comienza a inundar el mundo, una de las mayores preocupaciones es poder distinguir de manera confiable entre las palabras de los robots y las de los seres humanos reales. Se han realizado algunos intentos de construir detectores de ChatGPT, y decenas de empresas compiten por desarrollar tecnología para detectar la IA. Pero hasta ahora, ninguna de las opciones funciona bien, incluso una construida por OpenAI, la empresa que creó ChatGPT. Las herramientas existentes son tan ineficaces que son prácticamente inútiles.

El detector de ChatGPT descrito en el artículo solo está diseñado para funcionar en contextos específicos, pero su éxito reportado parece prometedor. En el proceso de construcción, los investigadores afirman haber identificado señales reveladoras de la escritura de IA.

El artículo, que fue revisado por pares y publicado en Cell Reports Physical Science, describe una técnica que detecta artículos de investigación académica escritos por IA. El estudio seleccionó un conjunto de 64 artículos científicos escritos por autores humanos en una variedad de disciplinas, desde biología hasta física. Alimentaron esos datos a ChatGPT y lo utilizaron para producir un conjunto de datos de 128 artículos de IA con un total de 1.276 párrafos generados por el chatbot. Los científicos utilizaron esos párrafos falsos para construir su algoritmo de detección de ChatGPT. Luego crearon un nuevo conjunto de datos para probar su algoritmo con 30 artículos reales y 60 artículos escritos por ChatGPT, lo que suma un total de 1.210 párrafos.

Los investigadores afirman que su algoritmo detectó artículos completos escritos por ChatGPT el 100% de las veces. A nivel de párrafo, fue menos preciso pero aún impresionante: el algoritmo identificó el 92% de los párrafos generados por IA.

Los investigadores esperan que otros utilicen su trabajo para adaptar el software de detección a sus propios nichos y propósitos. «Nos esforzamos mucho para crear un método accesible para que, con poca orientación, incluso los estudiantes de secundaria puedan construir un detector de IA para diferentes tipos de escritura», dijo Heather Desaire, autora del artículo y profesora de química en la Universidad de Kansas, en una entrevista con EurekAlert. «Existe la necesidad de abordar la escritura de IA, y las personas no necesitan tener un título en ciencias de la computación para contribuir a este campo».

El artículo menciona algunas señales reveladoras del trabajo de ChatGPT. Por ejemplo, los escritores humanos redactan párrafos más largos, utilizan un vocabulario más amplio, incluyen más signos de puntuación y tienden a calificar sus afirmaciones con palabras como «sin embargo», «pero» y «aunque». ChatGPT también es menos específico en cuanto a las citas, como figuras y menciones de otros científicos.

El modelo desarrollado por Desaire y sus colaboradores no funcionará de manera inmediata para los profesores que esperan penalizar a los estudiantes de secundaria que hacen trampa. El algoritmo fue creado para la escritura científica, específicamente el tipo de escritura académica que se encuentra en revistas. Esto es una lástima para los formadores y gestores que, en general, han pasado los últimos seis meses preocupados por el plagio facilitado por ChatGPT. Sin embargo, Desaire afirmó que teóricamente se puede utilizar la misma técnica para construir un modelo que detecte otros tipos de escritura.

Las cosas se complican cuando consideramos el hecho de que un escritor podría realizar fácilmente pequeñas modificaciones a un texto generado por el chatbot y hacerlo mucho más difícil de detectar. Aun así, los investigadores describieron este trabajo como una «prueba de concepto» y afirman que podrían desarrollar una herramienta más robusta y quizás más precisa con un conjunto de datos más amplio.

Aunque estos resultados son prometedores, las empresas de tecnología y los defensores de la IA señalan que herramientas como ChatGPT están en sus etapas iniciales. Es imposible decir si los métodos de detección como este serán efectivos si la IA continúa desarrollándose al ritmo acelerado que hemos presenciado en los últimos años. Cuanto más se acerquen los modelos de lenguaje grandes a replicar los murmullos de la escritura humana basada en carne, más difícil será identificar las huellas del lenguaje de los robots.