California State University. “CSU Releases Findings After Conducting the Largest and Most Comprehensive Survey on Artificial Intelligence in Higher Education.” 1 de abril de 2026.

El sistema California State University (CSU) ha publicado el mayor y más completo estudio sobre inteligencia artificial en la educación superior hasta la fecha, basado en más de 94.000 respuestas de estudiantes, profesorado y personal universitario.

Este informe, titulado Ahead of the Curve, refleja un momento de transición clave en las universidades: la IA ya no es una opción emergente, sino una realidad integrada en los procesos de enseñanza, aprendizaje y gestión académica. La investigación muestra que el debate ha dejado de centrarse en si la IA debe formar parte de la educación superior, para enfocarse en cómo implementarla de forma coherente, ética y a gran escala.

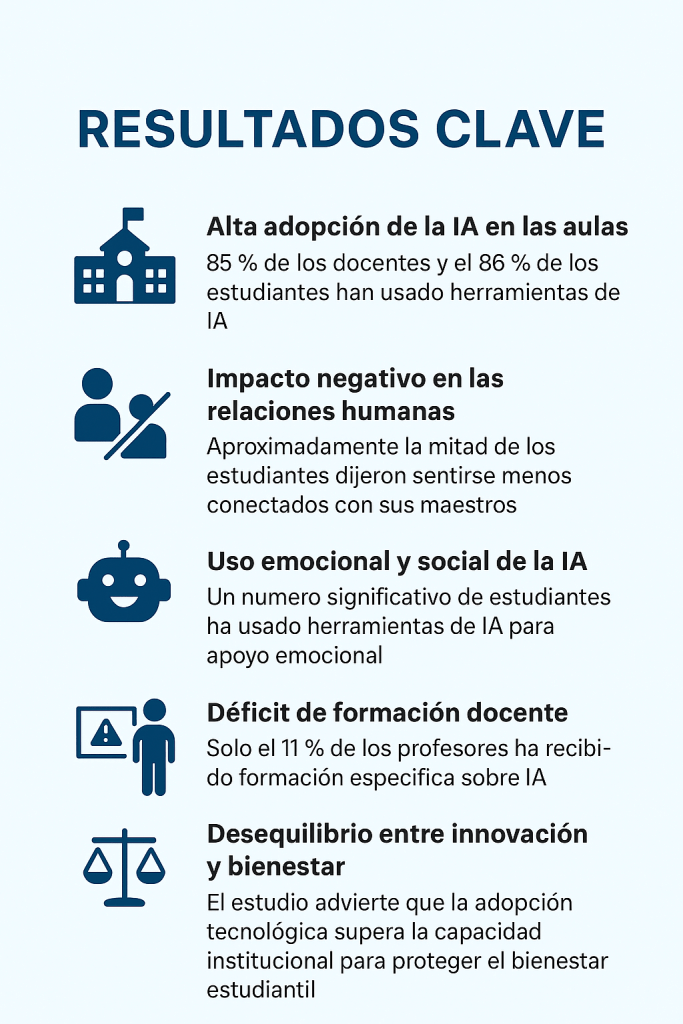

Uno de los hallazgos más significativos es el uso generalizado de herramientas de IA en toda la comunidad universitaria. La gran mayoría de estudiantes, docentes y personal ya interactúan con estas tecnologías, lo que evidencia su rápida normalización. Esta adopción se asocia a beneficios claros como el apoyo al aprendizaje, la mejora de la productividad y el impulso a la innovación académica. Sin embargo, también plantea retos importantes: la preocupación por la integridad académica, la fiabilidad de los resultados generados por IA y el posible impacto en el pensamiento crítico. La encuesta captura así una percepción ambivalente, donde entusiasmo y cautela conviven en equilibrio.

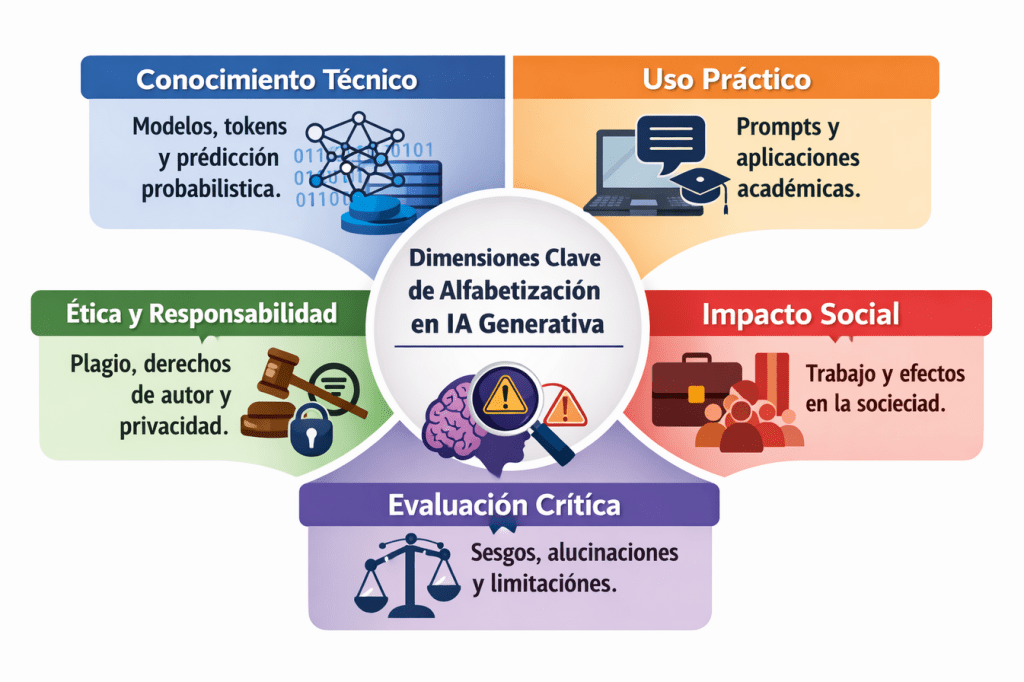

El estudio también subraya una demanda creciente de formación específica en inteligencia artificial. Tanto estudiantes como profesorado consideran necesario desarrollar competencias más avanzadas que permitan utilizar estas herramientas de manera eficaz y responsable, especialmente en contextos profesionales. Esta necesidad es más acusada en colectivos que perciben un mayor riesgo de quedar rezagados en un mercado laboral cada vez más influido por la IA. En este sentido, la universidad aparece como un agente clave para cerrar la brecha de habilidades y garantizar una integración equitativa de la tecnología.

El informe destaca la urgencia de establecer marcos éticos y normativos claros. La falta de políticas homogéneas genera incertidumbre entre los estudiantes, mientras que el profesorado reclama orientaciones precisas sobre cómo integrar la IA en la docencia sin comprometer la calidad educativa. Cuestiones como la transparencia, la verificación de contenidos, la privacidad de los datos y la equidad en el acceso emergen como prioridades. En conjunto, el estudio del CSU posiciona a la educación superior ante un desafío estructural: liderar el uso responsable de la inteligencia artificial sin renunciar a sus principios fundamentales de rigor académico y formación crítica.

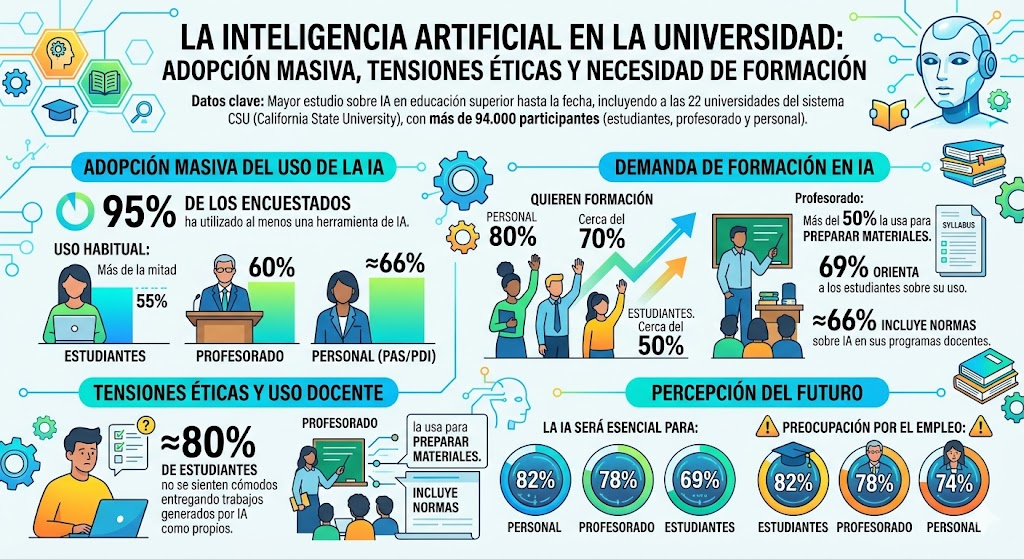

Datos clave:

- Más de 94.000 participantes (estudiantes, profesorado y personal).

- Es el mayor estudio sobre IA en educación superior hasta la fecha.

- Incluye a las 22 universidades del sistema CSU.

Uso

95% de los encuestados ha utilizado al menos una herramienta de IA.

Uso habitual:

- Más de la mitad de los estudiantes

- 60% del profesorado

- ≈66% del personal

Formación en IA

- Más del 80% del personal quiere formación en IA. Aproximadamente 70% del profesorado también la demanda.

- Estudiantes: cerca del 50%,

Ética IA

- ≈80% de estudiantes no se sienten cómodos entregando trabajos generados por IA como propios.

Uso docentes

- Más del 50% del profesorado usa IA para preparar materiales.

- 69% orienta a los estudiantes sobre su uso.

- ≈66% incluye normas sobre IA en sus programas docentes.

Percepción del futuro

- La IA será esencial para:

– 82% del personal

– 78% del profesorado

– 69% de estudiantes

Preocupación por el empleo:

- 82% estudiantes

- 78% profesorado

- 74% personal