Publish or perish? Faculty publishing decisions and the RPT process. By Meredith T. Niles, Lesley Schimanski, Erin McKiernan, and Juan Pablo Alperin – with Alice Fleerackers. En Scholarly Communications Lab JULY 30, 2019

A medida que los puestos de profesor titular se vuelven cada vez más competitivos, la presión para publicar -especialmente en revistas de «alto impacto»- nunca ha sido mayor. Como resultado, muchos de los académicos de hoy en día creen que es necesario contar con un sólido historial de publicaciones para el proceso acreditación académica. Para algunos, publicar se ha convertido en sinónimo de éxito profesional.

Sin embargo, se sabe poco acerca de las percepciones de los académicos sobre el proceso de acreditación y cómo influyen en sus decisiones editoriales. ¿Qué resultados de investigación creen los profesores que se valoran en las decisiones de acreditacion? ¿Cómo afectan estas creencias dónde y qué publican?

Para averiguarlo, los autores llevaron a cabo una encuesta a los profesores de 55 instituciones académicas de Estados Unidos y Canadá, preguntándoles sobre sus propias prioridades de publicación y las de sus colegas, así como la importancia de sus percepciones en la revisión, promoción y permanencia en el cargo (acreditación).

¿Dónde publicar?

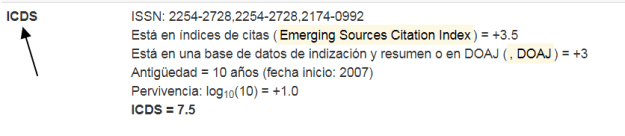

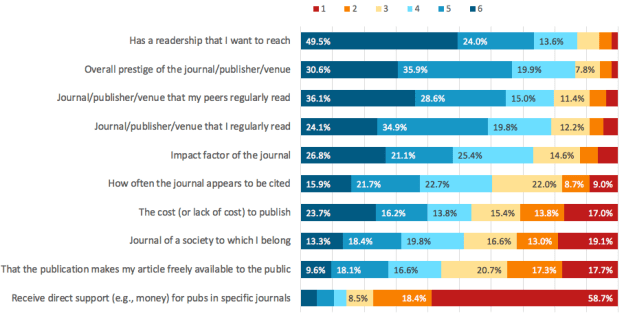

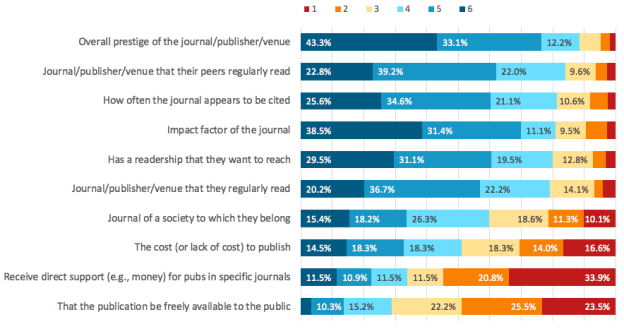

Cuando se trata de decidir dónde publicar su trabajo, los investigadores informaron que valoraban a la audiencia de la revista por encima de los demás factores. Los tres factores principales que identificaron fueron:

- Si la revista era leída por el público al que querían llegar

- El prestigio general de la revista

- Si la revista era leída regularmente por sus colegas

Por supuesto, otros factores, como el factor de impacto de la revista (JIF) o las tarifas asociadas a la publicación, seguían siendo importantes para muchos profesores, pero en menor medida que los lectores.

Se vieron algunas diferencias demográficas significativas entre los profesores en sus prioridades de publicación. Por ejemplo, los encuestados no titulares -que están bajo mayor presión para desempeñarse que los profesores titulares- conceden mayor importancia al Factor de Impacto (JIF). Los profesores más jóvenes también fueron más dados a priorizar factores como la frecuencia de las citas de las revistas y el prestigio de las mismas, en comparación con los colegas establecidos.

Sin embargo, a la hora de evaluar las prioridades editoriales de los demás, el profesorado respondió de forma muy diferente. Creían que sus colegas tienden más a valorar factores como el prestigio de la revista y el Factor de Impacto a la hora de decidir dónde publicar su trabajo. También creen que sus colegas tienen menos probabilidades de tomar decisiones basadas en el número de lectores de la revista o que esté en acceso abierto.

¿Qué consideran que es lo más importante en el proceso de acreditación?

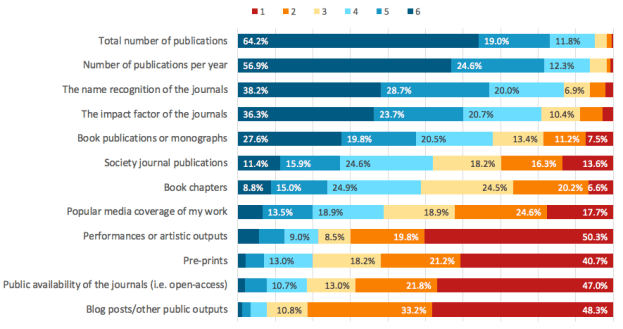

Los investigadores identificaron los siguientes tres factores como los más importantes para las decisiones de acreditación:

- Número total de publicaciones

- Número de publicaciones por año

- Reconocimiento de nombres de revistas

Encontrando una notable disociación entre sus propias prioridades editoriales y lo que consideraban que beneficiaría a sus carreras.

Una vez más, hubo importantes diferencias demográficas entre el profesorado, ya que los encuestados de mayor edad y con permanencia en el cargo -los más propensos a formar parte de los comités de acreditación científica – son menos dados a valorar el prestigio de las revistas y los indicadores de publicación, en comparación con los encuestados no titulares.

Finalmente, se estudio cómo las percepciones de los académicos sobre el proceso de acreditación científica afectaban sus propias prioridades de publicación a través de una serie de modelos. En resumen, se encontró que estas percepciones de lo que es valorado por el proceso de acreditación son más dadas a predecir las decisiones de publicación que la edad, el género o la historia de la publicación.

Conclusión

En conjunto, estos resultados ofrecen un panorama complejo de las presiones que enfrentan los profesores a la hora de decidir dónde publicar sus trabajos. Por un lado, la mayoría de los académicos valoran el número de lectores de una revista por encima de sus métricas de citación. Sin embargo, este valor está en desacuerdo con los factores que creen que les ayudarán a tener éxito en el proceso de acreditación -la cantidad de publicaciones y la reputación de la revista-, aunque el profesorado titular y los que a menudo forman parte de los comités de acreditación no valoran estos factores como algo muy importante. A esto se suman los desajustes entre las propias prioridades editoriales del profesorado y la forma en que perciben las de sus colegas. Tales desacuerdos ponen de relieve caminos claros para la discusión en el ámbito académico sobre lo que las comunidades valoran más.