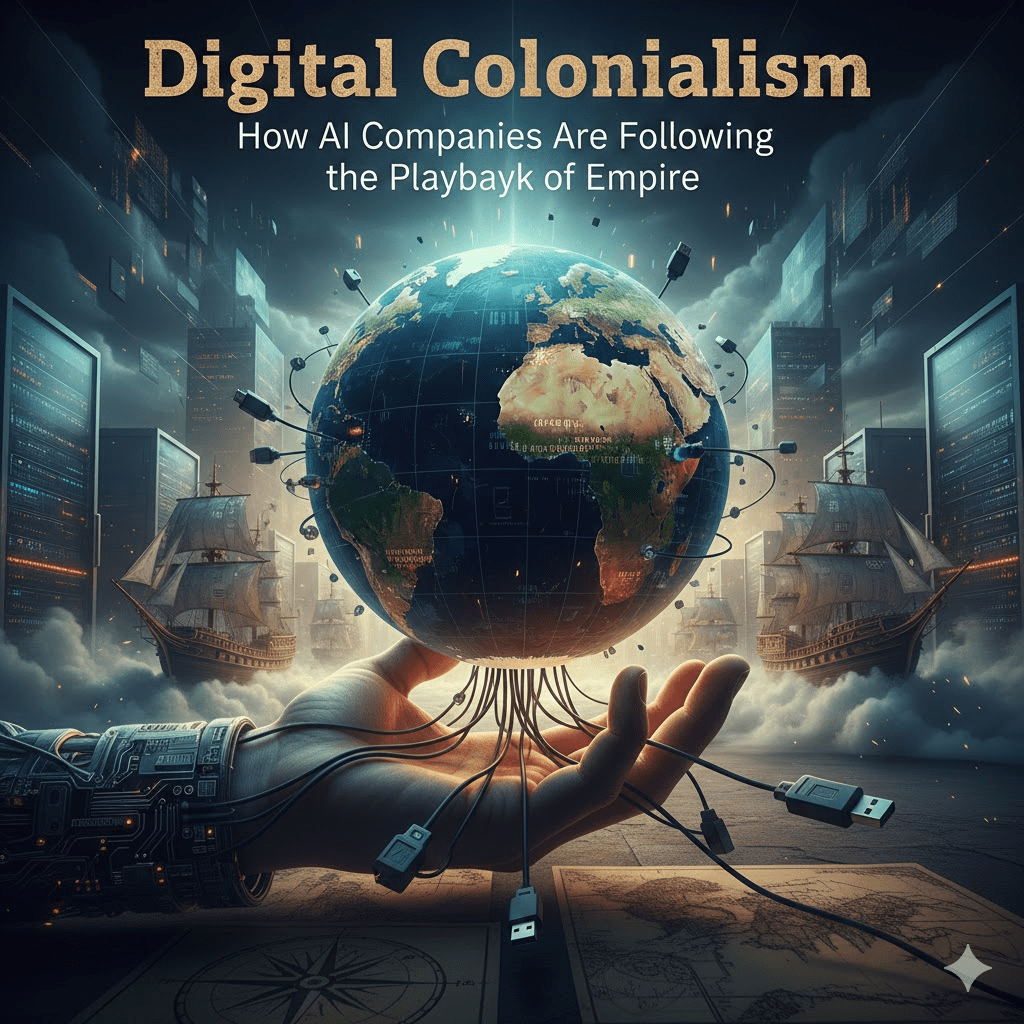

Russ‑Smith, Jessica y Michelle Lazarus. 2025. “Digital colonialism: How AI companies are following the playbook of empire.” The Conversation, 26 de noviembre de 2025. https://theconversation.com/digital-colonialism-how-ai-companies-are-following-the-playbook-of-empire-269285 (consultado el 24 de febrero de 2026).

Las grandes empresas de inteligencia artificial están replicando prácticas históricas de colonialismo en el entorno digital contemporáneo. Según las autoras, compañías como OpenAI y Google utilizan cantidades enormes de datos disponibles en Internet —fotos, textos, videos, obras artísticas y otros contenidos— para entrenar sus algoritmos sin el consentimiento explícito ni compensación de los creadores originales, lo que simboliza una apropiación de recursos culturales y cognitivos parecida a la lógica extractiva de los antiguos imperios coloniales.

Esta dinámica se legitima muchas veces a través de interpretaciones amplias de doctrinas legales como el “uso justo” (fair use) en el derecho de autor estadounidense, mientras que al mismo tiempo las mismas empresas protegen vehementemente su propiedad intelectual.

Las autoras trazan un paralelo entre la noción de terra nullius —un concepto legal colonial que declaraba territorios como “tierra de nadie” para justificar su apropiación— y cómo las empresas de IA tratan los datos personales y comunitarios como si no pertenecieran a nadie. Así como los colonizadores asumían que las tierras indígenas no tenían dueño legítimo, las grandes plataformas tecnológicas asumen implícitamente que la vasta colección de datos en línea está disponible para uso y explotación sin negociación ni consentimiento verdaderos. Esto se ve intensificado por prácticas de “consentimiento agrupado”, donde al usuario se le presenta un único botón de “aceptar todo” para servicios o actualizaciones, lo que en realidad no deja opción real si se quiere continuar accediendo a herramientas esenciales del mundo digital.

En el texto también se exploran formas de resistencia y alternativas a esta situación. Se destaca la importancia de los movimientos por la soberanía de los datos liderados por comunidades originarias, que proponen modelos en los que la propiedad, el control y la gobernanza de los datos pertenecen a las personas o comunidades que los generan. Estas propuestas implican mecanismos como la “continuidad del consentimiento”, en los que cada solicitud de acceso a datos exige un permiso específico y continuo, y la negociación colectiva para decisiones sobre uso y acceso. Asimismo, se mencionan casos de litigios legales contra prácticas de scraping de datos por parte de empresas de IA, como demandas de plataformas digitales o de autores por el uso no autorizado de material para entrenar modelos, lo que indica que la resistencia legal y social contra el colonialismo digital ya está en marcha.

Las autoras concluyen que aunque las empresas de IA pueden parecer todopoderosas, las estrategias históricas de resistencia al colonialismo —desde luchas jurídicas hasta reivindicaciones de derechos colectivos— ofrecen modelos para desafiar la lógica extractiva en el ámbito digital. Construir un futuro digital más justo implica reconocer los derechos sobre los datos como derechos humanos y comunitarios, promover marcos legales que protejan esos derechos, y fomentar prácticas tecnológicas que no reproduzcan desigualdades ni apropiaciones no consentidas de conocimiento y cultura.