![[]](https://i0.wp.com/farm3.staticflickr.com/2743/13104946655_f6a4b4599e_d.jpg)

Mapa del Academic Ranking of World Universities (ARWU) o ranking de Shanghai

Las Agencias de Evaluación y entidades financieras necesitan una medida objetiva de la calidad de las publicaciones, Consecuentemente existe una demanda de medidas de este tipo. El Factor de Impacto (también conocido como Índice de impacto), es una medida de la importancia de una publicación científica. Cada año es calculada por el ISI o Institute for Scientific Information para aquellas publicaciones a las que da seguimiento, las cuales son publicadas en un informe de citas llamado Journal Citation Report. El Factor de Impacto tiene una influencia enorme, pero controvertida. Al ya tradicional Journal Citation Report del ISI se han ido sumando algunas otras alternativas bien en la forma de medir dicho impacto (Índice de Hirsch, Scimago Journal Rank), bien en la cobertura temática o la de procedencia geográfica de las revistas (IN-RECS, IN-RECJ, RESH, IHCD…).

El factor de impacto de una revista es la media de veces que en un año determinado fueron citados los artículos publicados por esta revista en los dos años anteriores. El FI tienen algunas ventajas que hay que considerar: Su cobertura internacional amplia con más de 8400 publicaciones de 60 países, los resultados son publicados y disponibles (FEYCIT) y es fácil de usar y entender.

Por ejemplo, el artículo de Oliver H. Lowry, Nira J. Rosenbrough, A. Lewis Farr, Rose J. Randall, “Protein Measurement with the Folin Phenol Reagent,” The Journal of Biological Chemistry (JBC) 193: 265-275, 1951, está considerado el artículo más citado de toda la historia de la ciencia (según el ISI Web of Science 1945-2010). En julio de 2005 ya contaba con 293.328 citas. Sin embargo Albert Einstein, ha sido citado a día de hoy sólo 6647 veces. La revista con mayor índice de impacto de todas es CA-A Cancer Journal for Clinicians (94,262). Este año España tiene 76 revistas con impacto (en 2009 tuvo 59 y en 2008 solo 37).

La Web of Science y su correspondiente factor de impacto son insuficientes para la comprensión del impacto de los trabajos académicos de las regiones en desarrollo, pero en contraposición las métricas alternativos ofrecen una gran oportunidad para reorientar las estructuras de incentivos hacia los problemas que contribuyen al desarrollo, o al menos a las prioridades locales. Se ha escrito mucho sobre las limitaciones metodológica de los sistemas de medición del impacto de las publicaciones científicas, y son los académicos de las regiones en desarrollo los que están sufriendo las más graves consecuencias. Problemas derivados de los sesgos disciplinares, ya que en estos índices están más representadas las ciencias, que las humanidades y las ciencias sociales, además el comportamiento de los usos de cita y obsolescencia son muy distintos en unos y otros áreas. Quizás los 2 años de medición que tiene Web of Knowledge son suficientes para las ciencias por su alto índice de obsolescencia, pero no para el resto de áreas de conocimiento. Sesgos lingüísticos, fundamentalmente están representadas las lenguas anglosajonas respecto al resto; otras cuestión importantes son la relativa a las áreas geográficas representadas, que tienen que ver con los países más desarrollados, e incluso con los emergentes, ya que la política de aceptación de revistas en Web of Knowdlge si bien aparece establecida en su página y da unas pautas aparentemente claras, en la realidad no es tan transparente. Cada año Thomson Reuters evalúa aproximadamente 2.000 revistas para la inclusión de las mismas en Web of Science. En el este enlace podrá encontrar información sobre los criterios de selección que utiliza Thomson Reuters para la inclusión de revistas.

Una muestra de todo esto es un estudio de Kahn “A bibliometric study of highly cited reviews in the Science Citation Index expanded™.” sobre los documentos muy citados en Journal Citation Report, estudia aquellos que se citaron al menos 1000 veces desde su publicación hasta 2011 (un total de 1,857), fueron identificados en la base de datos Science Citation Index Expanded ™ (Thomson Reuters, Nueva York) entre 1899 y 2011. Si se analiza la autoría, entre los autores más citados, en el 33% de los casos eran obras de un sólo autor, el 61 % eran de una sola institución, y el 83 % eran de un único país. Estados Unidos ocupa el primer lugar en los 6 indicadores. Los países de G7 (Estados Unidos, Reino Unido, Alemania, Canadá, Francia, Japón e Italia) fueron escenario de casi todas los documentos muy citados. Las 12 instituciones más productivas son de Estados Unidos con la Universidad de Harvard y Texas como líderes. Revistas. Las 3 revistas más productivas fueron Chemical Reviews, Nature y Annual Review of Biochemistry.

El problema para las regiones en desarrollo se deben a la escasa representación de la investigación mundial en Web de Thomson Reuters of Science (WoS). La falta de investigación de las regiones en vías de desarrollo no es la falta de investigación, es la baja represntación en los índices oficiales. En América Latina, en 2012, sólo el 4% de revistas revisadas por pares fueron incluidos en WoS, un total de 242 de más de 5000; sin embarfo SciELO y RedALyC , trabajando sólo con un subconjunto de estas 5.000 + revistas, han indexado más de medio millón de artículos en revistas regionales, principalmente de autores latinoamericanos. Thomson Reuters recientemente anunció una alianza con SciELO, en el que las 650 revistas en SciELO se indexarán y aparecen en la Web of Knowledge. (Alperin, Juan Pablo, 2014) El argumento a favor de esta tendencia ha sido siempre que la investigación del mundo en desarrollo no forma parte de la “corriente principal” o la ciencia “internacional”. Si bien también se podría argumentar en contra diciendo que WoS es un conjunto de datos insuficientes para comprender el impacto de las comunicaciones académicas de las regiones en desarrollo.

Por otra parte, los medios sociales están generando una influencia en los procesos de comunicación científica y en los hábitos y comportamientos de los investigadores de todas las disciplinas. La influencia generada por los medios sociales ha sido calificada como Investigación 2.0, Social Reference o Altmetrics. Almetrics recoge las menciones de artículos académicos de todas partes de la Web mediante la recopilación de menciones en los periódicos, blogs, redes sociales y otros sitios web. Algunas de estas herramientas como Almetric.com, en cuestión de minutos, permiten al autor disponer de los datos almétricos para mostrarlos en su plataforma o aplicación. Las métricas alternativas tienes algunas críticas relativas a la falta de uniformidad normalización de las estadísticas, posibilidades de manipulación de datos, y a que se trata de una simple medida de uso y no de influencia científica. Recientemente miembros del grupo EC3 de la universidad de Granada crearon un perfil falso en homenaje a dos de los más grandes ciclistas del panorama internacional que llamaron “Marco Alberto Pantani-Contador” para demostrar que era sencillo manipular estas herramientas. El texto, carente de sentido alguno, fue copiado y pegado de la página web del grupo de investigación al que pertenecen, y traducido al inglés con Google Translator. Los investigadores dividieron a su vez el falso paper en seis artículos, citando en cada uno de ellos otros 129 trabajos científicos. El resultado no se hizo esperar: los tres autores materiales de este experimento, a quienes Pantani-Contador citaba en su falso artículo, vieron cómo aumentaban considerablemente sus citas en Google Scholar.

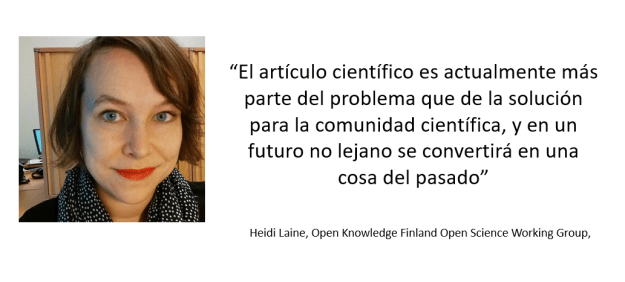

Algo se está moviendo en el contexto:

- Hoy en día incluso multinacionales de la información científica como Elsevier, que ha sido durante mucho tiempo un defensor a ultranza de la informetría robusta está interesándose en la comprensión de cómo se pueden utilizar estas nuevas medidas en relación con los datos de uso y citación, para proporcionar nuevos indicadores significativos para la comunidad investigadora.

- También en la 14ª edición del Ranking Web de Repositorios, en su última versión de 2014 incluye mediciones Altmetrics de las siguientes fuentes en el indicador Visibilidad: Academia, Facebook, LinkedIn, Mendeley, ResearchGate, Slideshare, Twitter, Wikipedia (todas las ediciones), Wikipedia (versión Inglés) y YouTube (25%)

- Otro ejemplo es Plos con Un ejemplo de estos sistemas es el modelo ALMs de PLoS Article Level Metrics que se encargan de hacer la recopilación de estas evidencias tales como su cobertura en blogs, cobertura en noticas y presentarla a sus lectores.

- Una herramienta similar en Altmetric.com que bajo suscripción muestra el impacto de la investigación a sus autores y lectores de modo muy gráfico y nuevo. Monitorear, buscar y medir todas las conversaciones acerca de los artículos de una revista, así como los publicados por sus competidores. Recoge las menciones de artículos académicos de todas partes de la Web mediante la recopilación de menciones en los periódicos, blogs, redes sociales y otros sitios web. En cuestión de minutos, permite al autor disponer de los datos Altmetrics para mostrarlos en su plataforma o aplicación. El algoritmo Altmetric.com calcula una puntuación global teniendo en cuenta el volumen, la fuente y el autor en función de las menciones que recibe un documento. Esto incluye las menciones de artículos académicos sobre los sitios de medios sociales (por ejemplo, Twitter, Facebook, Pinterest, Google+), blogs científicos, muchos medios de comunicación convencionales, incluyendo The New York Times, TheGuardian, las publicaciones en idiomas distintos al inglés, como Die Zeit y Le Monde y publicaciones de interés especial como Scientific American y New Scientist, sitios de revisión por pares de referencia como Publons.

Todos estos signos indican que altmetrics pueden no seguir siendo alternativa por mucho tiempo. lo que es especialmente atractivo para aquellas disciplinas y áreas que tradicionalmente han sido excluidas del análisis bibliométrico, ya que no están suficientemente representadas en bases de datos como Web of Science (WoS) o Scopus, como las ciencias sociales y las humanidades.

Un documento muy interesante a este respecto es Users, narcissism and control – tracking the impact of scholarly publications in the 21st century, de SURFfoundation publicado en 2012, y cuyo cuyo objetivo es contribuir al desarrollo de herramientas más útiles para la comunidad científica y académica. Este programa debe abordar por lo menos las siguientes herramientas: F1000 , Microsoft Academic Research, Total-Impact, PlosONE altmetrics, y Google Scholar Citations , Mendeley. El libro informa sobre el seguimiento del impacto de las publicaciones académicas en el siglo 21 que debe de tener en cuenta cualquier investigador. muy recomendable para potenciar la investigación.

Bibliografía:

Juan Pablo Alperin “ Altmetrics could enable scholarship from developing countries to receive due recognition” LSE, 2014 Ho, Y.-S. and M.

Kahn “A bibliometric study of highly cited reviews in the Science Citation Index expanded™.” Journal of the Association for Information Science and Technology vol. 65, n. 2 (2014). pp. 372-385.

Delgado López-Cózar, Emilio; Robinson?García, Nicolás; Torres?Salinas Daniel. The Google Scholar Experiment: how to index false papers and manipulate bibliometric indicators. Journal of the American Society for Information Science and Technology (2013). Article first published online: 11 NOV 2013. DOI: 10.1002/asi.23056.

Delgado López?Cózar, E.; Robinson?García, Nicolás; Torres?Salinas Daniel. Science Communication: Flawed Citation Indexing. Science 6 December 2013: Vol 342, no. 6163, p. 1169. DOI: 10.1126/science.342.6163.1169-b.

![[]](https://i0.wp.com/farm3.staticflickr.com/2743/13104946655_f6a4b4599e_d.jpg)