Dean, Clare. 2025. Leveraging Data Citations to Respond to Libraries’ Data Evaluation Needs. Zenodo. https://doi.org/10.60804/yxna-f837

Se presenta un estudio sobre cómo la automatización de citas de datos puede mejorar las métricas de datos abiertos y ayudar a las bibliotecas a evaluar el uso y el impacto de los conjuntos de datos generados por sus instituciones.

Las bibliotecas desempeñan un papel clave en la promoción de los datos abiertos y necesitan evaluar el uso e impacto de los conjuntos de datos para apoyar la gestión de datos de investigación y reconocer el trabajo de sus investigadores. Sin embargo, medir este impacto es complejo debido a la dispersión y falta de visibilidad de la información.

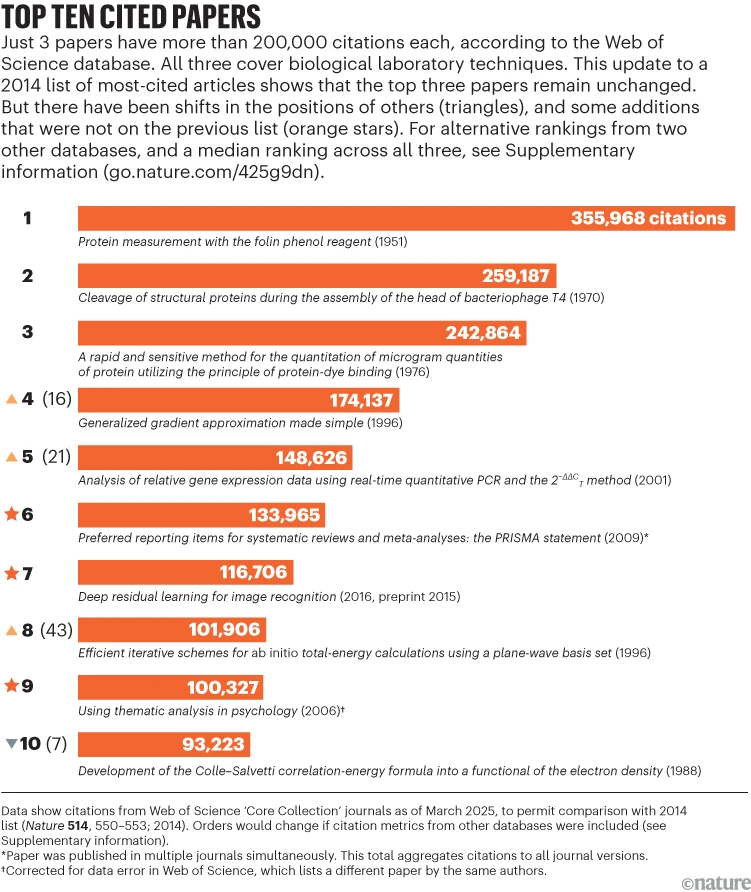

Una solución prometedora es el uso de citas de datos como indicadores de utilización. Para demostrar su valor, se analizó el uso de datos en la Universidad Northwestern y la Universidad de Colorado Boulder mediante el Data Citation Corpus y Europe PMC. Se observó un aumento significativo de citas entre 2020 y 2023, con un pico en 2021. Los repositorios más citados fueron dbSNP, Protein Data Bank y European Nucleotide Archive, reflejando un fuerte enfoque en biomedicina y biología estructural.

En cuanto a áreas intensivas en datos, Northwestern destaca en investigación médica y neurociencia, mientras que Colorado Boulder lo hace en ciencias ambientales y biología vegetal. Las citas provienen principalmente de revistas especializadas en dichas disciplinas.

1. Objetivo principal

Mejorar la capacidad de las bibliotecas para rastrear, analizar y reportar el impacto de los datos de investigación utilizando citas automatizadas a gran escala, especialmente a través del Data Citation Corpus.

2. Instituciones involucradas

- University Libraries, University of Colorado Boulder

- Helmholtz Open Science Office, Alemania

- Northwestern University Feinberg School of Medicine

3. Hallazgos clave (Key Data Citation Insights)

- Los datos de Northwestern se citan más en revistas de ciencias de la vida y biomédicas.

- Los datos de CU Boulder se usan más en revistas específicas de campos como ciencias ambientales.

Áreas de investigación intensiva en datos:

- CU Boulder: Ciencias ambientales, biología molecular y genética, ciencias de las plantas.

- Northwestern: Investigación médica, bioquímica, biología molecular, neurociencia.

Se concluye que las citas de datos ofrecen información valiosa para las estrategias institucionales, y se está ampliando el Data Citation Corpus con nuevas fuentes y mejoras en los metadatos. También se están desarrollando recursos para que las bibliotecas integren estas métricas en procesos de evaluación institucional junto con iniciativas como HELIOS Open.