Resoomer

https://resoomer.com/

Resoomer es una aplicación en línea que permite resumir textos automáticamente. Es útil para estudiantes, profesionales y cualquier persona que necesite procesar rápidamente grandes volúmenes de información. Su algoritmo identifica las ideas principales, haciendo resúmenes claros y concisos. Permite subir documentos en diferentes formatos (PDF, DOCX, TXT) y tiene una extensión para navegador que facilita resumir artículos en línea. Es ideal para agilizar la lectura y mejorar la comprensión de textos largos.

Resoomer es una innovadora aplicación en línea diseñada para facilitar la lectura y comprensión de textos largos mediante el uso de algoritmos avanzados que permiten resumir automáticamente documentos y artículos. Esta herramienta es especialmente útil para estudiantes, profesionales, investigadores, periodistas y cualquier persona que necesite procesar rápidamente grandes cantidades de información, sin perder de vista las ideas clave. Gracias a su tecnología de procesamiento de lenguaje natural (PLN), Resoomer identifica y extrae las partes más relevantes de un texto, creando resúmenes claros y concisos en cuestión de segundos.

¿Cómo funciona Resoomer?

El algoritmo de Resoomer se basa en técnicas de análisis semántico, lo que le permite comprender la estructura y el contenido de un texto. Este análisis le permite identificar las frases o párrafos que contienen las ideas principales del documento. Posteriormente, la herramienta las reescribe de manera breve, eliminando las partes secundarias o menos relevantes, lo que da como resultado un resumen eficiente que facilita la lectura y comprensión del material original.

Resoomer también se adapta a diferentes tipos de documentos, permitiendo a los usuarios cargar archivos en varios formatos como PDF, DOCX y TXT. Esto es especialmente útil para quienes trabajan con documentos largos o complejos, ya que pueden obtener resúmenes de sus materiales de trabajo de forma rápida y precisa, sin necesidad de leer el texto completo.

Ventajas principales de Resoomer

Ahorro de tiempo: En lugar de leer páginas y páginas de información, los usuarios pueden obtener un resumen conciso de los puntos clave del contenido, lo que les permite optimizar su tiempo de estudio o trabajo.

Mejora de la comprensión: Al resaltar las ideas principales y eliminar información secundaria, ayuda a los usuarios a entender mejor el mensaje central de un texto, lo que mejora su capacidad para retener información.

Versatilidad: es compatible con diferentes formatos de documentos (como PDFs, DOCX y TXT), lo que lo convierte en una herramienta muy versátil para estudiantes, académicos, profesionales y cualquier persona que necesite procesar documentos de diferentes tipos.

Extensión de navegador: ofrece una extensión para navegador que permite resumir artículos en línea sin necesidad de copiar y pegar el texto en la aplicación. Esta funcionalidad es ideal para aquellos que leen artículos largos o informes en la web y desean obtener rápidamente un resumen.

Facilidad de uso: La interfaz es simple e intuitiva, lo que hace que cualquier persona pueda comenzar a utilizarla sin necesidad de tutoriales complicados. Solo se necesita cargar el documento o artículo, y en poco tiempo, el resumen estará listo para ser consultado.

Aplicaciones prácticas en distintos campos

La herramienta se utiliza en una amplia variedad de campos debido a su versatilidad y efectividad. Algunos ejemplos incluyen:

Estudiantes: Los estudiantes pueden utilizar la aplicación para procesar textos académicos, libros de texto o artículos de investigación. Esto les permite obtener resúmenes de gran calidad para sus trabajos y exámenes, ahorrando tiempo y mejorando su comprensión de los temas estudiados.

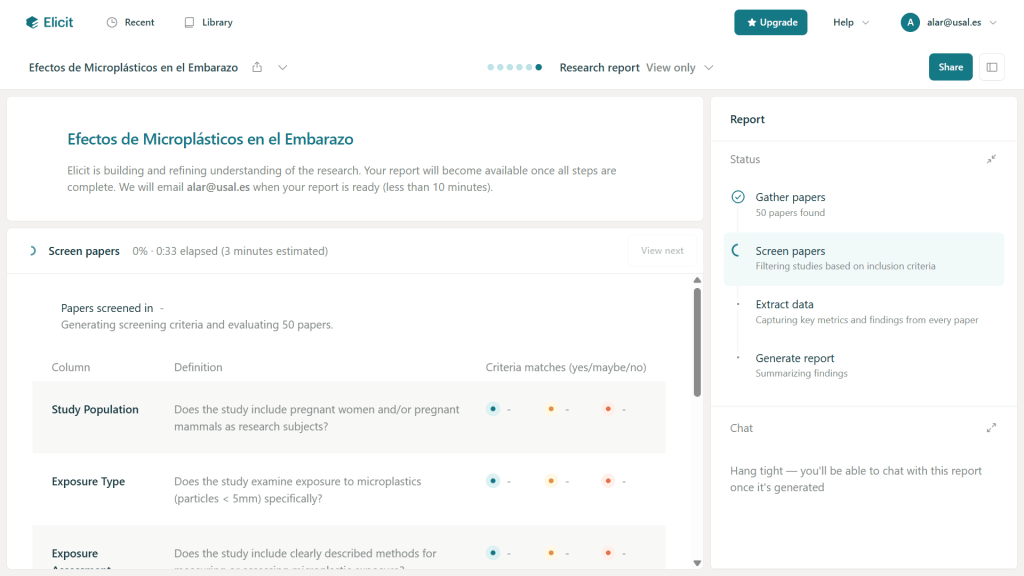

Investigadores y académicos: Aquellos que se dedican a la investigación a menudo deben leer una gran cantidad de documentos científicos y técnicos, ya que les ayuda a obtener resúmenes rápidos de los artículos y papers, lo que les permite filtrar la información relevante sin tener que leer el texto completo.

Profesionales: Los profesionales que manejan grandes volúmenes de información en su día a día (como abogados, médicos, consultores, etc.) pueden beneficiarse enormemente de Resoomer, ya que les permite obtener resúmenes rápidos de documentos complejos o largos, ayudándoles a tomar decisiones informadas más rápidamente.

Periodistas: Los periodistas que deben leer y analizar diversas fuentes para redactar artículos o informes pueden utilizarla para simplificar el proceso de análisis de las fuentes, permitiéndoles concentrarse en los aspectos más importantes de las noticias o temas que están cubriendo.

Limitaciones y recomendaciones

A pesar de sus numerosas ventajas, la herramientar tiene algunas limitaciones que deben tenerse en cuenta. Aunque el algoritmo es bastante preciso en la identificación de ideas principales, no siempre puede captar el tono o contexto de un texto, lo que podría llevar a resúmenes que omiten matices importantes. Además, la calidad del resumen puede variar según la complejidad del texto original. En textos muy técnicos o especializados, es posible que se necesite una revisión manual para asegurarse de que todas las ideas clave han sido capturadas correctamente.

Para obtener los mejores resultados, se recomienda utilizar la aplicación como una herramienta complementaria en lugar de una solución única. Es ideal para obtener un primer borrador de un resumen que luego puede ser ajustado y enriquecido según las necesidades del usuario.