Bastidas, Sebastián, y Leonardo Osorio. 2023. «ChatGPT in Scientific Research and Writing: A Beginner’s Guide.» ResearchGate. https://www.researchgate.net/publication/384032901_ChatGPT_in_Scientific_Research_and_Writing_A_Beginner’s_Guide

Una introducción completa y práctica al uso de ChatGPT en el ámbito de la investigación científica y la redacción académica. Se enfoca en explicar cómo esta herramienta de inteligencia artificial puede asistir a los investigadores, especialmente a quienes están comenzando, en diversas etapas del proceso científico.

Primero, el texto detalla las capacidades de ChatGPT para generar textos coherentes, resumir información, ayudar en la formulación de preguntas de investigación y apoyar en la redacción de manuscritos, desde la introducción hasta la discusión. Destaca que ChatGPT puede agilizar la revisión bibliográfica y facilitar la generación de ideas, lo cual puede ser valioso para investigadores novatos o con limitaciones de tiempo.

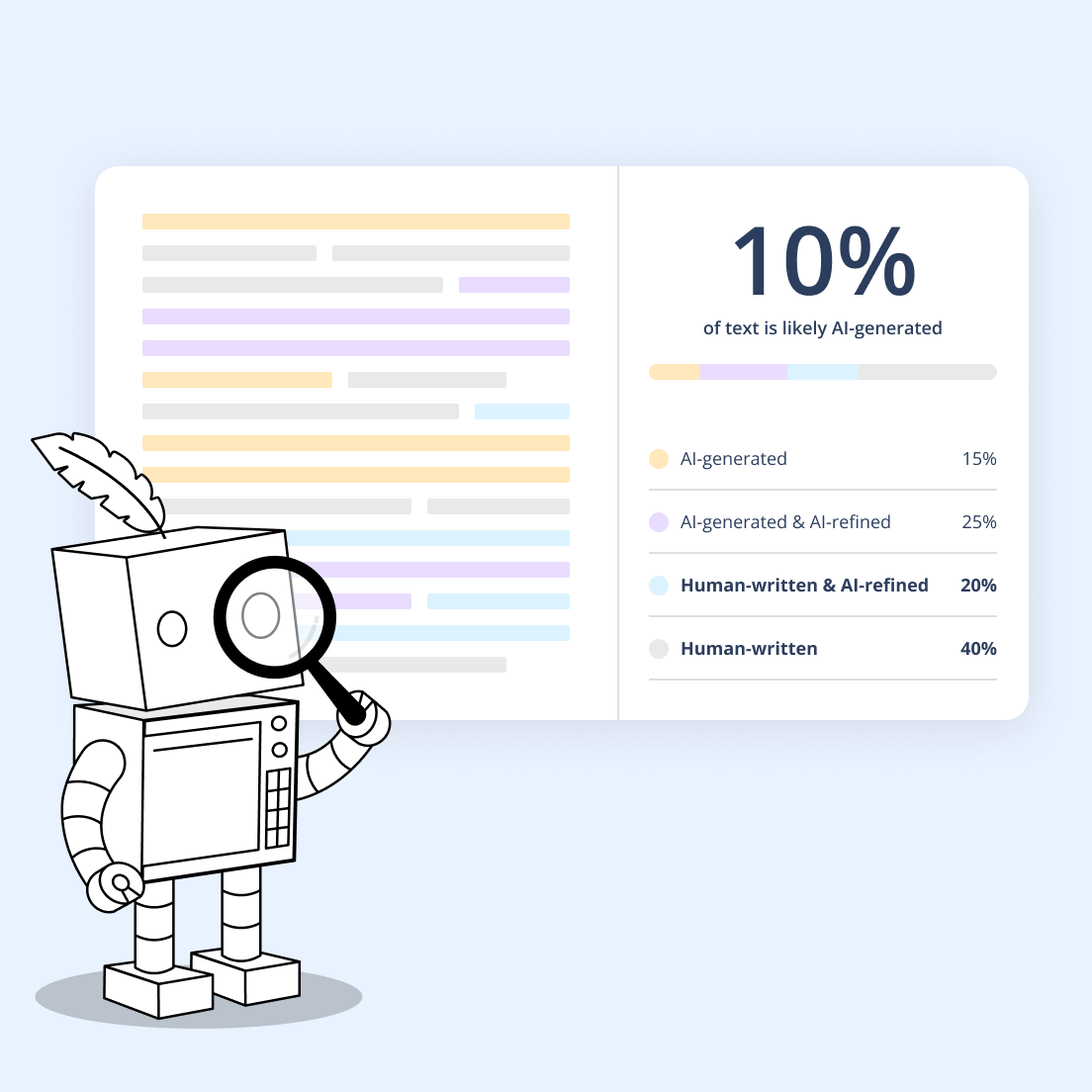

Sin embargo, el libro también subraya las limitaciones y riesgos asociados al uso de ChatGPT. Señala que la IA puede producir información incorrecta o inventada («alucinaciones»), por lo que los usuarios deben validar rigurosamente cualquier contenido generado antes de incorporarlo en trabajos científicos. Además, advierte sobre cuestiones éticas, como la necesidad de transparencia en el uso de IA y la importancia de evitar el plagio o la dependencia excesiva.

El texto proporciona consejos prácticos para integrar ChatGPT en el flujo de trabajo científico, enfatizando que la IA debe ser una herramienta complementaria y no un sustituto del juicio crítico o la revisión humana. También incluye recomendaciones para mejorar la interacción con la IA, como el uso de indicaciones claras y específicas, y para comprender mejor sus capacidades y limitaciones.

En conclusión, el artículo presenta a ChatGPT como un recurso innovador y prometedor para mejorar la eficiencia en la investigación y la redacción, siempre que se utilice con responsabilidad y conciencia de sus limitaciones técnicas y éticas. Su enfoque introductorio lo hace ideal para investigadores principiantes que buscan familiarizarse con el potencial y los desafíos de la inteligencia artificial aplicada a la ciencia.