Chisaba‑Pereira, Cristian‑Alejandro; Herrera‑Calero, Ricardo; Niño‑Neira, Saúl‑Alejandro; Hurtado‑Ortiz, Britney‑Alejandra. “Datalogación: evaluación de herramientas de inteligencia artificial basadas en el Modelo Extenso de Lenguaje (Large Language Model) para la automatización de la descripción de libros.” Infonomy 3, no. 4 (18 julio 2025). Accedido 31 julio 2025.

Texto completo

La catalogación bibliotecaria ha sido históricamente uno de los procesos más importantes y laboriosos en las bibliotecas, permitiendo describir y organizar el conjunto de obras y recursos que se evidencian en catálogos, índices, directorios y tesauros. Con el surgimiento de la inteligencia artificial y específicamente de los Modelos Extensos de Lenguaje (Large Language Models), surge la oportunidad de transformar radicalmente estos procesos tradicionales, generando tanto oportunidades como desafíos significativos para la profesión bibliotecológica.

La catalogación tradicional de libros representa un proceso complejo y laborioso que requiere que los bibliotecarios analicen minuciosamente cada documento para crear registros bibliográficos detallados y precisos. En este contexto, la catalogación automatizada ha emergido como una solución tecnológica prometedora. En la catalogación automatizada se utiliza el ISBN del libro o ISSN de la revista para hacer la búsqueda y se incorpora la información obtenida en la ficha del libro.

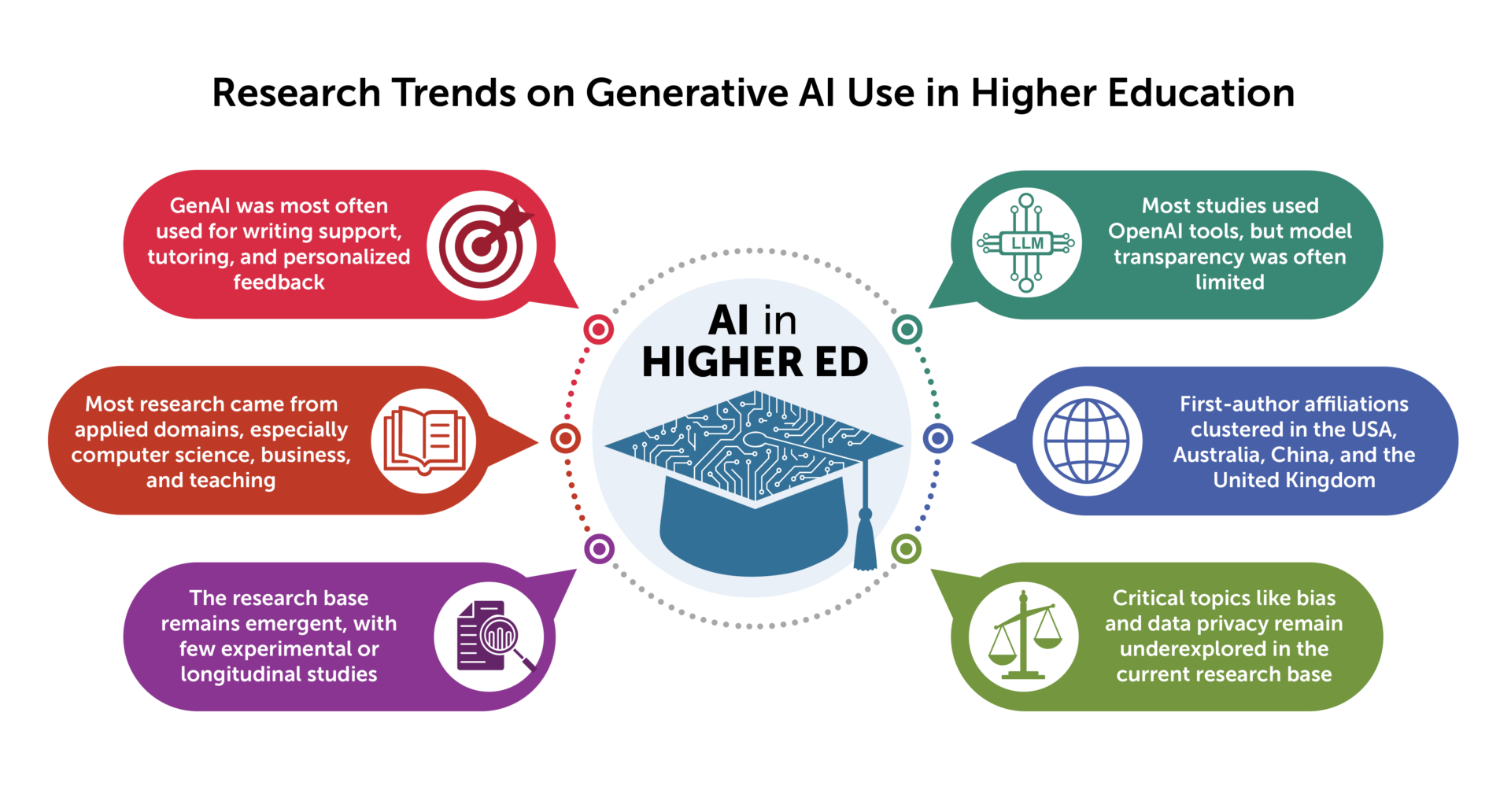

Los Modelos de Lenguaje Extenso (Large Language Models) han abierto nuevas posibilidades en el ámbito bibliotecario, particularmente en la generación automatizada de descripciones y metadatos de libros. Estos sistemas de inteligencia artificial tienen la capacidad de procesar y analizar grandes volúmenes de texto de manera simultánea, extrayendo información relevante como resúmenes del contenido, palabras clave temáticas, clasificación por materias e información bibliográfica estructurada. La aplicación de estos modelos permite no solo acelerar el proceso de catalogación, sino también mantener un nivel de consistencia y precisión que puede ser difícil de lograr mediante procesos completamente manuales.

La implementación de sistemas automatizados en bibliotecas ofrece beneficios significativos en términos de eficiencia y calidad. La automatización de bibliotecas permite reducir los errores tanto en la catalogación como en la clasificación de los materiales, mediante el uso de sistemas informáticos que faciliten y optimicen estos procesos. Esta reducción de errores es particularmente importante considerando el volumen creciente de material bibliográfico que las bibliotecas modernas deben procesar y mantener actualizado.

Utilizando cinco libros seleccionados por el sistema bibliotecario de la Universidad Distrital Francisco José de Caldas, los autores analizaron el rendimiento de estas herramientas en términos de tiempo, costos, calidad y volumen de catálogo. La investigación implementó una metodología comparativa rigurosa para evaluar el desempeño de cuatro herramientas de inteligencia artificial basadas en Large Language Models versus el trabajo de un catalogador humano experto. Las herramientas evaluadas fueron ChatGPT 3.5, ChatGPT 4.0, Gemini de Google y Copilot de Microsoft. La selección de libros para el análisis incluyó tres bestsellers: «1984» de George Orwell, «Cien años de soledad» de Gabriel García Márquez, y «Macroeconomics» de Andrew B. Abel; además de dos obras frontlist publicadas en 2024: «En agosto nos vemos» de Gabriel García Márquez y «Piedra, ficción, memoria: Etnografías del lugar memorativo» de Adrián Serna Dimas.

El análisis se realizó desde tres perspectivas fundamentales: tiempo de catalogación, costos asociados y calidad de la descripción bibliográfica. Para la evaluación de calidad se utilizó el estándar Resource Description and Access (RDA) con nivel de descripción 1, que incluye áreas como título y subtítulo, edición, pie de imprenta, descripción física y número normalizado ISBN. Las pruebas se realizaron utilizando el software ALEPH500 con protocolo MARC21, asegurando la comparabilidad y estandarización de los resultados.

Los resultados obtenidos revelan diferencias dramáticas entre el desempeño humano y el de las herramientas de inteligencia artificial: los modelos automatizados catalogaron 183 veces más rápido que una persona, pudieron catalogar 187 veces más libros y el costo salarial estimado para un catalogador humano resultó ser 64 veces mayor que el uso de IA. En términos de tiempo, el catalogador humano requirió un promedio de 24 minutos y 51 segundos para completar la descripción de cada libro, incluyendo tiempo de descripción (15:23 minutos) y tiempo de transcripción (09:28 minutos). En contraste, los aplicativos de IA completaron la misma tarea en un promedio de apenas 8 segundos, lo que representa que la catalogación asistida por IA es 183 veces más rápida que la realizada por una persona.

En cuanto a la cantidad de campos descritos, el catalogador humano generó un promedio de 55 campos MARC21 por obra, mientras que las herramientas de IA produjeron un promedio de 21 campos. Esta diferencia significativa refleja la capacidad del experto humano para aplicar criterios profesionales, normas de catalogación y estándares de calidad que las IA aún no logran replicar completamente. Sin embargo, los campos generados por las IA mostraron coherencia y utilidad práctica para procesos de catalogación básica.

El análisis económico presenta resultados igualmente impactantes. El costo de catalogación por libro realizada por el catalogador humano se calculó en 14.275 pesos colombianos (aproximadamente 3.36 USD), mientras que el uso de IA representa un costo prácticamente nulo cuando se utilizan versiones gratuitas, o significativamente menor cuando se considera el costo de suscripción. A nivel anual, el salario del catalogador representa 65.761.896 pesos colombianos versus 1.020.516 pesos colombianos para el uso de IA, lo que significa que el costo de catalogación humana es 64 veces más elevado.

Entre las herramientas evaluadas, ChatGPT en sus versiones 3.5 y 4.0 mostró el mejor desempeño, proporcionando resultados más precisos y aplicables al ejercicio de catalogación. ChatGPT 4.0 se identificó como la herramienta más idónea al momento de la investigación. Copilot también demostró capacidades satisfactorias para generar texto plano utilizable en editores de registros MARC21. En contraste, Gemini presentó limitaciones significativas, entregando resultados menos favorables al explicar cada etiqueta MARC21 en lugar de proporcionar código MARC21 completo en texto plano.

La investigación proyecta que un catalogador humano trabajando 2.080 horas anuales (40 horas semanales) podría catalogar aproximadamente 4.992 libros por año. En contraste, las herramientas de IA podrían procesar hasta 936.000 libros en el mismo período, representando una capacidad 187 veces superior. Estos números ilustran el potencial transformador de la tecnología para abordar los desafíos de procesamiento masivo de colecciones bibliográficas que enfrentan las bibliotecas modernas.

Esto demuestra una extraordinaria eficiencia operativa a favor de los sistemas automatizados, abriendo posibilidades para escalar los procesos bibliográficos en contextos con recursos limitados.

En cuanto a la calidad de la descripción, si bien las herramientas LLM presentaron resultados rápidos y voluminosos, los autores reconocieron la necesidad de supervisión para garantizar la precisión y la coherencia de los datos generados. Si bien se observa que los modelos pueden replicar adecuadamente los formatos bibliográficos, aún existe un margen de error en aspectos como las atribuciones, los metadatos específicos y la coherencia editorial, especialmente en la cobertura de las primeras publicaciones o en títulos recientes. Los datos bibliográficos de libros recientes, novedades editoriales o frontlist frecuentemente son inventados por las IA o presentan errores significativos. Esto sugiere que las IA tienen limitaciones en el acceso a información bibliográfica actualizada y pueden generar datos ficticios cuando no tienen acceso a información precisa.

Las herramientas también muestran variabilidad en la capacidad de integrar estándares y normas de catalogación profesional. Mientras pueden acelerar procesos y facilitar la cantidad de registros, generan dudas sobre la calidad y coherencia de los datos bibliográficos producidos, especialmente en comparación con el trabajo realizado por profesionales que comprenden completamente las reglas de catalogación, normas y estándares especializados.

El estudio concluye que estas tecnologías representan una oportunidad significativa para transformar los procesos de catalogación en bibliotecas y sistemas de información. Sin embargo, es importante tener en cuenta que su adopción requiere una implementación responsable, con estrategias que incluyan supervisión humana, validación de metadatos y procedimientos claros para la corrección de errores. Solo así se podrá aprovechar su potencial sin comprometer la integridad de la información bibliográfica.