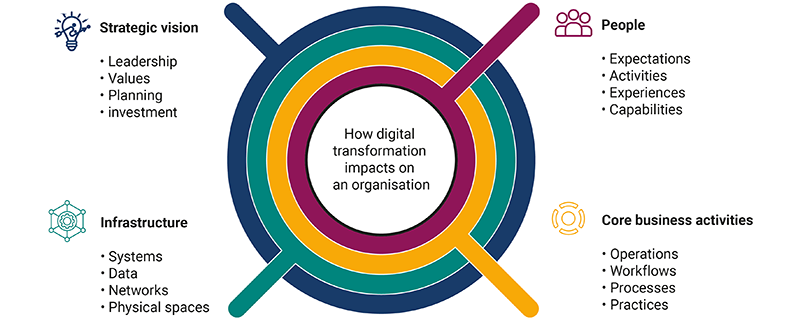

“Taking Digital Transformation Forward in Your Organisation” Jisc. Accedido el 9 de octubre de 2025. https://www.jisc.ac.uk/taking-digital-transformation-forward-in-your-organisation

Jisc ha lanzado una nueva herramienta estratégica llamada “Digital Transformation Library Lens”, diseñada para fortalecer el papel de las bibliotecas académicas en la transformación digital de la educación superior.

Desarrollada en colaboración con líderes bibliotecarios y organizaciones como SCONUL, RLUK y CILIP, esta herramienta ofrece una perspectiva centrada en las bibliotecas dentro del marco general de transformación digital de Jisc para universidades.

El “library lens” muestra cómo los servicios de bibliotecas y archivos contribuyen al cambio institucional en seis áreas clave:

- Cultura digital organizacional,

- Creación e innovación del conocimiento,

- Desarrollo del conocimiento,

- Gestión y uso del conocimiento,

- Intercambio y alianzas,

- Infraestructura digital y física.

Aunque las bibliotecas universitarias han sido pioneras en innovación digital —liderando ámbitos como las colecciones digitales, la comunicación científica y las competencias digitales de los estudiantes—, muchas sienten que su papel no se reconoce plenamente en los procesos institucionales de transformación digital.

La nueva herramienta busca visibilizar y potenciar su impacto mediante un enfoque estructurado y basado en evidencias, con ejemplos prácticos sobre cómo las bibliotecas pueden contribuir a:

- Desarrollar estrategias de IA y bienestar digital,

- Mejorar la infraestructura de investigación y las políticas de acceso abierto,

- Cocrear entornos digitales inclusivos y espacios de aprendizaje,

- Apoyar la toma de decisiones basada en datos y analíticas.

El “library lens” se acompaña de materiales de apoyo como un modelo de madurez digital, plantillas de planes de acción y herramientas para la implicación de actores clave.

Jisc invita a las universidades a incorporar esta herramienta en su planificación estratégica y está colaborando con siete bibliotecas universitarias piloto, cuyos resultados se publicarán en 2026. Además, anima a los líderes universitarios y directores de bibliotecas a unirse al grupo de trabajo y explorar los recursos del Digital Transformation Toolkit.