Liu, Guoying, y Shu Liu. 2026. “Chatbots for Reference Services in Academic Libraries: Applications and Trends.” The Journal of Academic Librarianship 52: 103197. https://doi.org/10.1016/j.acalib.2025.103197

El artículo analiza la adopción y el funcionamiento de los chatbots en los servicios de referencia de bibliotecas universitarias a nivel mundial, en un contexto de transformación digital y creciente incorporación de la inteligencia artificial en el ámbito bibliotecario. A través de un estudio comparativo, las autoras examinan tanto sistemas basados en reglas como chatbots impulsados por IA, con el objetivo de identificar tendencias, capacidades tecnológicas y prácticas éticas en su implementación.

La investigación se apoya en un diseño metodológico en dos fases. En primer lugar, se realiza un escaneo ambiental de 205 instituciones académicas de referencia —incluyendo universidades del ranking QS, instituciones chinas de “Doble Primera Clase”, bibliotecas canadienses de investigación y casos destacados en Estados Unidos—, de las cuales solo 31 contaban con chatbots funcionales y accesibles al público. En una segunda fase, estos chatbots fueron evaluados mediante consultas estandarizadas que permitieron analizar su rendimiento en servicios básicos, recuperación de información, recomendaciones complejas y experiencia de usuario.

Los resultados muestran una adopción global limitada de chatbots en bibliotecas universitarias(15 %), con notables diferencias regionales. Mientras que China continental presenta tasas de implantación significativamente más altas, la adopción en América del Norte sigue siendo baja, pese a la abundante literatura sobre casos piloto. La mayoría de los sistemas analizados son chatbots híbridos o basados en IA generativa, capaces de manejar consultas rutinarias con eficacia, aunque presentan dificultades en tareas más complejas como la recuperación semántica avanzada o la generación de recomendaciones contextualizadas.

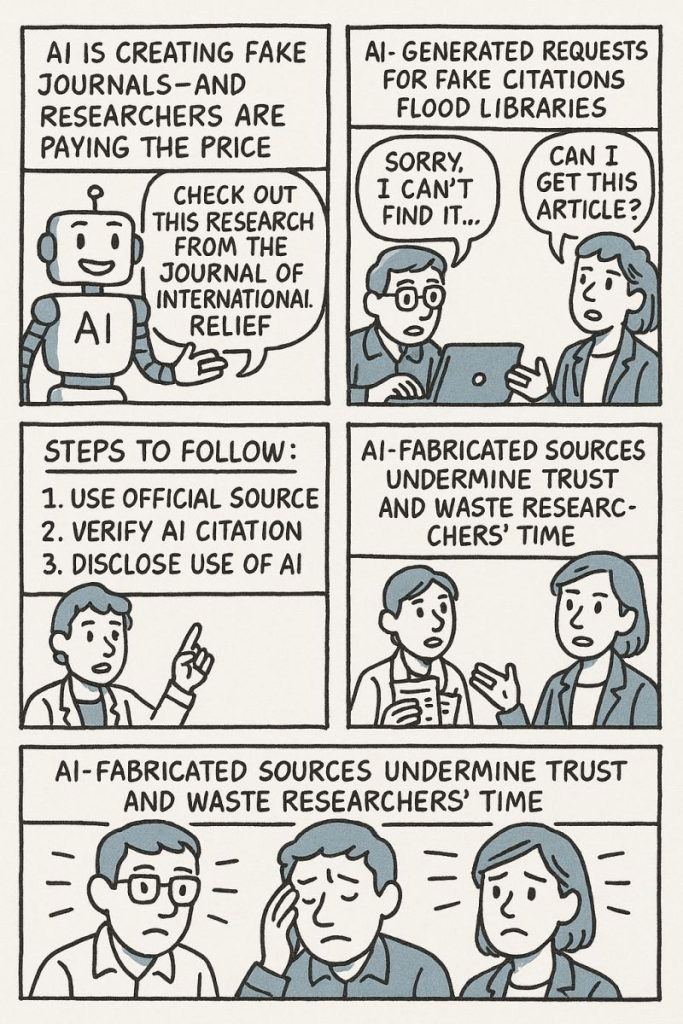

El estudio también pone de relieve importantes carencias en materia de transparencia y ética. Solo una minoría de los chatbots informa explícitamente sobre políticas de privacidad o el uso de datos, lo que plantea riesgos para la confianza del usuario y la responsabilidad institucional. Las autoras concluyen que, aunque los chatbots ofrecen un notable potencial para ampliar y mejorar los servicios de referencia, su desarrollo futuro debe apoyarse en estándares compartidos, una mejor integración con los sistemas bibliotecarios y un compromiso más firme con los principios de transparencia, inclusión y gobernanza ética.