Statement on Principles for the Development and Use of Systems to Detect Generative AI Content. ACM, oct. 2023

Con el interés público centrado en tecnologías de IA generativa en constante aumento, algunos de los problemas más apremiantes giran en torno a preguntas como «¿Se está utilizando la IA generativa para crear imágenes y videos falsos?» y «¿Los estudiantes están utilizando la IA generativa para escribir trabajos y hacer trampa en los exámenes?» Por estas razones, hay una creciente demanda de sistemas que puedan detectar si una imagen, archivo de audio o trabajo escrito ha sido creado por un humano o un sistema de IA.

A pesar de que los sistemas de detección de IA están comenzando a proliferar, no existen estándares de la industria ni regulaciones gubernamentales que garanticen que estos sistemas sean precisos o justos. Debido a que el impacto de estos sistemas en las personas puede ser significativo, el Association for Computing Machinery’s US Technology Policy Committee (ACM USTPC) ha emitido una Declaración de Principios para el Desarrollo y Uso de Sistemas de Detección de Contenido de IA Generativa.

La introducción a la nueva Declaración de USTPC destaca diversos escenarios en los que sería deseable contar con sistemas para detectar contenido generado por IA. Por ejemplo, los empleadores que desean saber si se utilizó IA generativa para completar una solicitud de trabajo o las empresas de medios que intentan determinar si los comentarios publicados en plataformas fueron dejados por humanos o chatbots.

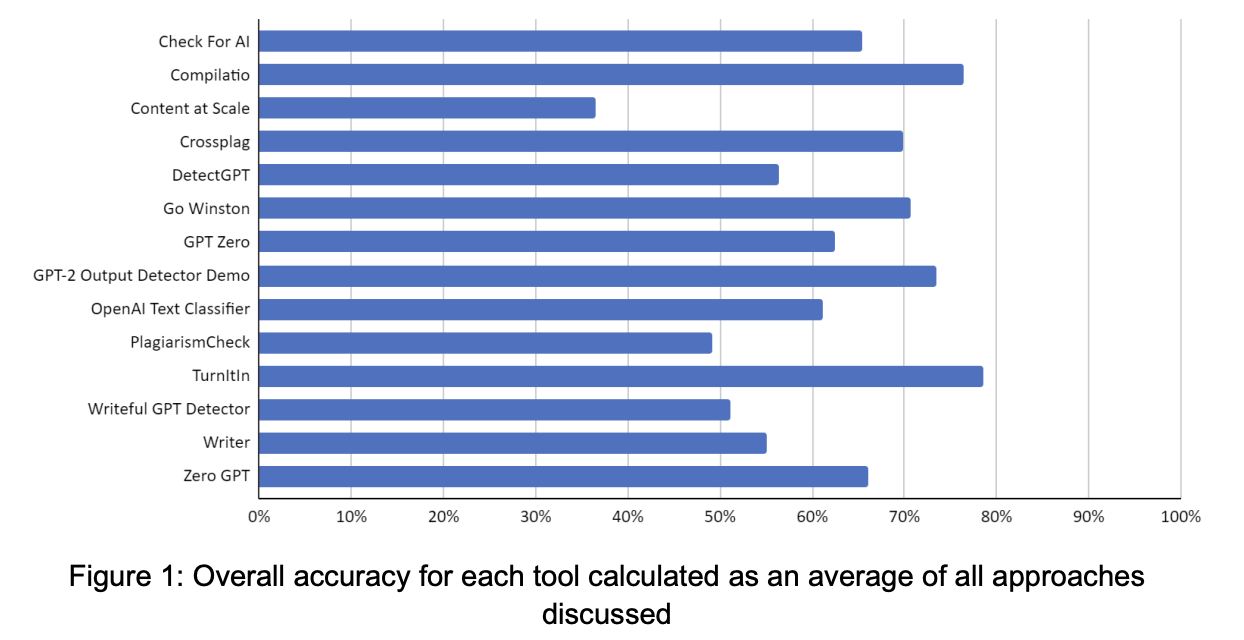

Al mismo tiempo, la Declaración señala que «la demanda de tales sistemas no es un indicador de su equidad o precisión». El comité continúa explicando que «ninguna tecnología de detección actualmente disponible es lo suficientemente confiable como para basar exclusivamente decisiones críticas, potencialmente alteradoras de la vida y la carrera…»

La declaración proporciona un contexto técnico sobre por qué no se puede garantizar la equidad y precisión de los sistemas de detección de IA generativa existentes y establece seis principios y recomendaciones específicos:

- Bajo riesgo de rechazos incorrectos y proceso de apelación impulsado por humanos: El uso de sistemas para detectar imágenes generadas por IA y otros medios que automáticamente marcan las presentaciones para su rechazo solo debe ser aceptable si estos sistemas de detección tienen un riesgo extremadamente bajo de rechazos incorrectos y si se proporciona un proceso de apelación impulsado por humanos.

- Presentaciones de alto riesgo: Generalmente no es apropiado rechazar automáticamente presentaciones de texto en circunstancias de alto riesgo que se clasifican como producidas por un sistema de IA generativa, incluso si se proporciona un proceso para apelar dichos rechazos. Ejemplos de presentaciones de alto riesgo incluyen (pero no se limitan a) tareas en el aula y solicitudes de admisión a una institución educativa, crédito o empleo.

- Códigos de conducta: Las entidades que utilizan sistemas de detección de IA generativa deben adoptar directrices, como códigos de conducta, manuales del empleado y códigos de honor ejecutables, que requieran que aquellos afiliados a la entidad cumplan con las políticas de IA de la organización.

- Impugnación de resultados: De acuerdo con declaraciones anteriores de USTPC, las personas deben tener la oportunidad de impugnar resultados siempre que se tome una decisión adversa sobre ellas, en su totalidad o en parte, basada en la salida de un sistema de IA.

- Formación adecuada: Los evaluadores de contenido humano deben recibir una formación adecuada de manera continua sobre los métodos y herramientas adecuados para validar el contenido presentado.

- Aumento de la financiación: Sería prudente y beneficioso aumentar la financiación del sector público y privado para la investigación sobre cómo desarrollar mecanismos de detección mejores, realizar análisis de impacto, realizar investigaciones de usuario y otros asuntos relacionados.

En palabras de Simson Garfinkel, autor principal de la declaración y presidente del Subcomité de Gobierno Digital de USTPC: «En principio, detectar texto e imágenes generados por la IA es un problema abierto. Aunque podría ser posible construir un sistema que pueda detectar el contenido generado por la IA de hoy, tal detector podría utilizarse para construir el sistema de generación de IA del mañana que evite dicha detección. Esta declaración se emite para agregar una voz de experiencia técnica al pánico moral sobre el uso de la IA generativa. Estamos diciendo que el texto e imágenes producidos por sistemas de IA generativa no pueden detectarse de manera confiable hoy. También alentamos a todas las instituciones a abstenerse de desplegar sistemas que pretendan detectar y descartar automáticamente materiales porque supuestamente fueron creados por un sistema de IA generativa».

Larry Medsker, presidente del Comité de Política Tecnológica de ACM de los Estados Unidos, agregó: «Esta nueva Declaración es parte de una serie continua que el Comité de Tecnología de ACM de los Estados Unidos publica para informar al público sobre las nuevas tecnologías y sus impactos en la sociedad. Recientemente, hemos estado especialmente activos en brindar aportes oportunos para abordar los nuevos desarrollos en IA». En esta línea, los miembros de USTPC han publicado “Principles for the Development, Deployment and Use of Generative AI” y “Statement on Principles for Responsible Algorithmic Systems.”

Además del autor principal Simson Garfinkel, los principales contribuyentes a la “Statement on Principles for the Development and Use of Systems to Detect Generative AI Content” incluyen a los miembros del comité Houssam Abbas, Andrew Appel, Harish Arunachalam, Ricardo Baeza-Yates, David Bauman, Ravi Jain, Carl Landwehr, Larry Medsker, Neeti Pokhriyal, Arnon Rosenthal y Marc Rotenberg.