Heath, Ryan. «Exclusive: AI Legislation Spikes across U.S. States to Combat Deepfakes». Axios, 14 de febrero de 2024. https://www.axios.com/2024/02/14/ai-bills-state-legislatures-deepfakes-bias-discrimination.

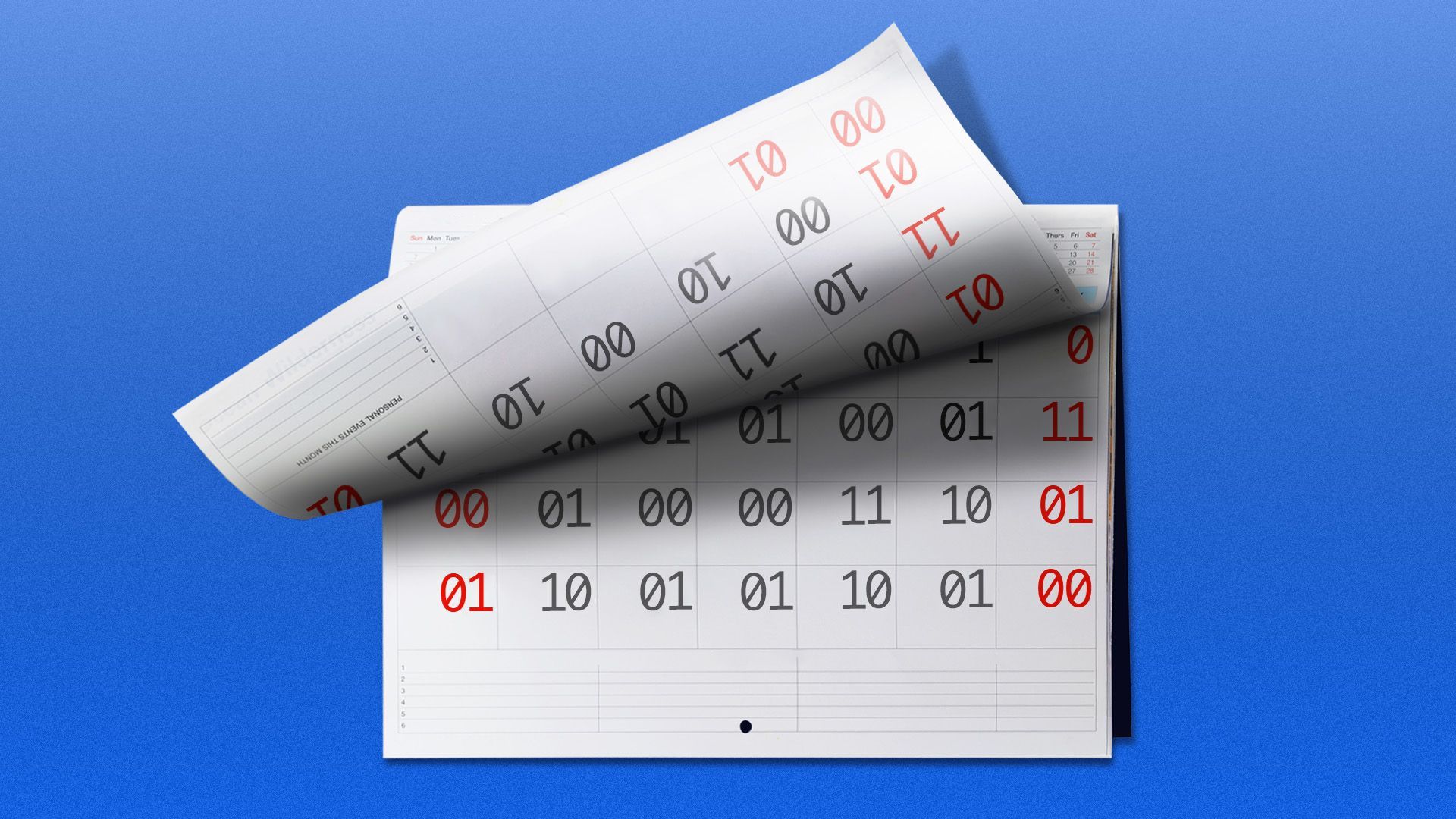

Casi todas las legislaturas estatales actualmente en sesión están considerando proyectos de ley relacionados con la inteligencia artificial (IA), y casi la mitad de esos proyectos abordan los deepfakes, según un análisis del grupo de la industria del software BSA, compartido exclusivamente con Axios.

Por qué es importante:

La rápida innovación en IA y el vacío regulatorio federal han dado a las legislaturas estatales el ímpetu para generar un aumento seis veces mayor en la legislación sobre IA en comparación con hace un año.

Lo que está sucediendo:

Hasta el 7 de febrero había un total de 407 proyectos de ley relacionados con la IA en más de 40 estados, frente a los 67 proyectos de ley del año pasado. Los estados introdujeron 211 proyectos de ley sobre IA el mes pasado.

Puesta al día rápida:

Los objetivos de los proyectos de ley van desde el sesgo y la discriminación hasta la tecnología de reconocimiento facial y los deepfakes.

Los legisladores en 33 estados han presentado proyectos de ley sobre IA relacionados con las elecciones.

- Enero vio un gran aumento en nuevos proyectos de ley. Ahora se están produciendo a un ritmo de 50 por semana, la mitad de ellos relacionados con los deepfakes.

- Un proyecto de ley de California introducido el 8 de febrero requeriría la licencia de modelos de IA potentes, a través de una nueva agencia estatal, y crearía un clúster de cómputo público de IA.

- La gobernadora republicana de Dakota del Sur, Kristi Noem, ha firmado una ley actualizada contra las imágenes de abuso sexual infantil el 12 de febrero, que obliga a prisión a aquellos que sean atrapados creando, distribuyendo y poseyendo imágenes generadas por IA.

Por los números: Los estados con más proyectos de ley en consideración son Nueva York (65), California (29), Tennessee (28), Illinois (27) y Nueva Jersey (25).

- Alabama y Wyoming son los únicos estados actualmente en sesión sin legislación sobre IA en consideración.

- Maryland, Massachusetts, Virginia y Washington anunciaron acciones ejecutivas sobre IA en enero.

- Connecticut ahora requiere evaluaciones continuas para asegurar que la IA no cause discriminación o impacto dispar.

La intriga: Los estados con las mayores industrias de IA, California y Nueva York, también son los que generan la mayor cantidad de proyectos de ley en borrador.

La explosión legislativa de IA de Tennessee está impulsada por las preocupaciones de derechos de autor de la industria musical local, liderada por la Ley ELVIS (Garantizando la Seguridad de la Voz y la Imagen) promulgada en enero.

Entre líneas: Los legisladores estatales de hoy parecen determinados a no repetir la inacción en la regulación de las redes sociales.

Algunos de los legisladores de IA más prominentes estuvieron activos en la legislación estatal de privacidad, considerando los guardrails de IA como un próximo paso lógico en los derechos digitales.

Antecedentes: Los legisladores estatales comenzaron a construir su impulso de IA durante el verano de 2023, presentando 191 proyectos de ley en 31 estados para septiembre, pero solo 14 se convirtieron en ley.

Lo que están diciendo: «Las penalizaciones por deepfakes son el tema candente», dijo Craig Albright, vicepresidente senior de relaciones gubernamentales de BSA, a Axios.

«Muchos de los lenguajes sobre deepfakes son similares en los estados. Estamos viendo mucha coordinación», dijo Matt Lenz, director senior de defensa estatal de BSA.

Algunos grupos de defensa se preocupan de que una estricta regulación de la IA termine protegiendo a los primeros líderes en IA, porque tendrán más recursos para manejar la carga.

«Envolver los nuevos modelos de IA en trámites burocráticos efectivamente consolida a los mayores actores tecnológicos como ganadores de la carrera de IA», dijo Todd O’Boyle, director de política tecnológica de Chamber of Progress, por correo electrónico.

Sí, pero: Hasta ahora, los gobernadores no han hecho de la IA una prioridad en sus discursos sobre el estado del estado en 2024.

Próximo paso: Los gobernadores estatales tienen la oportunidad de fortalecer la coordinación sobre la legislación y la acción ejecutiva de IA mientras se reúnen en Washington D.C. esta semana.