Danny Kingsley. «Generative AI – the Latest Scapegoat for Research Assessment», LSE, 13 de octubre de 2023. https://blogs.lse.ac.uk/impactofsocialsciences/2023/10/13/generative-ai-the-latest-scapegoat-for-research-assessment/.

Reflexionando sobre el debate en torno a la inteligencia artificial generativa y su impacto en la comunicación académica, Danny Kingsley argumenta que, al igual que el acceso abierto hace veinte años, la IA refleja las deficiencias duraderas en la publicación y evaluación de la investigación.

Ha sido interesante observar la explosión de discusión en torno a ChatGPT y la IA generativa. Los comentarios oscilan entre el gran potencial que ofrece (en términos de eficiencia) y las preocupaciones sobre el daño que causará a sistemas de confianza de larga data. Uno de esos sistemas es la publicación académica.

A pesar de los desafíos planteados, ChatGPT simplemente refleja los problemas que ya aquejan al sistema de publicación académica actual. De hecho, de la misma manera en que hace una década, el acceso abierto fue un chivo expiatorio de la comunicación académica, ahora la IA generativa es un chivo expiatorio del sistema de publicación académica. Estas preocupaciones parten de una suposición subyacente: que el sistema actual está funcionando. Debemos preguntarnos: ¿es así?

No hay espacio aquí para una lista exhaustiva de los muchos y variados problemas del ecosistema actual de publicación académica. A modo de muestra, hay que tener en cuenta que por ejemplo las revistas depredadoras lamentablemente están aquí para quedarse, la preocupante cantidad de fraude en la investigación médica y que los investigadores que aceptan manipular citas tienen más probabilidades de que se publiquen sus artículos.

Dos estudios recientes, uno en Europa y otro en Australia, revelan el nivel de presión al que se ven sometidos los doctorandos y los investigadores en sus primeros años para proporcionar autoría regalada. También se han revelado alarmantes detalles sobre el intercambio de dinero por autoría, con precios que dependen de dónde se publicará el trabajo y el área de investigación. Las investigaciones sobre esto están llevando a una serie de retractaciones. Incluso la «naturaleza autocorrectiva» del sistema no funciona, con la revelación de un gran número de citas a artículos que habían sido retractados, y más de una cuarta parte de estas citas ocurrieron después de la retractación.

Consideremos algunas de las preocupaciones planteadas sobre la IA y la publicación académica. La incapacidad actual de la IA para documentar el origen de sus fuentes de datos a través de citas, y la falta de identificadores de esas fuentes de datos, significa que no hay capacidad para replicar los «hallazgos» generados por la IA. Esto ha llevado a llamados para el desarrollo de una especificación o estándar formal para la documentación de la IA respaldado por un modelo de datos sólido. Nuestro entorno actual de publicación no prioriza la reproducibilidad, con el intercambio de código como algo opcional y una adopción lenta de requisitos para compartir datos. En este entorno, la generación de datos falsos es motivo de preocupación. Sin embargo, ChatGPT «no es el creador de estos problemas; en cambio, permite que este problema exista en una escala mucho mayor».

A pesar de toda la preocupación, la IA generativa ofrece una forma de abordar las desigualdades en el sistema académico de publicación actual. Por ejemplo, escribir artículos en inglés cuando no es el primer idioma del autor puede ser una barrera significativa para participar en el discurso de investigación. La IA generativa ofrece una solución potencial para estos autores, argumentada en el contexto de la publicación médica. Otro argumento es que las reacciones impulsivas de los editores al uso de ChatGPT en artículos significa que estamos perdiendo la oportunidad de nivelar el campo de juego para los autores que tienen el inglés como segundo idioma (ESL).

Después de todo, la práctica de recibir asistencia en la redacción de artículos no es algo nuevo. Un estudio que investiga a autores prolíficos en revistas científicas de alto impacto que no eran investigadores encontró un sorprendente nivel de publicación en múltiples áreas de investigación. Estos autores son humanos (en su mayoría con títulos en periodismo), no IA.

Hablando de autoría, recientemente se informó que un radiólogo utilizó ChatGPT para escribir artículos y los publicó con éxito en áreas que estaban muy alejadas de su experiencia, incluyendo agricultura, seguros, derecho y microbiología. Esto es una representación excelente de las preocupaciones que muchos han expresado sobre la producción excesiva de artículos «escritos» por la IA generativa. Aunque las acciones del radiólogo son impactantes, este tipo de comportamiento no se limita al uso de la IA, como lo demuestra la admisión de un experto en carne español que había publicado 176 artículos en un año en múltiples áreas a través de asociaciones cuestionables.

El único impulsor de casi todas las prácticas de investigación cuestionables es la actual importancia del artículo publicado como la única producción que cuenta. El rabo está moviendo al perro.

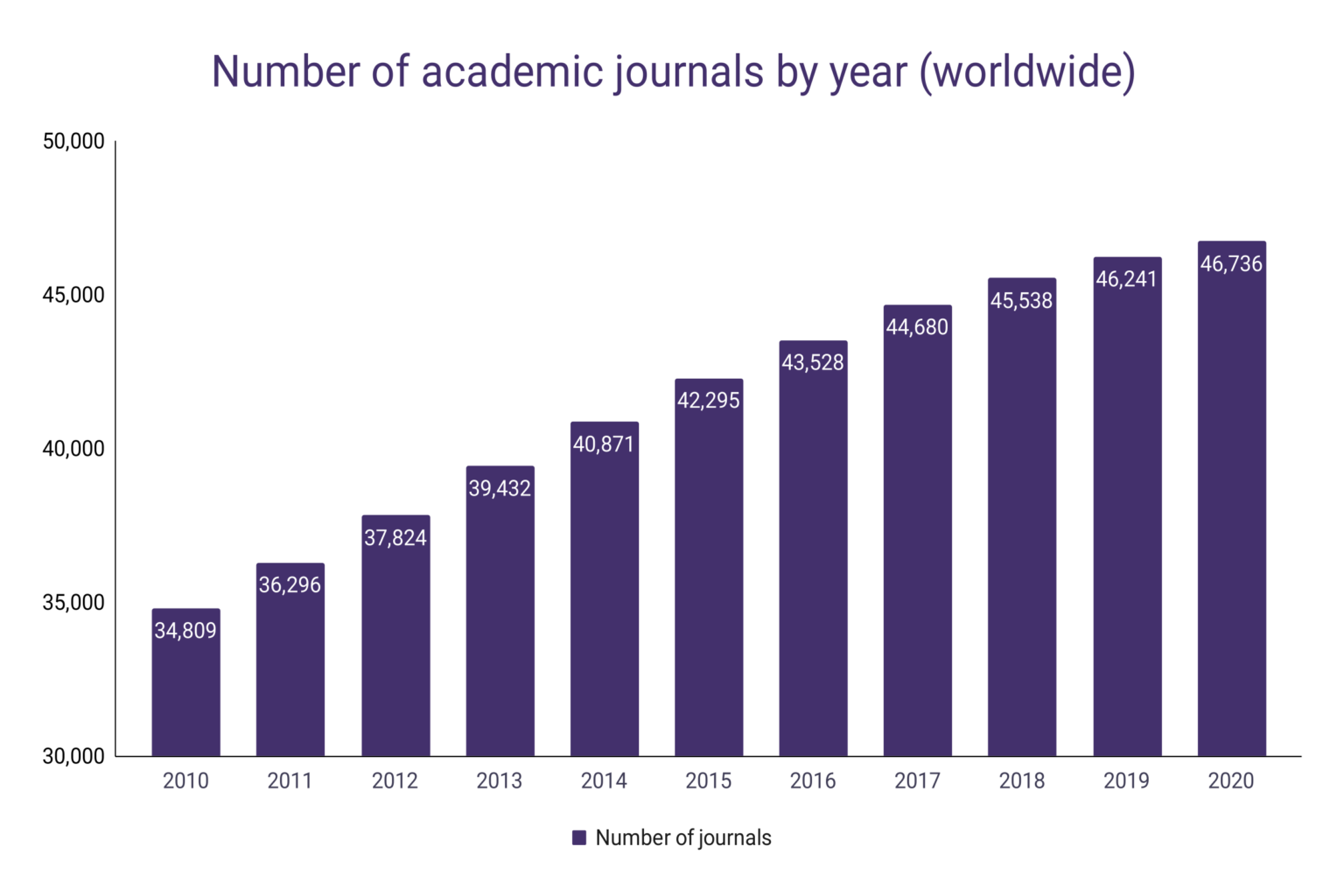

Si un exceso de revistas y artículos de revista ya está alimentando las «fábricas de artículos» (que a su vez pueden generarse mediante IA), es posible que todo el ecosistema de publicación académica esté a punto de colapsar. Un comentario ha preguntado si el uso de la IA para ayudar a escribir artículos aumentará aún más la presión para publicar, dado que los niveles de publicación han aumentado drásticamente en la última década.

Estamos haciendo las preguntas equivocadas. Un buen ejemplo es este artículo que pregunta si los editores deberían preocuparse de que ChatGPT haya escrito un artículo sobre sí mismo. El artículo continúa discutiendo «otras preocupaciones éticas y morales» y pregunta: «¿Es correcto usar la IA para escribir artículos cuando la publicación de artículos se utiliza como un barómetro de la competencia, la permanencia y la promoción de los investigadores?».

Reformularía la pregunta como: «¿Es correcto que la publicación de artículos se utilice como la principal herramienta de evaluación de los investigadores?» El único impulsor de casi todas las prácticas de investigación cuestionables es la importancia actual del artículo publicado como la única producción que cuenta. El rabo está moviendo al perro.