The Role of Libraries as Public Spaces in Countering Misinformation, Disinformation, and Social Isolation in the Age of Generative AI. Urban Libraries Council, 2024

Urban Libraries Council (Consejo de Bibliotecas Urbanas, ULC) ha publicado un nuevo Informe de Liderazgo que aborda el aumento de la inteligencia artificial generativa (IA) y su contribución a la propagación de desinformación y misinformación. Ante el creciente aislamiento social, el informe explora cómo las bibliotecas públicas están en una posición única para enfrentar estos desafíos mediante la promoción de la alfabetización digital y el fomento de conexiones comunitarias.

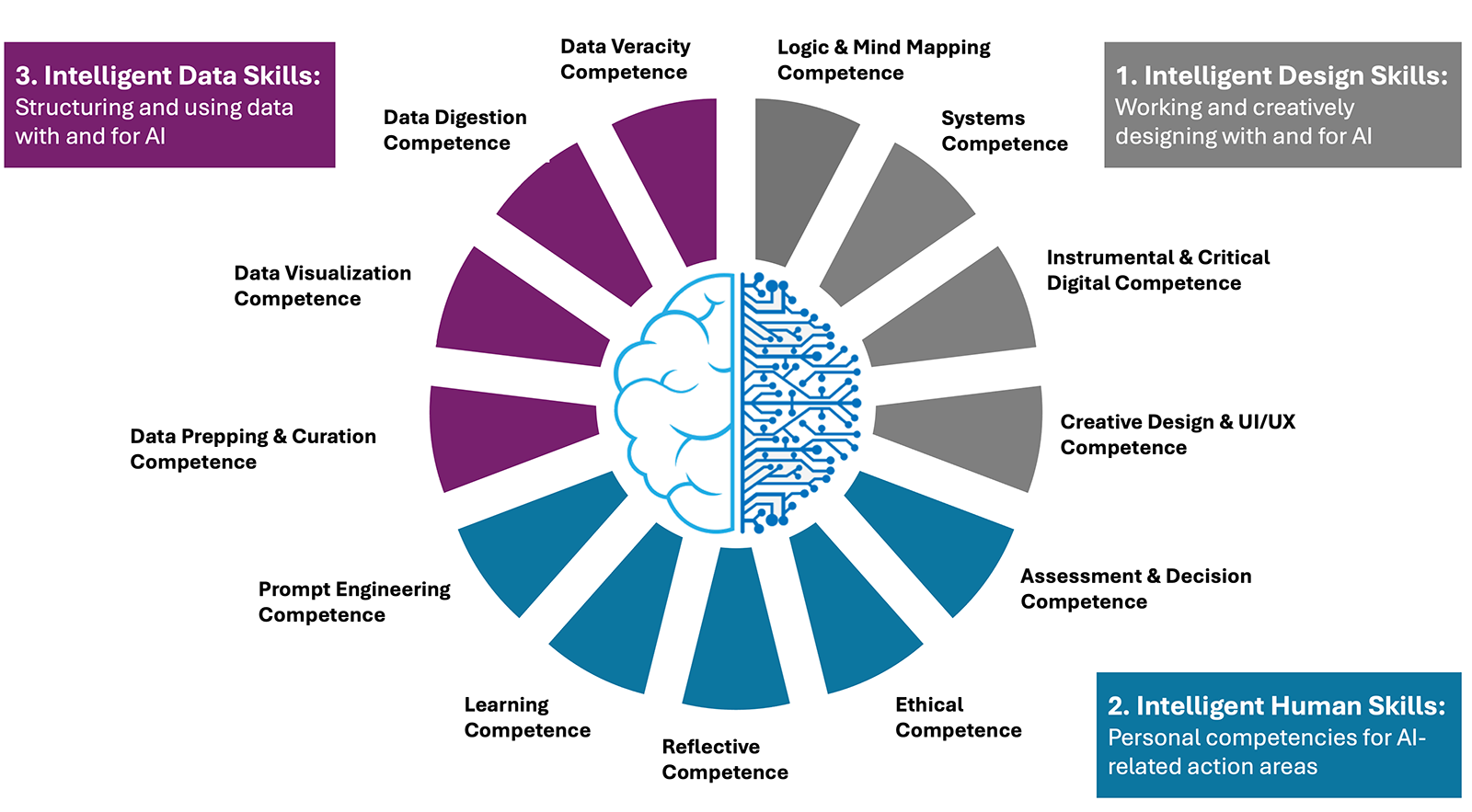

El informe proporciona recomendaciones que las bibliotecas pueden implementar, como la actualización de los currículos de alfabetización digital, la creación de recursos para identificar desinformación y el desarrollo de programas que promuevan el compromiso cívico y la cohesión social. Subraya el papel vital de las bibliotecas en empoderar a las personas y fortalecer las comunidades frente a los desafíos tecnológicos y sociales.

Según Brooks Rainwater, presidente y CEO de ULC, los desafíos como la expansión de la IA, la información falsa y la soledad son temas recurrentes en las bibliotecas de América del Norte. El informe ofrece varias recomendaciones para que las bibliotecas refuercen su trabajo y comunidades.

Ejemplos de implementación de las recomendaciones en bibliotecas de EE.UU. y Canadá:

- Biblioteca Pública de Boston: Organizó un taller sobre cómo combatir la desinformación, desarrollar habilidades de ciudadanía digital y utilizar herramientas para identificar información veraz.

- Biblioteca Pública de Brooklyn: Colaboró con Women in AI Ethics™ en un evento con la congresista Yvette D. Clarke sobre los peligros de la IA generativa en los medios y la protección de las mujeres contra el abuso de imágenes.

- Biblioteca Pública de Dallas: Alojó la exhibición del Smithsonian “The Bias Inside Us” y organizó programas para todas las edades para sensibilizar sobre cómo los prejuicios afectan el pensamiento.

- Biblioteca Pública de Toronto: Desarrolló un kit de herramientas sobre “Noticias Falsas y Alfabetización Informativa” para ayudar a los usuarios a distinguir entre información veraz y desinformación.

Este informe reafirma la importancia de las bibliotecas en la construcción de comunidades resilientes en un mundo cada vez más influido por la IA.