Frontier Learning Lab. “Drowning in Slop: Media Literacy in the Age of AI.” Substack, 2026. https://frontierlearninglab.substack.com/p/drowning-in-slop-media-literacy-in

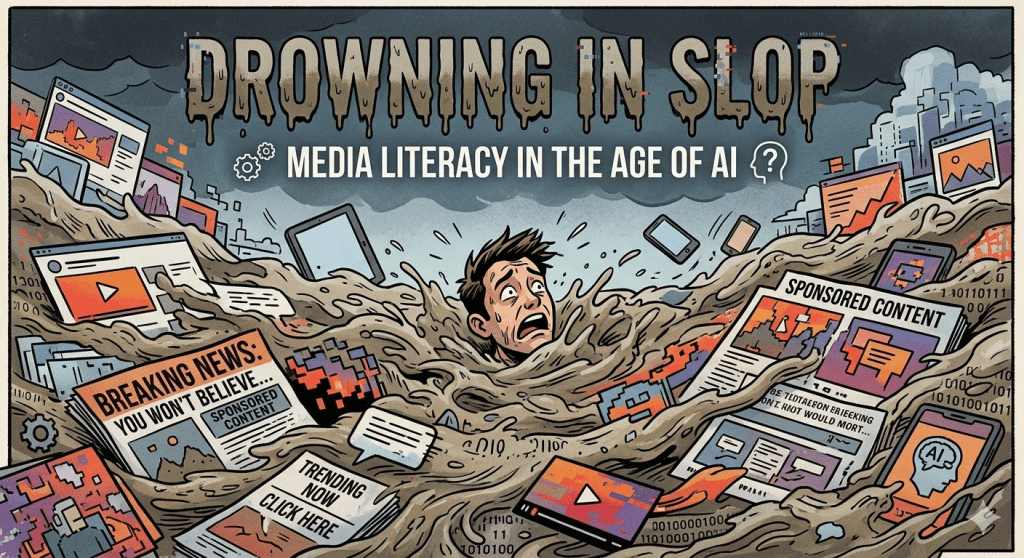

Se plantea que nos encontramos en una nueva fase del ecosistema informativo caracterizada por la sobreproducción masiva de contenidos generados por inteligencia artificial, fenómeno que se ha popularizado bajo el término “AI slop”. Este concepto hace referencia a materiales digitales producidos en grandes cantidades, pero con escasa calidad, profundidad o fiabilidad, diseñados principalmente para captar atención y generar ingresos en la economía de los clics.

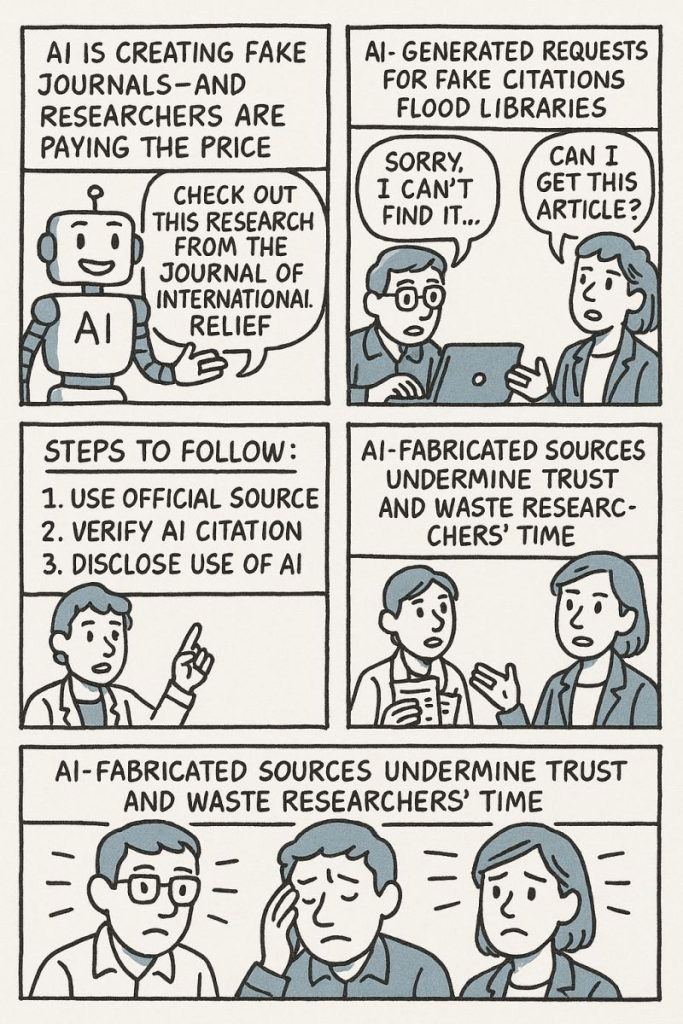

Slop IA (o «AI Slop») se refiere al contenido digital de baja calidad, repetitivo y masivo generado automáticamente por inteligencia artificial. Es considerado el equivalente al «spam» o «basura» en la era de la IA, priorizando cantidad sobre calidad para ganar clics o interacción en redes sociales

La tesis central del texto es que este exceso de contenido no solo supone un problema de desinformación, sino también de saturación cognitiva. A diferencia de etapas anteriores —en las que el reto era distinguir entre información verdadera y falsa—, ahora el desafío consiste en navegar un entorno donde el volumen de contenido irrelevante, superficial o redundante dificulta incluso encontrar información significativa. En este contexto, el problema no es solo la mentira, sino el ruido: una “contaminación informativa” que diluye el conocimiento valioso.

El artículo subraya que esta situación está impulsada por incentivos estructurales del ecosistema digital. Las plataformas premian el volumen, la velocidad y el «engagement» (compromiso), lo que favorece la proliferación de contenido automatizado. La inteligencia artificial permite producir textos, imágenes o vídeos a gran escala y bajo coste, generando una especie de industrialización del contenido que prioriza la cantidad sobre la calidad. Como resultado, el espacio digital se llena de materiales repetitivos, poco fiables o directamente inútiles.

Uno de los aspectos más relevantes es el impacto de este fenómeno en la confianza. Cuando los usuarios se enfrentan a grandes cantidades de contenido indistinguible en términos de calidad —y cada vez más difícil de verificar—, se produce una erosión progresiva de la credibilidad del entorno informativo. No se trata solo de creer información falsa, sino de dejar de confiar en cualquier información. Este proceso puede derivar en un escepticismo generalizado que debilita tanto el conocimiento compartido como el debate público.

El texto también introduce la idea de una nueva brecha digital: no tanto de acceso a la información, sino de calidad de la información consumida. Mientras algunos usuarios acceden a contenidos fiables (a menudo de pago o producidos por instituciones consolidadas), otros quedan atrapados en ecosistemas dominados por contenido automatizado, clickbait (viberanzuelo) o desinformación. Esta desigualdad informativa tiene implicaciones profundas para la educación, la participación democrática y la cohesión social.

En este escenario, la alfabetización mediática adquiere un papel central, pero debe transformarse. El artículo sostiene que las estrategias tradicionales —centradas en analizar críticamente cada unidad de información— resultan insuficientes ante el volumen actual. En su lugar, propone enfoques más adaptados al entorno digital, como el filtrado activo de fuentes, la lectura lateral (comparar múltiples fuentes antes de profundizar) y el desarrollo de hábitos de consumo informativo más selectivos.

Además, se enfatiza la necesidad de una alfabetización que no sea solo técnica, sino también cultural y ética. Los usuarios deben comprender cómo funcionan los algoritmos, cuáles son los intereses económicos detrás de la producción de contenido y cómo sus propios sesgos cognitivos influyen en lo que consumen y comparten. La alfabetización mediática se redefine así como una competencia integral que combina pensamiento crítico, conocimiento tecnológico y responsabilidad social.

Para concluir, el artículo advierte que la solución no puede recaer únicamente en los individuos. Aunque la educación en alfabetización mediática es fundamental, también se requieren cambios estructurales en las plataformas tecnológicas, como la mejora de los sistemas de recomendación, la transparencia en el uso de IA y posibles regulaciones que limiten la proliferación de contenido de baja calidad. Sin embargo, incluso con estas medidas, el texto sugiere que el reto persistirá: en un mundo donde generar contenido es prácticamente gratuito, la escasez ya no es de información, sino de atención, criterio y significado.