LorcanDempsey.net. «Generative AI and Libraries: 7 Contexts», 12 de noviembre de 2023. Ver completo https://www.lorcandempsey.net/generative-ai-and-libraries-7-contexts/.

Las bibliotecas utilizan la IA en su labor educativa, política y de servicios. En este artículo se analizan siete contextos en los que se lleva a cabo esta labor.

A medida que la IA se generaliza, los bibliotecarios tienen que tomar cada vez más decisiones cotidianas sobre adopción, asesoramiento y políticas. Sus comunidades de interesados se encontrarán en diversos estados de entusiasmo o resistencia, interés o apatía, conocimiento o aprendizaje. Cuando los responsables de las bibliotecas intenten posicionarlas como fuente de asesoramiento y experiencia, cuando tomen decisiones sobre adquisiciones, cuando planifiquen el futuro y cuando se comuniquen y trabajen con sus colegas, habrá que entender y sopesar lo constructivo y lo problemático.

Se está invirtiendo mucho y se está extendiendo por los campos de la ciencia y la ingeniería, la sanidad, el derecho y las aplicaciones empresariales en general. Al mismo tiempo, las herramientas y técnicas de IA se están generalizando en los ciclos de investigación y aprendizaje, acompañadas de mucho debate y cautela. Aunque gran parte de este desarrollo se considera productivo, también hay intensos debates y una apreciación más clara de la problemática

El trabajo bibliotecario y los trabajadores

Debate y el despliegue de la IA, la conversación en las bibliotecas se está orientando hacia un compromiso cualificado y una cautela informada. Sin embargo, esto no significa dejar de lado las consecuencias humanas muy reales en términos de incertidumbre sobre el futuro, posibles cambios en los requisitos del trabajo, la necesidad de aprender nuevas habilidades o de hacer frente a las nuevas demandas.

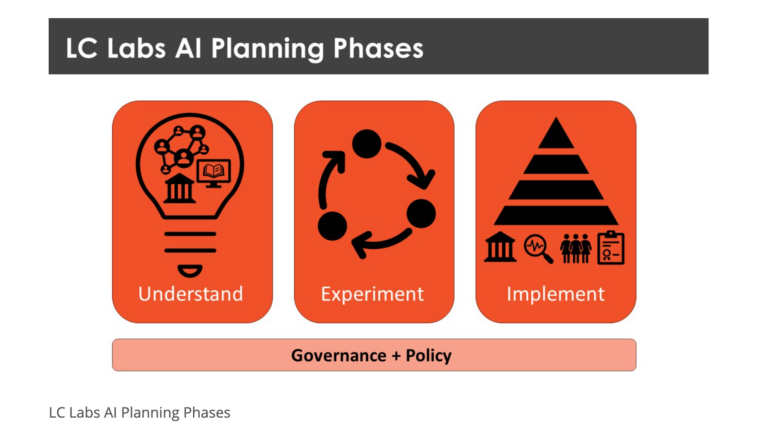

A todos nos interesa estar informados. Sin embargo, es casi imposible estar al tanto de todo lo que ocurre, y mucho menos comprender las implicaciones. Muchas bibliotecas han creado grupos de trabajo u otros mecanismos para seguir la evolución, hacer recomendaciones sobre la adopción, etcétera.

Asesoramiento y experiencia: las nuevas competencias de investigación

Dado que la biblioteca se posiciona como fuente de asesoramiento y conocimientos especializados sobre el uso de herramientas de IA en tareas relacionadas con la información y los datos, es importante desarrollar la comprensión de cómo funcionan los LLM y las herramientas asociadas, de qué herramientas se dispone, para qué sirven y cuáles son sus límites.

Cliente/consumidor informado

La biblioteca interactuará con muchos proveedores que pretenden tener funciones de IA, éstas variarán enormemente en función del proveedor, el grado de desarrollo y la aplicación. Las bibliotecas tendrán que informarse sobre las afirmaciones relativas a la IA, la funcionalidad y la singularidad, al igual que en otros ámbitos de la contratación. ¿El componente de IA es una capa fina sobre una API ChatGPT o hay algo más? ¿Cómo se utiliza la generación aumentada de recuperación (una técnica para conectar el LLM a recursos de datos externos, que probablemente se utilice mucho en contextos bibliotecarios, culturales y académicos)? Y así sucesivamente. Es posible que algunas bibliotecas también deseen adoptar una postura por motivos éticos, por ejemplo, en lo que se refiere a qué LLM se utilizan, lo que a su vez puede informar las decisiones de concesión de licencias o la defensa ante los proveedores. Las listas de control, como la mencionada anteriormente, serán de gran utilidad.

Defensa y política

Las posturas y decisiones políticas son importantes en todos los niveles, ya sea en términos de política nacional o de toma de decisiones institucionales a nivel universitario o municipal. Las bibliotecas pueden desempeñar un papel importante en la elaboración de políticas institucionales sobre la IA, aportando al debate aspectos éticos, de uso y de política de la información. Este reciente artículo analiza las posibles funciones y contribuciones de las bibliotecas a la formulación de políticas institucionales.

Principios

Varias organizaciones están elaborando principios o directrices de IA para ayudar a dirigir su enfoque responsable de la IA. Por ejemplo, estos son los principios adoptados por Elsevier. De hecho, Gartner aconseja a todas las organizaciones que desarrollen lo que denomina principios «faro» en este ámbito. Al revisar las políticas nacionales sobre IA, el decano de bibliotecas Leo Lo hace algunas recomendaciones para que las bibliotecas individuales respondan. Entre ellas, la creación de un comité de ética de la IA y el desarrollo de buenas prácticas para su uso. Tiene sentido que las bibliotecas analicen algunas de estas cuestiones y establezcan algunos marcos éticos y políticos explícitos, así como un mecanismo para revisarlos. Por supuesto, también es importante que las asociaciones se ocupen de este tema y proporcionen plantillas u orientaciones a las bibliotecas que realicen este trabajo. Sobre todo, teniendo en cuenta la variedad de capacidades disponibles en cada biblioteca. Me interesó ver este trabajo de la Asociación Mundial de Editores de Noticias como ejemplo. Abarca «la propiedad intelectual, la transparencia, la responsabilidad, la calidad y la integridad, la equidad, la seguridad, el diseño y el desarrollo sostenible».

Derechos de autor y creadores.

Ya se ha mencionado el asesoramiento a los creadores. En términos más generales, la biblioteca, y las asociaciones que agrupan la voz y la influencia de las bibliotecas, tienen un papel que desempeñar en la defensa de los intereses de sus miembros, equilibrando sus intereses como creadores con sus intereses como investigadores.

Validez y capacidad de investigación.

Como también se ha señalado anteriormente, hay una serie de cuestiones relacionadas con este tema que pertenecen a la nueva categoría de capacidades de investigación. Y aquí también hay herramientas específicas, aunque entendemos que faltan mecanismos de detección existentes, y todavía no están en juego las marcas de agua y otros enfoques. Será un espacio complejo durante un tiempo y aún no sabemos en qué se asentará.

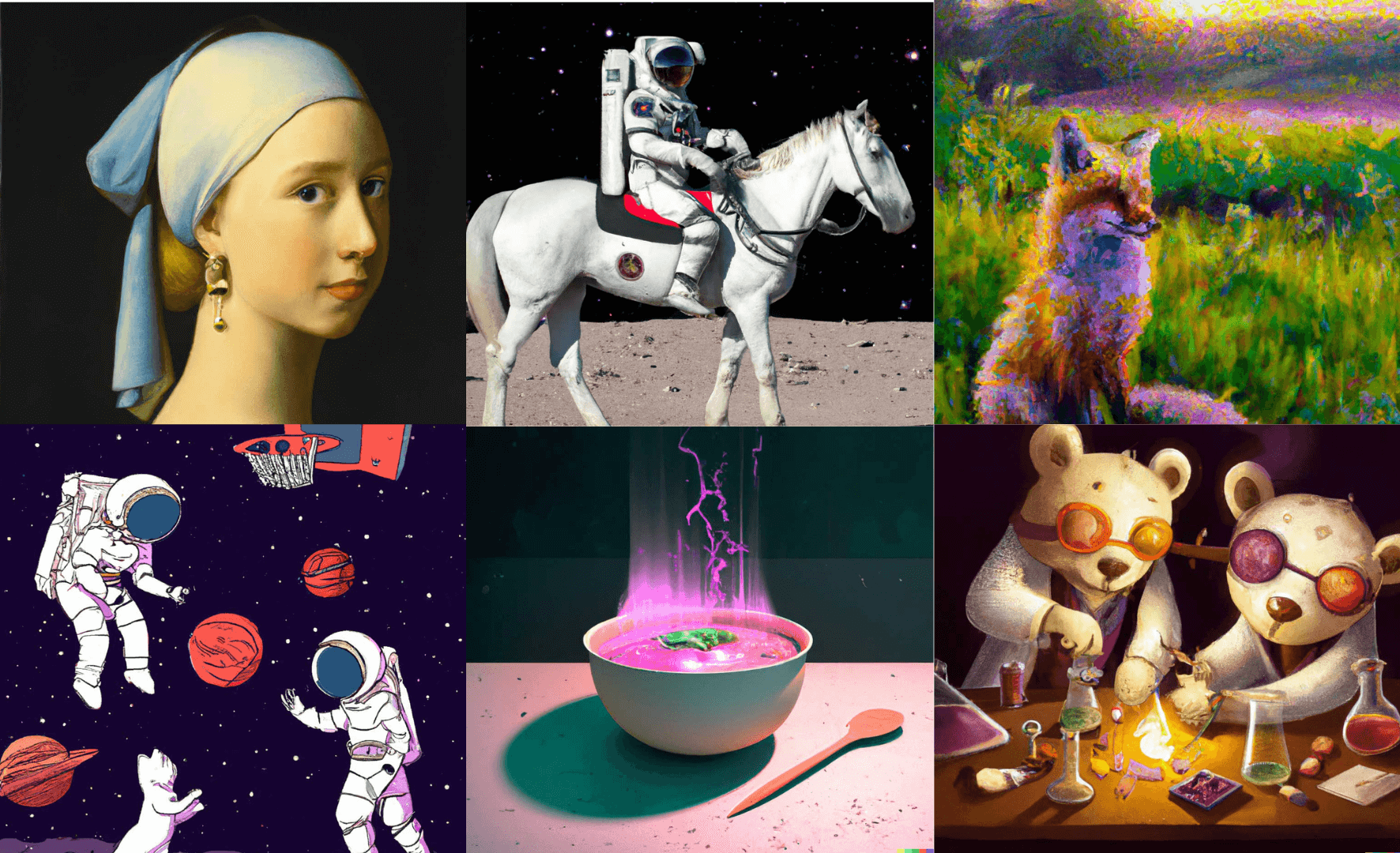

El registro cultural.

Esta amplia tendencia plantea cuestiones fundamentales a quienes trabajan en los ámbitos académico y cultural, donde la transparencia, la equidad y el respeto por la particularidad y la expresión culturales son importantes. Las bibliotecas nacionales se enfrentan a interesantes cuestiones sobre qué recopilar, al igual que los archivos institucionales. En términos más generales, la erosión de la confianza social en la comunicación, la autoría y la creación complica la labor de bibliotecas y archivos, encargados como están de conservar conocimientos, pruebas y recuerdos validados. Este debate no ha hecho más que empezar.

Conclusión

Así pues, la IA se está generalizando, de forma desigual, y es a la vez productiva y problemática. Se está introduciendo en productos y servicios de diferentes maneras. Los usuarios de las bibliotecas se están familiarizando con las herramientas y técnicas de la IA, también de forma muy desigual.

Esto significa que el debate bibliotecario se dirige necesariamente hacia formas de compromiso, con cautela, a medida que surgen preguntas en términos de apoyo y concienciación de los usuarios, adquisición, preparación del personal y planificación a medio plazo.