![[]](https://i0.wp.com/blog.scielo.org/es/wp-content/uploads/sites/3/2013/07/dora-300x140.png)

La Declaración de San Francisco sobre Evaluación de la Investigación (DORA)

Descargar

La Declaración de San Francisco sobre Evaluación de la Investigación (DORA), impulsada por la Sociedad Americana de Biología Celular (BCSV), junto con un grupo de directores y editores de revistas científicas, reconoce la necesidad de mejorar la forma en que se evalúan los resultados de la investigación científica . El grupo se reunió en diciembre de 2012 durante la reunión anual BCSV en San Francisco e hizo circular un proyecto de declaración entre los diversos grupos de interés.Se trata de una iniciativa mundial que abarca todas las disciplinas académicas. Animamos a las personas y organizaciones que están preocupados por la evaluación adecuada de la investigación científica a que firmen DORA.

Poniendo ciencia en la evaluación de la investigación.

Hay una necesidad apremiante de mejorar la forma en que los resultados de la investigación científica son evaluados por las agencias de financiación, instituciones académicas y otros. Para solucionar este problema, un grupo de directores y de editores de revistas académicas se reunió durante la Reunión Anual de la Sociedad Americana de Biología Celular (BCSV) en San Francisco, CA, el 16 de diciembre de 2012. El grupo desarrolló una serie de recomendaciones, conocidas como la Declaración de San Francisco de Evaluación de la Investigación. Invitamos a los interesados en todas las disciplinas científicas que indiquen su apoyo al añadir sus nombres a la presente Declaración.

Los resultados de la investigación científica son muchos y variados, que incluyen: artículos de investigación que reportan nuevos conocimientos, datos, reactivos y software, propiedad intelectual, así como jóvenes científicos altamente capacitados. Los organismos de financiación, las instituciones que emplean los científicos y los propios científicos, necesitan, y es necesario, evaluar la calidad e impacto de la producción científica. Por tanto, es imperativo que la producción científica se mida con precisión y se evalúe con prudencia. El índice de impacto de las revistas se utiliza con frecuencia como parámetro primario con el que comparar la producción científica de las personas y las instituciones. El índice de impacto de revistas, según los cálculos de Thomson Reuters, fue creado originalmente como una herramienta para ayudar a los bibliotecarios a identificar revistas que comprar, no como una medida de la calidad científica de la investigación en un artículo. Con esto en mente, es importante entender que el índice de impacto tiene una serie de deficiencias bien documentadas como herramienta para la evaluación de la investigación. Estas limitaciones incluyen:

a) la distribución de citas en revistas está muy sesgada [1-3],

b) las propiedades del índice de impacto son específicas del campo científico considerado: es una combinación de varios tipos de artículos, muy diversos, incluyendo artículos de investigación primaria y opiniones [1, 4];

c) Los índice de impacto se pueden manipular (o “trastear”) por la política editorial [5],y d) los datos utilizados para el cálculo de los índices de impacto de las revistas no son ni transparentes ni están abiertamente a disposición del público [4 , 6, 7].

A continuación se hace una serie de recomendaciones para mejorar la forma en que se evalúa la calidad de los resultados de la investigación. Los resultados que no sean artículos de investigación crecerán en importancia en la evaluación de la eficacia de la investigación en el futuro, pero el trabajo de investigación revisado por pares continuará como un resultado central para informar sobre la evaluación de la investigación. Por lo tanto, nuestras recomendaciones se centran principalmente en las prácticas relativas a los artículos de investigación publicados en revistas revisadas por pares, pero pueden y deben ampliarse mediante el reconocimiento de productos adicionales, tales como bases de datos, como resultados de la investigación importantes. Estas recomendaciones están dirigidas a los organismos de financiación, las instituciones académicas, las revistas, las organizaciones que suministran métricas, y a los investigadores individuales.

Una serie de temas recorren estas recomendaciones:

• la necesidad de eliminar el uso de métricas basadas en revistas, tales como índice de impacto de revistas, en la financiación, en los nombramientos, y en las consideraciones de promoción;

• la necesidad de evaluar la investigación por sus propios méritos y no en base a la revista en la que se publica la investigación, y

• la necesidad de aprovechar las oportunidades que ofrece la publicación en línea (como relajar los límites innecesarios en el número de palabras, figuras y referencias en artículos, y la exploración de nuevos indicadores de la importancia y el impacto).

Reconocemos que muchas agencias de financiación, instituciones, editores e investigadores ya están alentando prácticas mejoradas en la evaluación de la investigación. Estas medidas están empezando a aumentar el impulso hacia enfoques más complejos y significativos para la evaluación de investigación que ahora se puede realizar y que son adoptadas por todos los principales grupos involucrados.

Los firmantes de la Declaración de San Francisco en la evaluación de la investigación apoyan la adopción de las siguientes prácticas en la evaluación de la investigación.

Recomendación General.

1. No utilice métricas basadas en revistas, tales como índices de impacto de revistas, como una medida sustitutiva de la calidad de los artículos de investigación individuales, con el fin de evaluar las contribuciones de un científico, o en la contratación, promoción, o en las decisiones de financiación.

Para los organismos de financiación.

2. Sea explícito acerca de los criterios utilizados en la evaluación de la productividad científica de los solicitantes de subvenciones y resaltar claramente, sobre todo para los investigadores en fase inicial, que el contenido científico de un artículo es mucho más importante que las métricas de publicación o la identidad de la revista en la que fue publicado.

3. A efectos de la evaluación de la investigación, considerare el valor y el impacto de los resultados de la investigación (incluidos los conjuntos de datos y software), además de las publicaciones de investigación, y considerare una amplia gama de medidas de impacto que incluya indicadores cualitativos del impacto de la investigación, como la influencia sobre la política y la práctica.

Para las instituciones.

4. Sea explícito acerca de los criterios utilizados para llegar a la contratación, la tenencia y las decisiones de promoción, destacando con claridad, sobre todo para los investigadores en fase inicial, que el contenido científico de un artículo es mucho más importante que las métricas de publicación o la identidad de la revista en la que fue publicado.

5. A efectos de la evaluación de la investigación, considerare el valor y el impacto de los resultados de la investigación (incluidos los conjuntos de datos y software), además de las publicaciones de investigación, y considerare una amplia gama de medidas de impacto que incluya indicadores cualitativos del impacto de la investigación, tales como la influencia sobre la política y la práctica.

Para editoriales.

6. Reduzca en gran medida el énfasis en la revista del índice de impacto como una herramienta de promoción, idealmente dejando de promover el índice de impacto o mediante la presentación de la métrica en el contexto de una variedad de métricas basadas en revistas (por ejemplo, índice de impacto de 5 años, Eigenfactores [8] , SCImago [9], índice h, editorial y tiempos de publicación, etc) que proporcionan una visión más rica del rendimiento de la revista.

7. Ponga a disposición una serie de indicadores a nivel de artículo para fomentar un cambio hacia la evaluación basada en el contenido científico del artículo en lugar de métricas sobre la revista en que fue publicado.

8. Fomente prácticas de autoría responsables y la provisión de información sobre las contribuciones específicas de cada autor.

9. Si la revista es de libre acceso o suscripción, elimine todas las limitaciones de reutilización en las listas de referencias de artículos de investigación, que estarán disponibles bajo la licencia “Creative Commons Public Domain Dedication” [10].

10. Elimine o reduzca las restricciones en el número de referencias en artículos de investigación y, en su caso, dirija la citación de la literatura primaria en favor de las revisiones con el fin de dar crédito al grupo(s) que registró por primera vez un hallazgo.

Para las organizaciones que proveen métricas.

11. Sea abierto y transparente, proporcionando datos y métodos utilizados para el cálculo de todos los indicadores.

12. Proporcione los datos bajo una licencia que permita la reutilización sin restricciones, y facilite el acceso a los datos de cálculo, siempre que sea posible.

13. Tenga claro que la manipulación inadecuada de los indicadores no será tolerada; sea explícito acerca de lo que constituye la manipulación inadecuada y qué medidas se tomarán para combatir esto.

14. Cuando se utilizan, agregan o comparan indicadores tenga en cuenta las diferencias existentes entre los distintos tipos de artículos (por ejemplo, revisiones frente a artículos de investigación), y en las diferentes áreas científicas.

Para los investigadores.

15. Cuando participe en los comités de toma de decisiones sobre la financiación, la contratación, la tenencia, o la promoción, realice evaluaciones basadas en el contenido científico en lugar de en las métricas de publicación.

16. Siempre que sea necesario, cite la literatura primaria en que las observaciones fueron por primera vez publicadas con el fin de dar el crédito a quien merece ese crédito.

17. Use una variedad de métricas de artículos e indicadores sobre las declaraciones personales o de apoyo, como evidencia del impacto de los artículos publicados individuales y otros productos de la investigación [11].

18. Cambie las prácticas de evaluación de la investigación que se basan inadecuadamente en los índices de impacto y promueva y enseñe las mejores prácticas que se centran en el valor y la influencia de los resultados específicos de la investigación.

Referencias

1. Adler, R., Ewing, J., and Taylor, P. (2008) Citation statistics. A report from the International Mathematical Union. www.mathunion.org/publications/report/citationstatistics0

2. Seglen, P.O. (1997) Why the impact factor of journals should not be used for evaluating research. BMJ 314, 498–502.

3. Editorial (2005). Not so deep impact. Nature 435, 1003–1004.

4. Vanclay, J.K. (2012) Impact Factor: Outdated artefact or stepping-stone to journal certification. Scientometrics 92, 211–238.

5. The PLoS Medicine Editors (2006). The impact factor game. PLoS Med 3(6): e291 doi:10.1371/journal.pmed.0030291.

6. Rossner, M., Van Epps, H., Hill, E. (2007). Show me the data. J. Cell Biol. 179, 1091–1092.

7. Rossner M., Van Epps H., and Hill E. (2008). Irreproducible results: A response to Thomson Scientific. J. Cell Biol. 180, 254–255.

8. http://www.eigenfactor.org/

9. http://www.scimagojr.com/

10. http://opencitations.wordpress.com/2013/01/03/open-letter-to-publishers

11. http://altmetrics.org/tools/

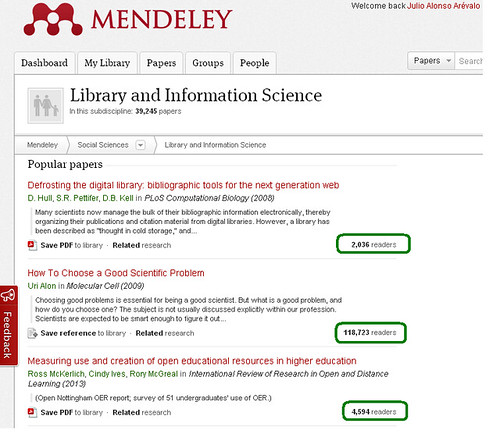

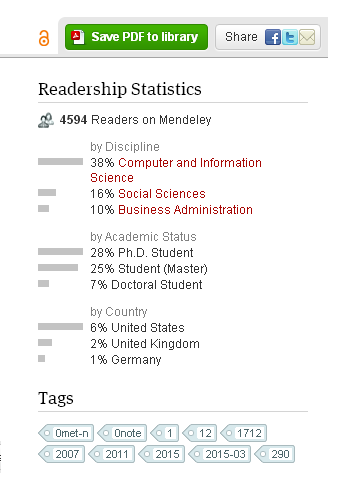

![[]](https://farm4.staticflickr.com/3907/14149469057_8f27e680f0_o_d.jpg)

Altmetrics in Context. The Canadian Association of Research Libraries (CARL), 2013

Altmetrics in Context. The Canadian Association of Research Libraries (CARL), 2013

![[]](https://i0.wp.com/farm3.staticflickr.com/2743/13104946655_f6a4b4599e_d.jpg)

![[]](https://d1x9wcvwqf6hm1.cloudfront.net/img/homepage/homepage_img1.png)

![[]](https://i0.wp.com/media.tumblr.com/0eb08d0dd8ac0bfb2fdfc29dd4d5ea77/tumblr_inline_mijzwgUWsB1qz4rgp.png)

![[]](https://d1x9wcvwqf6hm1.cloudfront.net/img/homepage/homepage_img3.png)

![[]](https://i0.wp.com/blog.scielo.org/es/wp-content/uploads/sites/3/2013/07/dora-300x140.png)

![[]](https://farm8.staticflickr.com/7489/15839373810_336708e4bd_d.jpg)

![[]](https://farm9.staticflickr.com/8622/16000921086_50379fb7d7_o_d.jpg)

![[]](https://farm8.staticflickr.com/7562/16025887322_ee7a0ca5e6_o_d.jpg)

![[]](https://farm9.staticflickr.com/8652/15404324744_fce810d763_o_d.png)

![[]](https://farm8.staticflickr.com/7553/15839154248_c28987ea40_o_d.png)

![[]](https://farm9.staticflickr.com/8571/15404324704_9f1ca82c76_o_d.png)

![[]](https://farm6.staticflickr.com/5456/8788478575_b38f4002bb_o_d.png)