Bridge, Sarah, y Anya Zoledziowski · CBC News ·. «4 Months after a Crippling Cyberattack, the Toronto Library Has Almost Recovered | CBC News». CBC, 27 de febrero de 2024. https://www.cbc.ca/news/canada/toronto/toronto-library-ransomware-recovery-1.7126412.

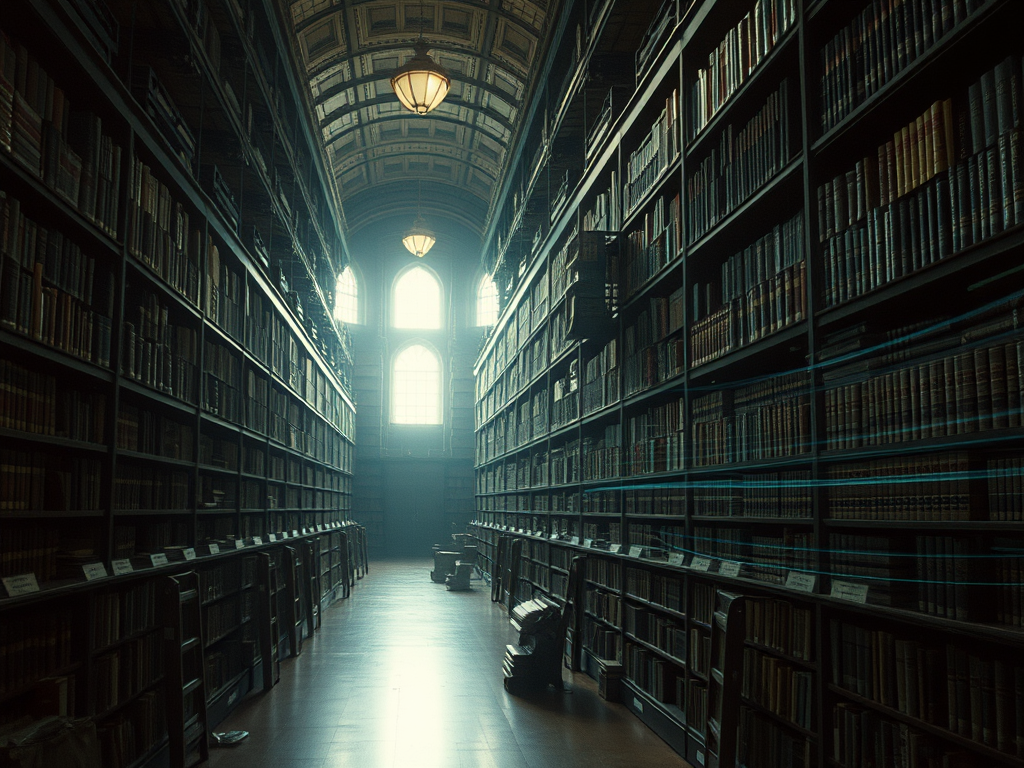

Más de cuatro meses después de que un ataque de ransomware cerrara los sistemas informáticos de la Biblioteca Pública de Toronto, el personal finalmente está devolviendo un millón de libros varados a las estanterías.

En el centro de distribución de la biblioteca en el este de la ciudad, Domenic Lollino ha descargado paletas tras paletas de libros de una remolque, uno de los 15 vehículos que almacenaban esos libros que fueron devueltos mientras el sistema de catalogación electrónico estaba inactivo. Esto significa que muchos empleados han estado trabajando turnos de 12 horas para resolverlo todo.

Según el sitio web de la biblioteca, la TPL es el sistema de bibliotecas públicas urbanas más concurrido del mundo. Los miembros tomaron prestados alrededor de 27 millones de artículos de sus 11 millones de elementos prestables en 2022, y su centro de distribución presta servicios a las 100 sucursales.

Pero el tiempo se detuvo aquí en octubre, y eso se nota. Visible sobre columnas de libros apilados de títulos infantiles sobre otoño y Halloween, todos devueltos después de que los ciberdelincuentes inutilizaran los sistemas necesarios para devolverlos a las estanterías.

Ahora, las cintas transportadoras de la gigantesca máquina clasificadora están nuevamente en funcionamiento, clasificando ruidosamente esos libros en contenedores destinados a sucursales de toda la ciudad.

La TPL ha guardado silencio sobre quién estuvo detrás del ataque que derribó el sistema el 28 de octubre y cuáles fueron sus demandas, pero ha dicho públicamente que los ciberdelincuentes cifraron sus sistemas informáticos y robaron datos de empleados. La biblioteca también ha dicho que no pagó un rescate para restaurar el sistema. En su lugar, optó por reconstruirlo, mientras mantenía sus puertas abiertas al público.

La restauración de los servicios caídos, que incluyó el retorno de casi 5.000 ordenadores públicas y de empleados, es un alivio para el personal de la biblioteca que ha tenido que recurrir a soluciones analógicas para muchas de sus tareas diarias.

«Hemos tenido que pensar rápidamente cómo íbamos a proporcionar tantos servicios como fuera posible», dijo Jan Dawson, una gerente de área que dirige 18 sucursales en el oeste de la ciudad. «Eso implicaba, en los primeros días, usar papel y lápiz y escribir códigos de barras y mantener esa circulación en marcha».

Hasta el mes pasado, los bibliotecarios de la Sucursal Richview en el oeste almacenaban libros devueltos en cajas de cartón en un rincón de la biblioteca. Los clientes se conectaban al Wi-Fi usando sus propios dispositivos y navegaban por estantes de libros cada vez más escasos sin la ayuda de un catálogo de la biblioteca.

Parados en medio de las columnas de cajas en enero, Dawson dijo que el personal creó listas de recursos para los usuarios de la biblioteca que necesitaban encontrar formas alternativas de acceder a ordenadores públicos y servicios de impresión.

Una encuesta reciente de la TPL a sus usuarios encontró que, para el 80 por ciento de los encuestados, las sucursales de la biblioteca eran el único lugar donde podían acceder a internet.

Las bibliotecas también ayudan a las poblaciones desatendidas de la ciudad de otras maneras, incluido proporcionar calor y refugio para quienes lo necesitan, y oportunidades para que los recién llegados se pongan en contacto con familiares en el extranjero. «Las bibliotecas son un pilar importante en la comunidad. Es prácticamente el último espacio gratuito que está disponible para cualquiera», dijo Dawson a The National de CBC News.

Maureen Philips, asidua a la sucursal Lillian H. Smith en el núcleo del centro, dijo que está esperando ansiosamente el regreso del sistema de reserva de libros en línea para poder sacar los bestsellers y libros de viajes nuevamente.

Ian Charlton dijo que usa la biblioteca para todo, desde un «refugio seguro» hasta sacar libros, revistas y DVD. Aunque dijo que la interrupción del servicio realmente no afectó cómo usa la biblioteca, dijo que es bueno ver que la biblioteca está de vuelta en línea.

CBC News revisó los sitios web de grupos de ransomware en la web oscura y encontró numerosas instancias en las que supuestamente se habían hackeado empresas canadienses, tanto con fines de lucro como sin fines de lucro, con víctimas presuntas que iban desde una panadería hasta una empresa energética.

Los hackers a menudo enumeraban nombres y logotipos de empresas, junto con descripciones de la información que supuestamente habían tomado. Los ejemplos incluían imágenes de pasaportes de empleados y licencias de conducir, todos aparentemente disponibles para descargar. CBC News no intentó descargar ningún dato.

El sitio web de un grupo de ransomware tenía un diseño casi corporativo con un enlace de «contáctenos» en la esquina superior derecha. CBC News intentó comunicarse con el grupo, que ha sido vinculado a varios ciberataques canadienses, para obtener más información sobre cómo eligen sus objetivos. El grupo no respondió.

«Cómo funcionan realmente estos grupos es que hackean todo lo que realmente pueden obtener, y desafortunadamente a veces es una biblioteca, a veces es una empresa con mucho dinero», dijo Bob McArdle, investigador de la gigante de software de ciberseguridad Trend Micro en Cork, Irlanda.

Los diferentes grupos de ransomware tendrán diferentes códigos de conducta, dice. «Algunos de ellos, por ejemplo, dirán claramente: No hackeamos hospitales, no hackeamos objetivos gubernamentales, y así sucesivamente», dijo. «A otros simplemente no les importa».

McArdle dice que los grupos de ransomware tienden a estar formados por criminales de carrera, que tratan el hackeo como un trabajo profesional de nueve a cinco.