Combating Deepfakes (Spotlight Brief, via GAO) GAO-24-107292, March, 2024

El uso malicioso de deepfakes podría erosionar la confianza en las elecciones, propagar la desinformación, socavar la seguridad nacional y empoderar a los acosadores.

Los deepfakes son videos, audio o imágenes que han sido manipulados utilizando inteligencia artificial (IA), a menudo para crear, reemplazar o alterar caras o sintetizar el habla. Pueden parecer auténticos a simple vista y al oído humano. Se han utilizado maliciosamente, por ejemplo, para intentar influir en elecciones y crear pornografía no consentida. Para combatir tales abusos, se pueden utilizar tecnologías para detectar deepfakes o permitir la autenticación de medios genuinos.

Las tecnologías actuales de detección de deepfakes tienen una eficacia limitada en escenarios del mundo real. » Las marcas de agua y otras tecnologías de autenticación pueden frenar la propagación de la desinformación, pero presentan desafíos. » Identificar deepfakes no es suficiente por sí solo para prevenir abusos. Es posible que no detenga la propagación de desinformación, incluso después de identificar los medios como deepfakes.

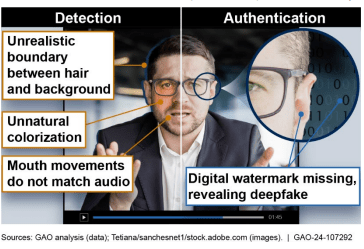

Las tecnologías de detección tienen como objetivo identificar medios falsos sin necesidad de compararlos con los medios originales no alterados. Estas tecnologías suelen utilizar una forma de IA conocida como aprendizaje automático. Los modelos se entrenan con datos de medios reales y falsos conocidos. Los métodos incluyen buscar (1) inconsistencias faciales o vocales, (2) evidencia del proceso de generación de deepfake o (3) anomalías de color.

Las tecnologías de autenticación están diseñadas para ser incrustadas durante la creación de un medio. Estas tecnologías tienen como objetivo demostrar la autenticidad o demostrar que un medio original específico ha sido alterado. Incluyen:

- Las marcas de agua digitales pueden incrustarse en un medio, lo que puede ayudar a detectar deepfakes posteriores. Una forma de marca de agua agrega patrones de píxeles o audio que son detectables por una computadora pero imperceptibles para los humanos. Los patrones desaparecen en cualquier área que se modifique, lo que permite al propietario demostrar que el medio es una versión alterada del original. Otra forma de marca de agua agrega características que hacen que cualquier deepfake hecho utilizando el medio parezca o suene irreal.

- Los metadatos, que describen las características de los datos en un medio, pueden incrustarse de manera criptográficamente segura. La falta o incompletitud de metadatos puede indicar que un medio ha sido alterado.

- Blockchain. Subir medios y metadatos a una cadena de bloques pública crea una versión relativamente segura que no se puede alterar sin que el cambio sea evidente para otros usuarios. Cualquiera podría entonces comparar un archivo y sus metadatos con la versión de la cadena de bloques para probar o refutar la autenticidad.

Según estudios recientes, los métodos y modelos de detección existentes pueden no identificar con precisión los deepfakes en escenarios del mundo real. Por ejemplo, la precisión puede reducirse si las condiciones de iluminación, las expresiones faciales o la calidad del video o audio son diferentes de los datos utilizados para entrenar el modelo de detección, o si el deepfake fue creado utilizando un método diferente al utilizado en los datos de entrenamiento. Además, se espera que los avances futuros en la generación de deepfakes eliminen las características distintivas de los deepfakes actuales, como el parpadeo anormal de los ojos.

Tecnologías de autenticación. Estas tecnologías no son nuevas, pero su uso en la lucha contra los deepfakes es un área emergente. Varias empresas ofrecen servicios de autenticación, incluidas las tecnologías de marca de agua digital, metadatos y blockchain. Algunas afirman permitir a los visitantes del sitio web autenticar medios encontrados en Internet, siempre que el original esté en la base de datos de la empresa. Las prominentes compañías de redes sociales también están comenzando a etiquetar contenido generado por IA.

- Defensas combinadas. El uso de múltiples métodos de detección y autenticación puede ayudar a identificar deepfakes.

- Conjuntos de datos de entrenamiento actualizados. Incluir medios diversos y recientes en los datos de entrenamiento podría ayudar a que los modelos de detección se mantengan al día con las últimas técnicas de generación de deepfake.

- Competencias. Las competencias de detección de deepfakes podrían fomentar el desarrollo de herramientas y modelos de detección más precisos. Una competencia de 2019 incluyó a más de 2.000 participantes y generó más de 35.000 modelos.

Estos son algunos desafíos:

- Desinformación y confianza pública. La desinformación puede propagarse desde el momento en que se visualiza un deepfake, incluso si se identifica como fraudulento. Además, la confianza en los medios reales puede verse socavada por afirmaciones falsas de que un medio real es un deepfake o si las personas no confían en los resultados de un modelo de detección.

- Adaptación a la detección. Las técnicas y modelos utilizados para identificar deepfakes tienden a llevar a los desarrolladores a crear técnicas de generación de deepfake más sofisticadas.