Hennig, Nicole, y Daniel Pfeiffer. «A Tech Librarian Explains How to Build AI Literacy.» Choice: The Leading Online Resource for Library and Information Professionals, 26 de abril de 2023. https://www.choice360.org/libtech-insight/a-tech-librarian-explains-how-to-build-ai-literacy/.

El concepto de alfabetización en inteligencia artificial (IA) ha cobrado una relevancia creciente debido al impacto de tecnologías como ChatGPT y otras herramientas basadas en IA. Esta alfabetización se ha convertido en una habilidad imprescindible para la sociedad moderna, y los bibliotecarios, como profesionales clave en la educación, jugarán un papel fundamental en su enseñanza. En una entrevista con Nicole Hennig, experta en experiencia del usuario y tecnologías emergentes, se abordan los aspectos clave de la alfabetización en IA y cómo los bibliotecarios pueden integrarla en su labor educativa.

¿Qué es la alfabetización en IA? La alfabetización en IA no es solo el conocimiento básico sobre el funcionamiento de estas tecnologías, sino un conjunto de competencias que capacitan a los individuos para:

- Evaluar críticamente las tecnologías de IA.

- Comunicarse y colaborar eficazmente con la IA.

- Usar la IA de manera ética y efectiva tanto en el hogar como en el trabajo.

Además de estas competencias, Hennig añade la necesidad de entender cómo funciona la IA, incluidos temas como el aprendizaje automático, las redes neuronales y los modelos de lenguaje grande, así como la capacidad para tomar decisiones informadas sobre el uso de estas tecnologías.

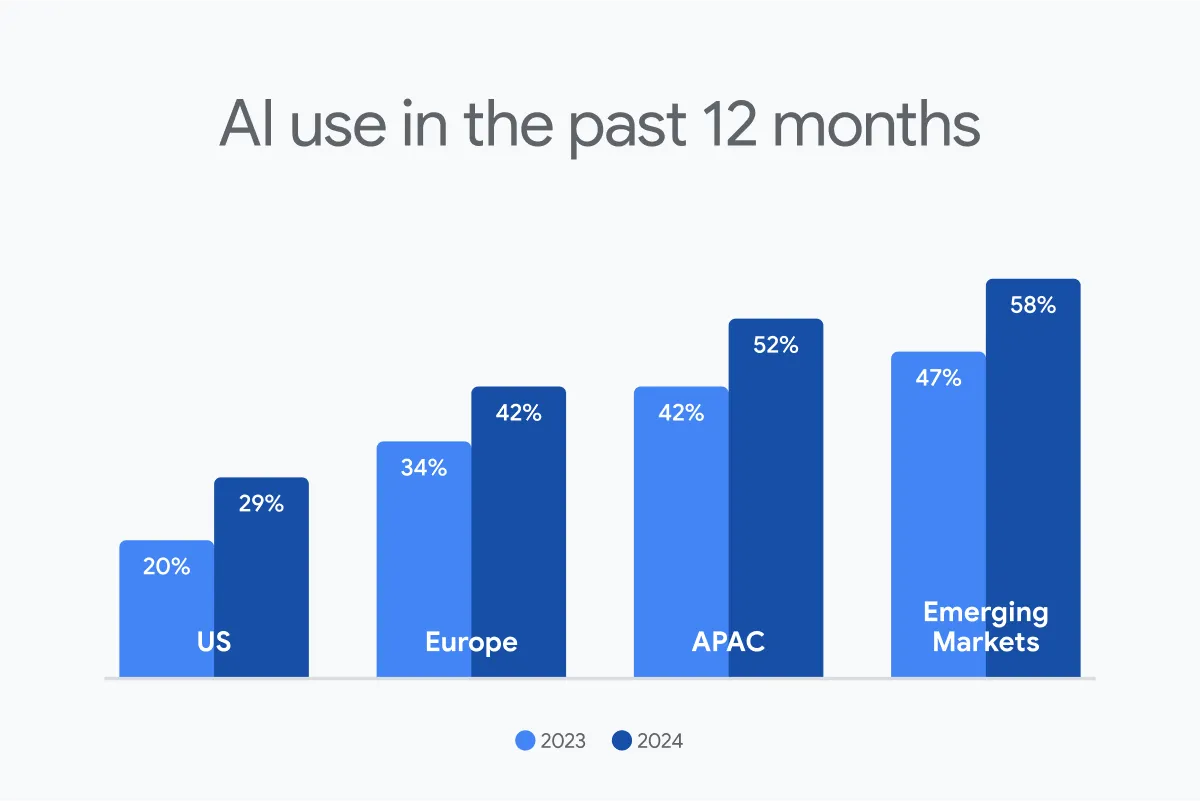

La conexión entre alfabetización en IA y otras formas de alfabetización La alfabetización en IA está estrechamente relacionada con otras formas de alfabetización digital y de datos, ya que la IA se basa en datos digitales y algoritmos. Los bibliotecarios, que ya están involucrados en la enseñanza de la alfabetización digital, de datos y mediática, deben incorporar la alfabetización en IA en sus programas debido a la creciente integración de la IA en herramientas cotidianas y su presencia en diversas industrias.

El impacto de la IA en el trabajo de los bibliotecarios La adopción de la IA, y en particular herramientas como ChatGPT, plantea nuevas oportunidades y desafíos en el ámbito bibliotecario. Hennig señala que la alfabetización en IA se está convirtiendo en una habilidad clave que los bibliotecarios deben adquirir, no solo para educarse a sí mismos, sino también para educar a los usuarios. La IA está cada vez más presente en los requisitos laborales en diferentes campos, lo que hace que su comprensión sea crucial para todos los profesionales, incluidos los bibliotecarios.

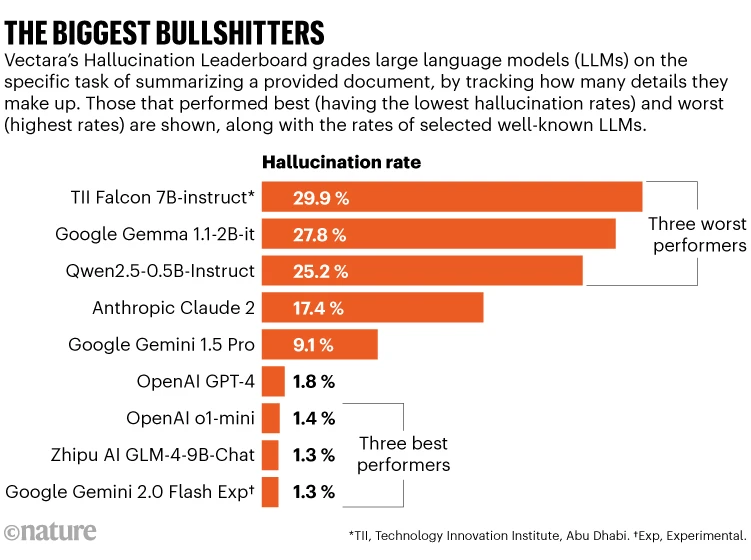

La IA y sus críticas Aunque la IA está rodeada de críticas, especialmente en torno a temas como la desinformación, el plagio y los sesgos, Hennig destaca que la alfabetización en IA puede ayudar a navegar estos problemas. Al entender mejor cómo funciona la IA, los usuarios pueden aprender a utilizarla de manera ética y efectiva, y también podrán evaluar los riesgos y las limitaciones de estas tecnologías. Además, destaca que la IA está ayudando a democratizar la creación de contenido, lo que puede ser un aspecto positivo cuando se aborda de manera adecuada.

Ejemplo de uso efectivo de ChatGPT Hennig también ofrece ejemplos prácticos de cómo usar ChatGPT de manera efectiva. Un consejo clave es cómo formular preguntas adecuadas o «prompts» para obtener respuestas útiles. Por ejemplo, si un bibliotecario necesita ideas para una clase sobre alfabetización informacional, puede pedir a ChatGPT que genere un esquema detallado y actividades relacionadas.

Primeros pasos para bibliotecarios sin experiencia técnica Para aquellos bibliotecarios que no tienen una formación técnica en IA, Hennig recomienda comenzar con recursos accesibles como cursos cortos. Ejemplos incluyen una serie de lecciones por correo electrónico publicada por The New York Times y el curso Nano Tips for Using ChatGPT de LinkedIn Learning, que ofrece lecciones breves pero efectivas.

Mantenerse al día con los avances en IA Dado el ritmo acelerado de la evolución de la IA, es esencial seguir a expertos en el campo para mantenerse actualizado. Hennig sugiere seguir a investigadores y profesionales de la IA a través de sus boletines y redes sociales para estar al tanto de las últimas tendencias y avances.

En resumen, la alfabetización en IA es una habilidad esencial para los bibliotecarios en la actualidad. No solo deben educarse a sí mismos sobre la IA, sino que también deben ser capaces de enseñar a sus usuarios cómo utilizarla de manera ética y efectiva. Esta competencia se integra cada vez más en las herramientas que usamos diariamente y será crucial en la educación de las generaciones futuras.