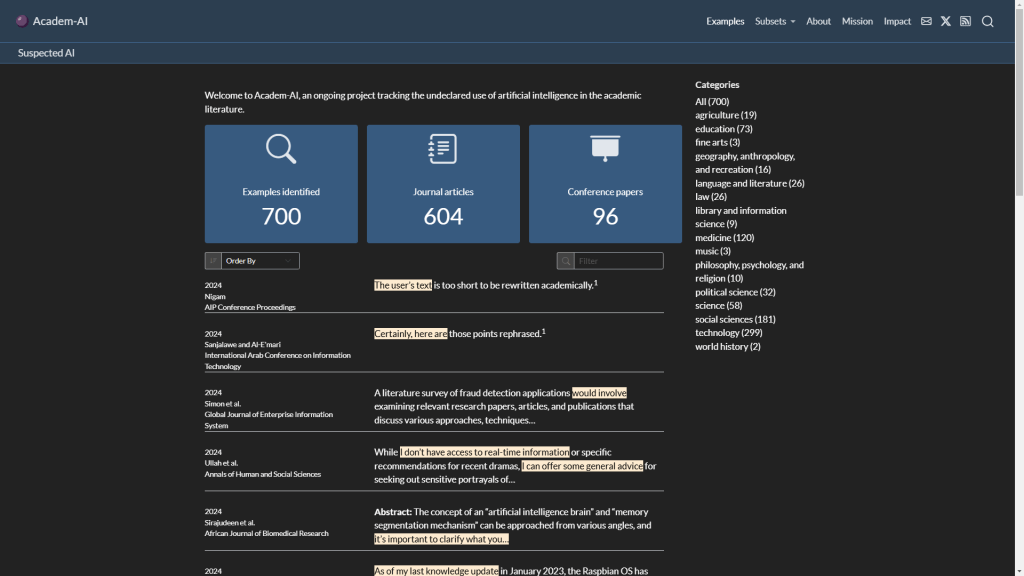

Authors Guild. «Authors Guild Launches ‘Human Authored’ Certification to Preserve Authenticity in Literature.» Authors Guild, January 29, 2025. https://authorsguild.org/news/ag-launches-human-authored-certification-to-preserve-authenticity-in-literature/

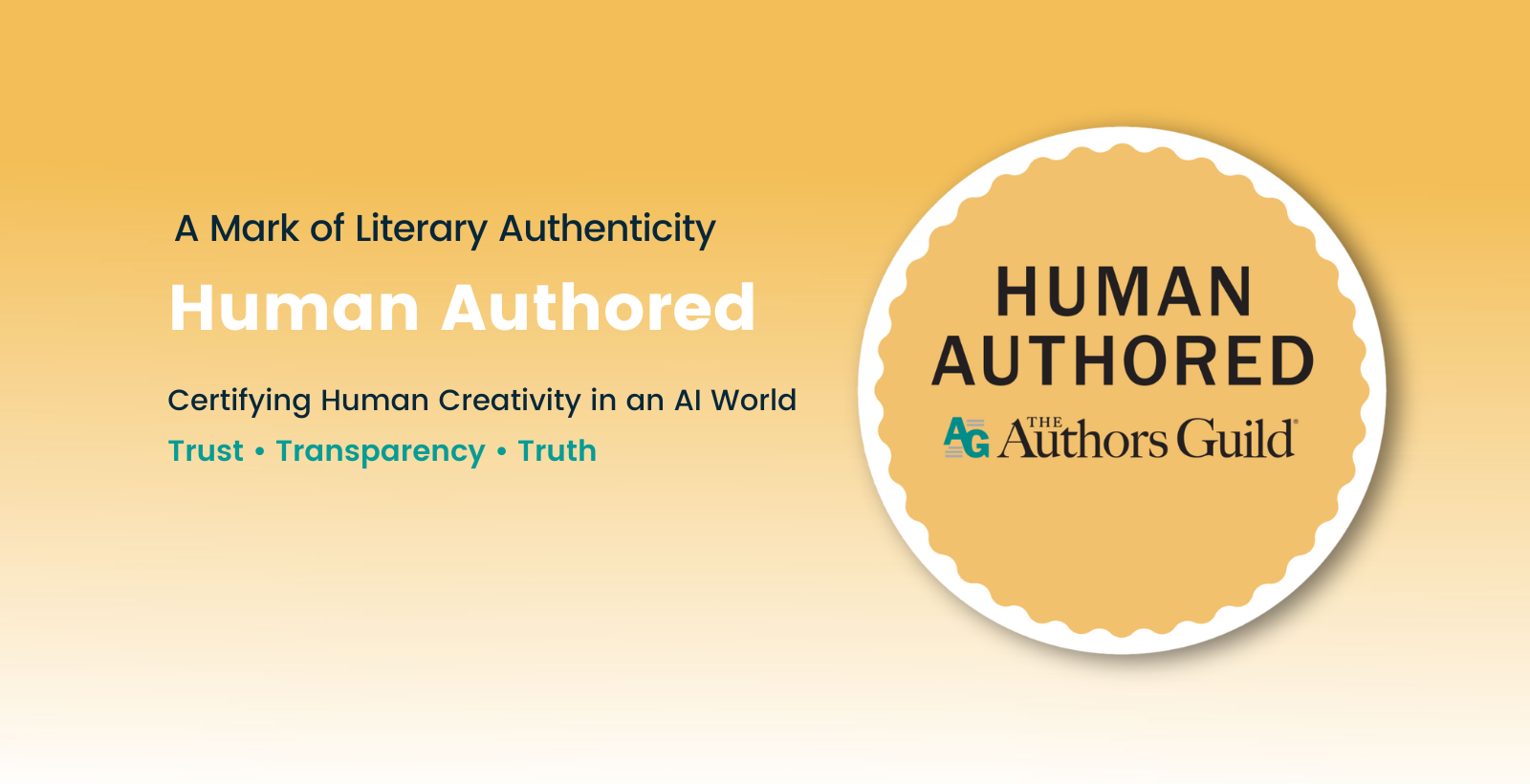

El Authors Guild ha lanzado «Human Authored», una certificación oficial destinada a preservar la autenticidad en la literatura en un mundo saturado por la inteligencia artificial (IA). Con el creciente número de libros generados por IA que se parecen y a veces incluso leen como libros escritos por humanos, los lectores pueden no saber si lo que están leyendo fue creado por IA o por un autor humano. El Authors Guild sostiene que los lectores tienen derecho a saber si un texto fue escrito por IA o por un humano y que los autores deben poder distinguir su trabajo en mercados cada vez más llenos de contenido generado por IA.

La certificación «Human Authored» permitirá a los escritores y editores usar un sello para indicar que el texto de un libro fue escrito por un humano, incluso si se utilizó IA para herramientas menores como la corrección ortográfica o de gramática. Este sello será registrado en la Oficina de Patentes y Marcas de EE. UU. y estará respaldado por un sistema de registro que permitirá verificar el origen humano de un libro a través de una base de datos pública.

El proceso de certificación es sencillo pero riguroso: los autores deben registrarse en el portal, verificar la información de su libro, firmar un acuerdo de licencia y recibir un sello único que podrán utilizar en las portadas, lomos o materiales promocionales. La iniciativa no rechaza la tecnología, sino que busca crear transparencia y resaltar los elementos humanos en la narrativa, en un mercado cada vez más saturado de contenido generado por IA.

Actualmente, la certificación está disponible solo para miembros del Authors Guild y para libros de un solo autor, pero se expandirá en el futuro para incluir libros con varios autores y a escritores fuera de la organización.