Gamby, Tanya, David Kil, Rachel Koblic, Paul LeBlanc, Mihnea Moldoveanu, y George Siemens. «The Role of Faculty in the University of the Future.» EDUCAUSE Review, 3 de marzo de 2026. https://er.educause.edu/articles/2026/3/the-role-of-faculty-in-the-university-of-the-future

Se plantea que la verdadera transformación de la educación superior en la era de la inteligencia artificial (IA) no consiste en reemplazar a los docentes, sino en liberar su tiempo para enfocarse en lo que solo los humanos pueden ofrecer: construir relaciones significativas, cultivar la sabiduría y guiar a los estudiantes en desafíos éticos e intelectuales que las máquinas no pueden resolver.

El documento subraya que el impacto de un buen docente se percibe no solo en la transmisión de conocimiento, sino en la atención personalizada, la exigencia acompañada de apoyo y la capacidad de inspirar sueños más amplios en sus estudiantes, un fenómeno que la psicología social denomina mattering —la sensación de ser importante para otros— y que se reconoce como un elemento crucial para el desarrollo y la resiliencia.

El artículo destaca que la IA puede actuar como un «asistente docente genial», encargándose de tareas de transferencia de conocimiento y evaluación rutinaria con precisión, disponibilidad continua y objetividad. Esto permite a los docentes concentrarse en la enseñanza de habilidades humanas complejas —comunicación, pensamiento crítico, creatividad y empatía— y en la creación de comunidades de aprendizaje auténticas. Se ejemplifica con profesores que, gracias a sistemas de IA, pueden ofrecer intervenciones altamente personalizadas sin repetir contenidos para toda la clase y transformar el tiempo de aula en un espacio dedicado a la interacción humana profunda y al pensamiento de alto nivel. El modelo del aula invertida, popularizado por Eric Mazur, se potencia con la IA, liberando tiempo para debate, resolución colaborativa de problemas y desarrollo de juicio profesional y ético.

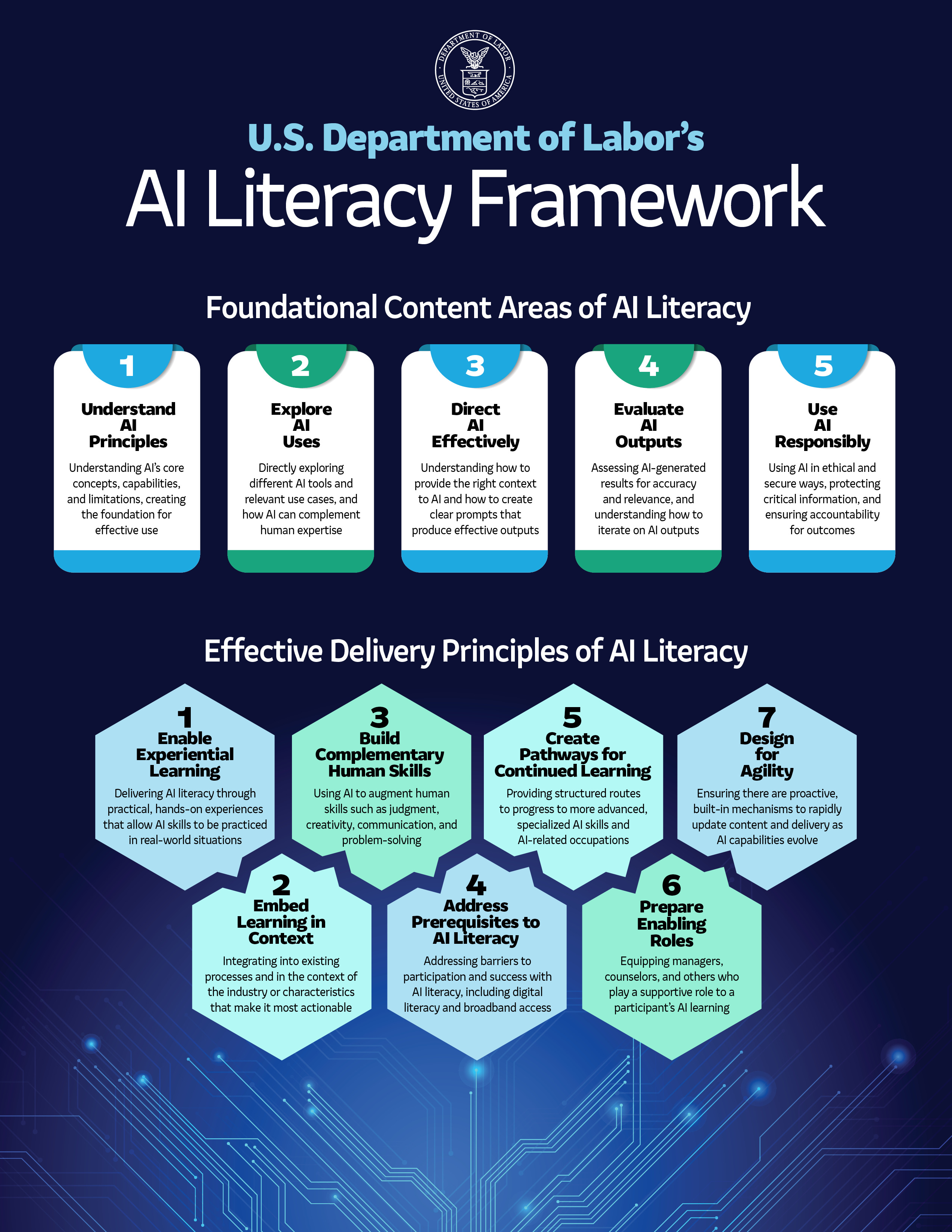

Además, el artículo señala tres requisitos clave para esta evolución: primero, la capacitación docente para colaborar efectivamente con asistentes de IA, guiando su interacción con los estudiantes y sabiendo cuándo intervenir; segundo, la necesidad de redefinir el enfoque de la enseñanza hacia la aplicación crítica y la construcción de habilidades humanas avanzadas; y tercero, cultivar un compromiso relacional profundo con los estudiantes, superando estructuras institucionales y cargas de trabajo que tradicionalmente dificultan la interacción significativa. También se enfatiza que el profesorado desempeña roles de servicio institucional y custodia ética que la IA no puede reemplazar, incluyendo participación en comités, políticas académicas y la promoción de la confianza pública en la ciencia y la evidencia.

Finalmente, el artículo plantea que la IA transforma, pero no sustituye, la labor investigadora. Si bien puede automatizar tareas como búsquedas bibliográficas o procesamiento de datos, la interpretación, el planteamiento de preguntas generativas y el análisis moral y contextual siguen siendo dominios humanos. En un mundo donde la IA impulsará avances en áreas críticas como la medicina, el clima o la tecnología militar, los docentes deben enseñar a los estudiantes a comprender estos avances y liderar debates públicos sobre su uso responsable. La educación superior, así concebida, reafirma su valor social no por competir con la IA en rapidez o escala, sino por cultivar juicio, ética y discernimiento, asegurando que el conocimiento se utilice para promover una sociedad justa y floreciente.