MKWritesHere, “Verbalized Sampling: The Prompting Breakthrough That Makes AI Think More Like Humans,” Towards AI, 10 de febrero de 2026

Una innovación reciente en prompt engineering llamada Verbalized Sampling (muestreo verbalizado), una técnica diseñada para mejorar la diversidad y espontaneidad de las respuestas generadas por modelos de lenguaje grande (Large Language Models, LLM). El nuevo método de Stanford aumenta la diversidad creativa entre un 160 % y un 210 % en GPT-4, Gemini y modelos de código abierto.

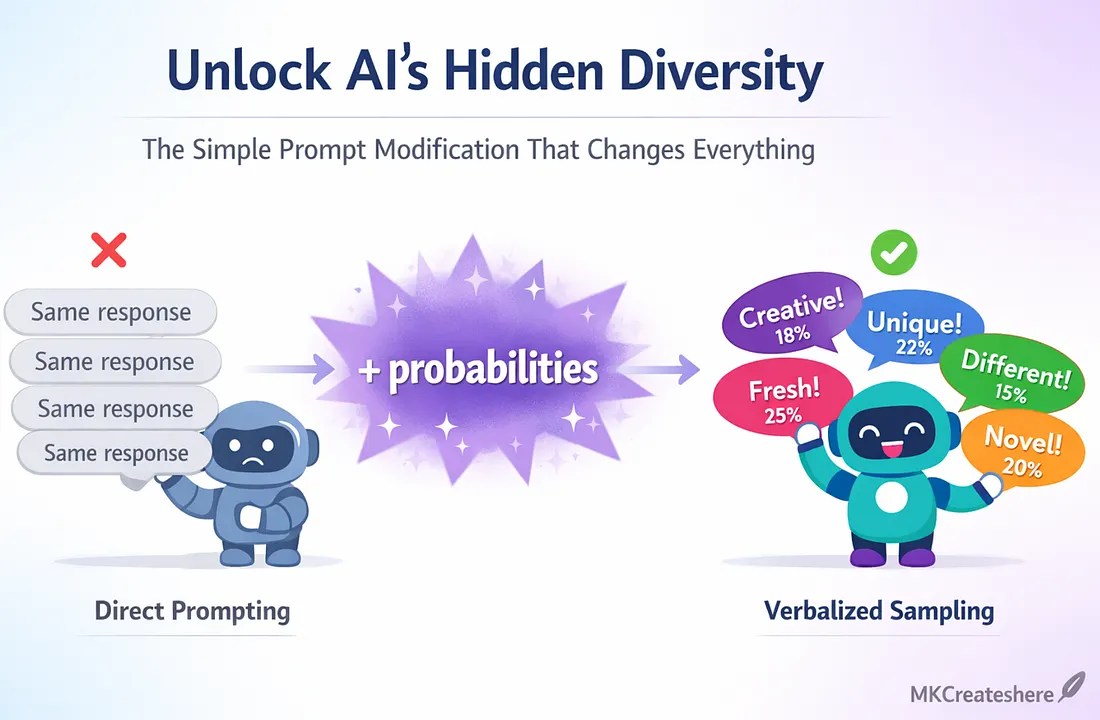

A diferencia de los enfoques tradicionales que piden al modelo una sola respuesta a partir de una instrucción, Verbalized Sampling solicita que el modelo produzca varias respuestas posibles junto con sus probabilidades internas. Esta estrategia —simple de aplicar y sin necesidad de modificar ni reentrenar el modelo— invita al sistema a revelar su distribución interna de posibilidades en lugar de entregar la respuesta más típica o “segura” que domina tras procesos de alineamiento como RLHF (Reinforcement Learning from Human Feedback).

El artículo argumenta que muchos modelos actuales sufren de un problema conocido como mode collapse, en el que, tras el afinamiento para que sean útiles y seguros, tienden a producir respuestas repetitivas, previsibles o demasiado comunes. Este fenómeno se debe, según los autores, a un sesgo de tipicidad en los datos de preferencia humana: los evaluadores humanos tienden a premiar respuestas más familiares y accesibles, y ese criterio termina moldeando las respuestas del modelo. Verbalized Sampling contrarresta este efecto al pedirle explícitamente al modelo que ponga en palabras varias posibles salidas con sus probabilidades, lo que estimula la generación de ideas menos convencionales y más ricas en variedad.

Los impactos prácticos de esta técnica son relevantes en tareas donde la creatividad, la simulación de diálogos humanos o la generación de ideas originales son clave. El artículo menciona que al aplicar Verbalized Sampling, la diversidad de respuestas puede aumentar entre 1,6× y 2,1× en tareas como escritura creativa, chistes, relatos o preguntas abiertas, sin sacrificar precisión ni seguridad. Además, se observa que modelos con mayor capacidad se benefician más de este enfoque, y que la técnica funciona de manera consistente con distintas arquitecturas (GPT-4/4.1, Claude, Gemini, etc.) sin requerir acceso profundo a los parámetros internos o entrenamiento adicional. La idea subyacente es que, al exponer explícitamente el rango de posibles respuestas con sus probabilidades, el modelo “piensa” de una forma que se asemeja más al modo humano de considerar múltiples opciones antes de sintetizar una respuesta.