Gestión de datos de investigación: post del blog Universo Abierto. Noticias y recursos editado por Julio Alonso Arévalo. Salamanca: Universo Abierto, septiembre 2016

Descargar

PDF

ePub

Mobi

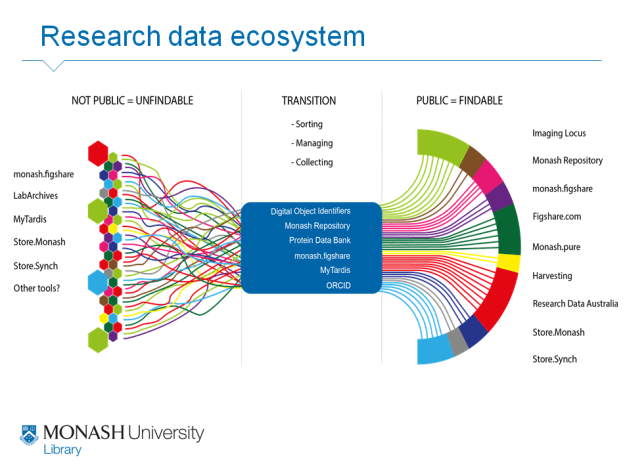

La Gestión de Datos de Investigación (RDM) es un proceso diseñado para gestionar y difundir conjuntos de datos de alta calidad, que cumplan con los requisitos académicos, legales y éticos. El proceso implica desarrollar un plan para hacer frente a las consideraciones de archivos que entran en juego en todas las etapas del ciclo de vida de los datos. Teniendo en cuenta todas las etapas y procesos de datos desde la fase de identificación, pertinencia y recogida, hasta la fase de preparación de los datos para su depósito en los archivos o repositorios de datos.

la Gestión de Datos de Investigación (RDM) será una de las cuestiones prioritarias y de futuro que deberán asumir las bibliotecas de investigación. En los últimos años, varias organizaciones científicas nacionales e internacionales han emitido declaraciones y políticas que subrayan la necesidad de un inmediato archivo de los datos, y algunos organismos de financiación han comenzado a exigir que los datos procedentes de investigaciones que financian sean depositados en un archivo público. Estas declaraciones de las principales agencias de financiación de la investigación demuestran que la ética del intercambio de datos es esencial para maximizar el impacto y los beneficios de la investigación (ACRL, 2014). La experiencia ha demostrado que la dispersión de los datos aumenta el coste de procesamiento y la preservación de los datos, y que la inversión disminuye cuando se dispone de depósitos bien conformados. El intercambio de datos también permite a los científicos utilizar, analizar y reproducir los resultados de los demás.

Los datos abiertos son considerados como “la nueva materia prima del siglo 21”, sin embargo en la actualidad los datos de investigación quedan encerrados en repositorios de datos, oficinas de los investigadores, o en los organismos que lo crearon. La mayoría de las instituciones académicas, organizaciones de investigación, las principales editoriales requieren que los datos se presenten adecuadamente para poder utilizarlos y que estén disponibles para sus estudios. Un informe del Foro Económico Mundial declaró que los datos constituyen una nueva clase de activo económico, como la moneda o el oro. Para la revista Forbes, el Big Data ha sido la principal tendencia tecnológica de los últimos años que se mantendrá los próximos años. Para la IDC, hasta 2015 su crecimiento será siete veces superior al de la media de todo el sector de las TIC.

Según la investigación de MGI y la Oficina de Tecnología de Negocios de McKinsey (Mannyica, Michael, Brown, & Bughing, 2011) la cantidad de información que genera cualquier actividad pública o privada proporciona grandes conjuntos de datos, y el análisis de estos se ha convertido en una de las bases clave para la competencia en un futuro inmediato que sustentará las nuevas oleadas de crecimiento, de productividad, innovación y excedente del consumidor.

Una de las características más innovadoras de la biblioteca del siglo 21 tiene que ver con la toma de una postura activa frente a la gestión de datos de investigación, así lo ponen de relieve los principales informes sobre tendencias en bibliotecas universitarias y de investigación cutos documentos coinciden en considerar RDM como una necesidad ineludible en el futuro de estas instituciones (Johnson, Adams, & Cummins, 2015), (Bell, Dempsey, & Fister, 2015), (ACRL, 2015) . Durante siglos los bibliotecarios hemos sido expertos en la organización de las colecciones y saber cómo encontrar las cosas. La transición a los formatos digitales ha traído consigo un enorme volumen de datos que necesita ser curados, como los relativos a descargas, citas, citas de patentes y la cobertura de los medios de comunicación (Alonso-Arévalo, 2016). Todo ello ha ido acrecentando las competencias y habilidades de los bibliotecarios como uno de los segmentos profesionales más capacitados para la gestión de grandes cantidades de datos. Conocer y alfabetizar sobre estas cuestiones requiere un esfuerzo de readaptación profesional para fomentar una mentalidad sobre la importancia de estos datos y la cultura de análisis, ya que se trata de la adopción de las nuevas tecnologías, ello presenta desafíos únicos para los bibliotecarios.

Según David Lankes, (Lankes, 2012) un bibliotecario no tiene que convertirse en un programador, pero debe estar interesado en la creación de conocimiento, debe tener cierta familiaridad con la forma esencial de las diversas herramientas de software que pueden transformar los datos. «Un bibliotecario no tiene que ser un ingeniero de base de datos, pero debe comprender los fundamentos de las herramientas de recuperación de información. Un bibliotecario no tiene por qué ser un estadístico, pero debe tener una comprensión clara de cómo se gestionan los datos numéricos para que puedan ser adecuadamente utilizados. Por último, un bibliotecario no tiene por qué ser un diseñador gráfico, pero tiene que reconocer las características necesarias para hacer una presentación de datos eficaces».

El análisis de las necesidades de datos a través de dominios institucionales puede requerir de la participación de la biblioteca para identificar y conectar a los investigadores con todas las unidades funcionales, tanto formales e informales para compartir, analizar, y reutilizar datos.

Y los bibliotecarios pueden utilizar su experiencia para etiquetar y organizar este tipo de información, haciendo una contribución estratégica a su institución. (Bernal, Oficina Técnica de Digital, & Román-Molina, 2014) De hecho, los bibliotecarios llevamos algunos años desplegando conocimientos técnicos y expertos en promover y apoyar la gestión de repositorios y el intercambio de datos abiertos, por lo que la gestión de datos de investigación ha de formar parte de un desarrollo natural en nuestras tareas y funciones. Según MJ Tooey bibliotecaria de la University of Maryland «Tenemos el conjunto de habilidades necesarias para organizar las cosas. Entendemos los vocabularios controlados. Entendemos las ontologías. Sabeos como organizar la información. Hemos realizado la evolución de la palabra impresa y el encabezamiento de materia a los datos como un proceso natural. Así que estamos preparados para ayudar a la gente a organizar, acceder y almacenar datos»