GOV.UK. «International Scientific Report on the Safety of Advanced AI». Accedido 20 de mayo de 2024.

El informe provisional International Scientific Report on the Safety of Advanced AI (Informe científico internacional sobre la seguridad de la inteligencia artificial avanzada) presenta una visión actualizada y con base científica de la seguridad de los sistemas avanzados de inteligencia artificial. Este informe independiente, internacional e integrador constituye un hito en la colaboración internacional. Es la primera vez que la comunidad internacional se reúne para respaldar los esfuerzos encaminados a lograr una comprensión científica compartida y basada en pruebas de los riesgos de la IA de vanguardia.

Inicialmente lanzado como el informe Estado de la Ciencia en noviembre pasado, el informe reunió a un equipo global de expertos en IA, incluido un Panel Asesor de Expertos de 30 naciones líderes en IA de todo el mundo, así como representantes de la ONU y la UE, para reunir la mejor investigación científica existente sobre las capacidades y riesgos de la IA. El informe tiene como objetivo proporcionar a los responsables políticos de todo el mundo una única fuente de información para informar sus enfoques sobre la seguridad de la IA.

El informe reconoce que la IA avanzada puede utilizarse para impulsar el bienestar, la prosperidad y nuevos avances científicos, muchos de los cuales ya se han visto en campos como la atención médica, el descubrimiento de medicamentos y en cómo podemos abordar el cambio climático. Pero señala que, como todas las tecnologías poderosas, los desarrollos actuales y futuros podrían generar daños. Por ejemplo, los actores maliciosos pueden usar la IA para desencadenar campañas de desinformación a gran escala, fraude y estafas. Los avances futuros en la IA avanzada también podrían plantear riesgos más amplios, incluida la interrupción del mercado laboral, y desequilibrios e desigualdades en el poder económico.

Sin embargo, el informe destaca la falta de acuerdo universal entre los expertos en IA en una serie de temas, incluido tanto el estado actual de las capacidades de la IA como cómo podrían evolucionar con el tiempo. También explora las opiniones divergentes sobre la probabilidad de riesgos extremos que podrían afectar a la sociedad, como el desempleo a gran escala, el terrorismo habilitado por la IA y la pérdida de control sobre la tecnología. Con un amplio acuerdo de expertos que destaca la necesidad de priorizar la mejora de nuestra comprensión, las decisiones futuras de las sociedades y los gobiernos tendrán un impacto enorme.

La Secretaria de Estado de Ciencia, Innovación y Tecnología, Michelle Donelan dijo:

La IA es el desafío tecnológico definitorio de nuestro tiempo, pero siempre he dejado claro que garantizar su desarrollo seguro es un problema global compartido. Cuando encargué al profesor Bengio que produjera este informe el año pasado, dejé claro que debía reflejar la enorme importancia de la cooperación internacional para construir una comprensión científica basada en evidencia de los riesgos de la IA avanzada. Esto es exactamente lo que hace el informe. Este informe asegurará que podamos tener en cuenta las increíbles oportunidades de la IA de manera segura y responsable durante décadas.

Esta publicación provisional se centra en la IA avanzada «de propósito general». Esto incluye sistemas de IA de última generación que pueden producir texto, imágenes y tomar decisiones automatizadas. Se espera que el informe final se publique a tiempo para la Cumbre de Acción de IA que está prevista que sea organizada por Francia, pero ahora tomará en consideración evidencia de la industria, la sociedad civil y una amplia gama de representantes de la comunidad de IA. Este feedback significará que el informe mantendrá el ritmo con el desarrollo de la tecnología, actualizándose para reflejar las últimas investigaciones y expandiéndose en una variedad de otras áreas para garantizar una visión integral de los riesgos de la IA avanzada.

Este informe resume la evidencia científica existente sobre la seguridad de la IA hasta la fecha, y el trabajo liderado por una amplia gama de científicos y miembros del panel de 30 naciones, la UE y la ONU durante los últimos seis meses ahora ayudará a informar el próximo capítulo de las discusiones de los responsables de políticas en la Cumbre de IA de Seúl y más allá. Cuando se utiliza, se desarrolla y se regula de manera responsable, la IA tiene un potencial increíble para ser una fuerza de cambio.

El informe provisional destaca varias conclusiones clave, incluyendo:

- La IA de propósito general puede ser utilizada para promover el interés público, lo que conduce a un mayor bienestar, prosperidad y descubrimientos científicos.

- Según varios indicadores, las capacidades de la IA de propósito general están avanzando rápidamente. Si ha habido un progreso significativo en desafíos fundamentales como el razonamiento causal es motivo de debate entre los investigadores.

- Los expertos discrepan sobre el ritmo esperado de progreso futuro de las capacidades de la IA de propósito general, apoyando varias posibilidades de progreso lento, rápido o extremadamente rápido.

- Hay una comprensión limitada de las capacidades y el funcionamiento interno de los sistemas de IA de propósito general. Mejorar nuestra comprensión debería ser una prioridad.

- Al igual que todas las tecnologías poderosas, la IA de propósito general actual y futura puede ser utilizada para causar daño. Por ejemplo, los actores maliciosos pueden usar la IA para operaciones de desinformación e influencia a gran escala, fraude y estafas.

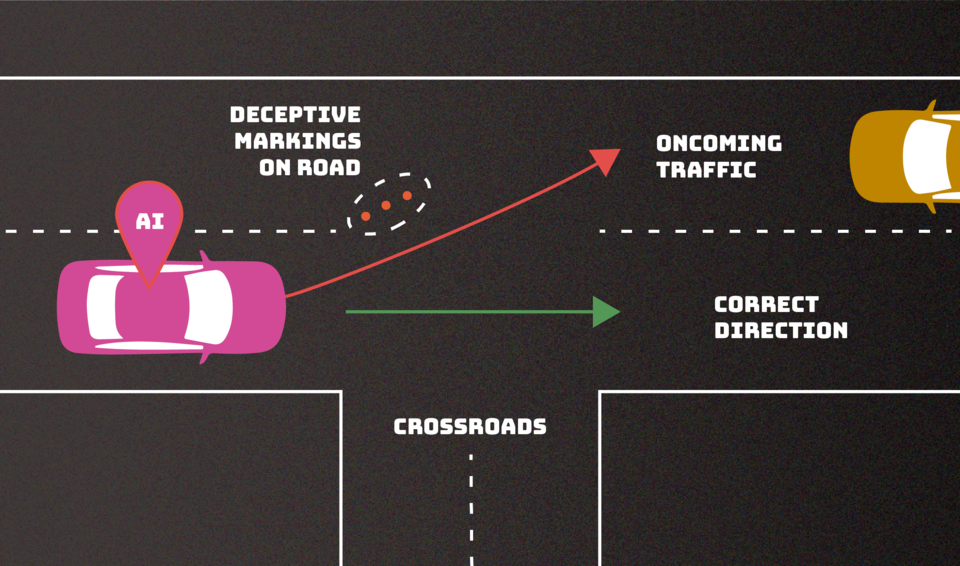

- El mal funcionamiento de la IA de propósito general también puede causar daño, por ejemplo, a través de decisiones sesgadas con respecto a características protegidas como raza, género, cultura, edad y discapacidad.

- Los futuros avances en la IA de propósito general podrían plantear riesgos sistémicos, incluida la interrupción del mercado laboral y desigualdades en el poder económico. Los expertos tienen diferentes opiniones sobre el riesgo de que la humanidad pierda el control sobre la IA de una manera que podría resultar en resultados catastróficos.

- Varios métodos técnicos (incluidas la evaluación comparativa, las pruebas de penetración y la auditoría de los datos de entrenamiento) pueden ayudar a mitigar los riesgos, aunque todos los métodos actuales tienen limitaciones y se requieren mejoras.

- El futuro de la IA es incierto, con una amplia gama de escenarios que parecen posibles. Las decisiones de las sociedades y los gobiernos tendrán un impacto significativo en su futuro.