Kaplan, Juliana. 2026. “AI Is Giving English Majors Some Unexpected Leverage in the Job Market.” Business Insider, 22 de febrero de 2026. https://www.businessinsider.com/ai-job-market-english-majors-humanities-demand-2026-2 (consultado el 23 de febrero de 2026).

La expansión de la inteligencia artificial (IA) en el entorno laboral está transformando profundamente el valor de distintas habilidades profesionales, y uno de los efectos más sorprendentes es el renovado interés por las titulaciones en humanidades, especialmente en inglés y áreas afines.

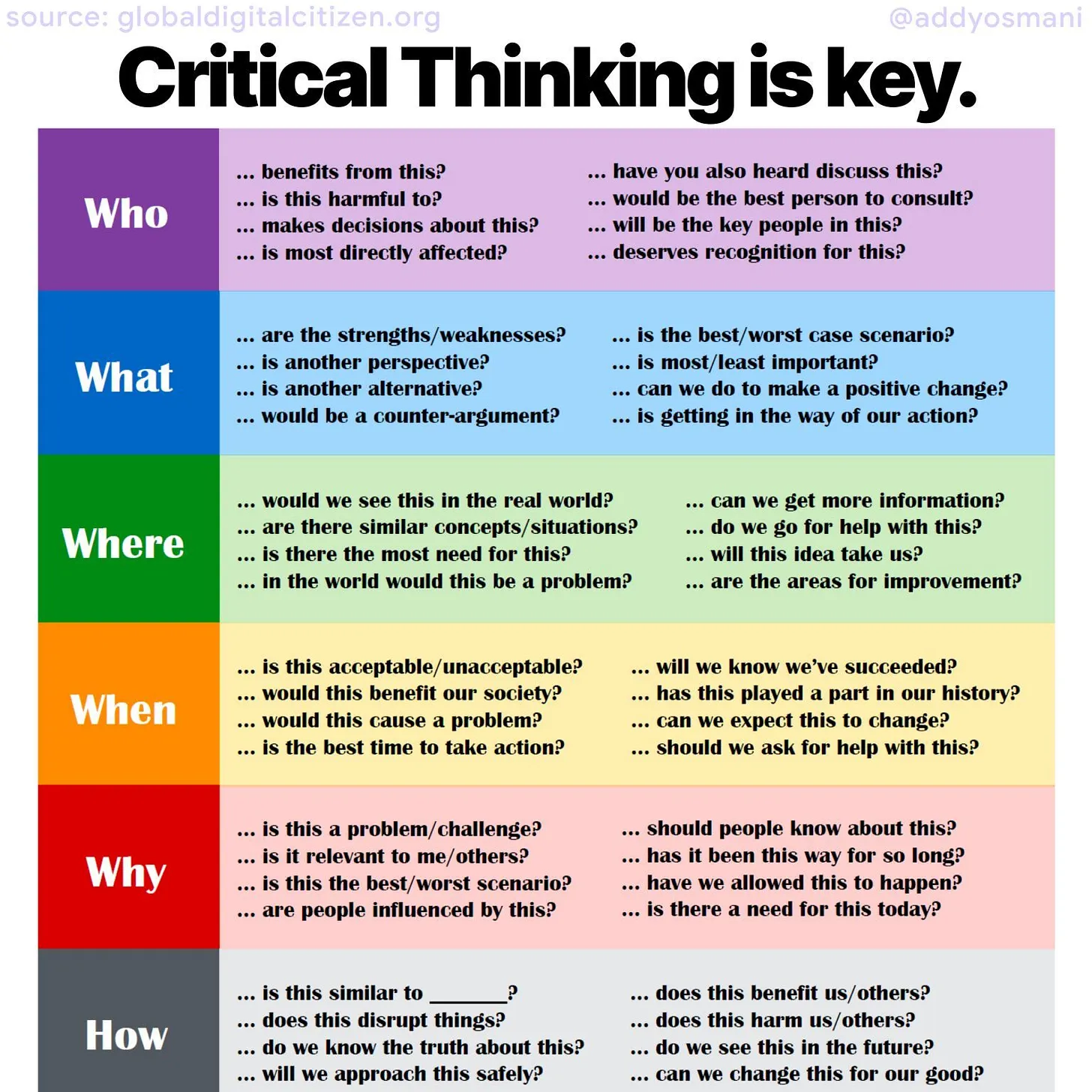

Tradicionalmente percibidos como menos prácticos frente a las disciplinas científicas y tecnológicas, los graduados en humanidades están empezando a experimentar una mayor demanda por parte de empleadores que buscan competencias que las máquinas no pueden replicar fácilmente. Entre estas se encuentran la comunicación compleja, la interpretación de textos, el pensamiento crítico y la creatividad, atributos que se han convertido en herramientas esenciales para gestionar y comprender los resultados generados por sistemas de IA avanzados.

En el ámbito académico, universidades como la de Colorado Boulder y Rice están observando una recuperación en el número de estudiantes interesados en programas de humanidades, tras años de declive. Este renacimiento se debe, en parte, al diseño de cursos interdisciplinarios que combinan estudios de humanidades con aspectos éticos, filosóficos y sociales de la IA. Por ejemplo, asignaturas que exploran cómo evaluar la escritura de una IA frente a la de un ser humano ayudan a cultivar una comprensión más profunda de la creatividad y el juicio interpretativo, reforzando así la relevancia de las humanidades en una economía cada vez más automatizada.

Desde la perspectiva del mercado laboral, expertos en selección y estrategia organizacional señalan que las “habilidades blandas” —como la empatía, la capacidad de contar historias y la comunicación intercultural— están adquiriendo un valor excepcional en un momento en que las máquinas dominan tareas técnicas repetitivas. En sectores pequeños e innovadores, estos atributos se traducen en ventajas competitivas en la gestión de equipos, la elaboración de narrativas de marca y la interacción con clientes y públicos diversos. Este fenómeno, descrito por algunos como la “venganza del graduado en inglés”, sugiere un cambio cultural importante: el reconocimiento de que el pensamiento humanístico es crucial para complementar las capacidades de la IA.

A pesar de estas tendencias prometedoras, el panorama laboral general sigue siendo desafiante para los graduados de humanidades, quienes tradicionalmente han enfrentado mayores tasas de desempleo que sus pares en campos técnicos. Aunque las oportunidades están aumentando, especialmente en empresas que valoran habilidades de comunicación y análisis contextual, no todas las organizaciones han adoptado plenamente esta visión. Sin embargo, la creciente inclusión de estudios sobre IA dentro de los programas de humanidades apunta a una adaptación estratégica de estos títulos tradicionales, preparándolos mejor para los roles híbridos que emergen en la economía digital.

En conjunto, la integración de la IA en los procesos productivos y creativos parece estar redefiniendo las competencias más valoradas en el mercado laboral. Mientras que las habilidades puramente técnicas siguen siendo importantes, la capacidad de pensar, comunicar y contextualizar información compleja se está revelando como un componente indispensable para navegar un mundo en el que las máquinas asumen cada vez más funciones mecánicas y repetitivas. Este cambio no solo beneficia a los graduados en humanidades, sino que también subraya la importancia de enfoques educativos más holísticos que integren conocimiento técnico y humanístico.