Bhosale, Uttkarsha. «ChatGPT’s Limitations in Research». Enago Academy (blog), 5 de junio de 2023. https://www.enago.com/academy/chatgpt-cannot-do-for-researchers-2/.

¿Puede ChatGPT competir realmente con la brillantez de las mentes humanas? Sólo puede imitar aquello para lo que ha sido entrenado, dejando la verdadera innovación fuera de la ecuación. Ninguna inteligencia artificial podrá sustituir a la experiencia humana en la investigación y la escritura académica.

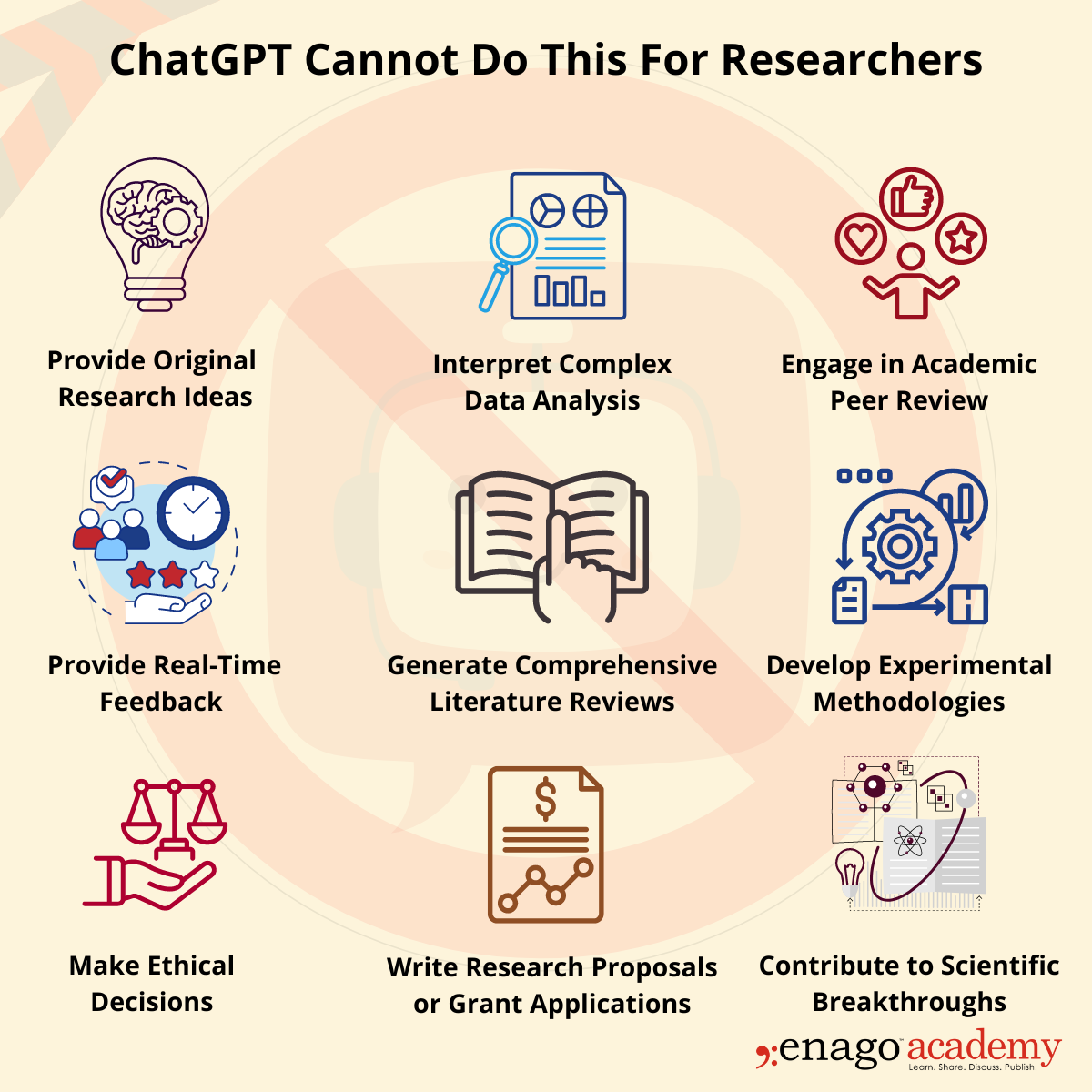

1- Aporte ideas de investigación originales

Las ideas originales de investigación son la savia del progreso científico. Impulsan la innovación, amplían el conocimiento y allanan el camino para descubrimientos revolucionarios. Sin embargo, generar estas ideas va más allá de las capacidades de ChatGPT.

2- Interpretar análisis de datos complejos

ChatGPT puede tener dificultades para comprender los matices y complejidades de estos enfoques analíticos. Los investigadores, por su parte, poseen los conocimientos y la experiencia necesarios para navegar a través del análisis de datos complejos, algo que ChatGPT no puede adquirir. Además, ChatGPT no puede identificar posibles sesgos, factores de confusión o valores atípicos que puedan afectar a la validez de los resultados.

3- Participar en la revisión académica por pares

ChatGPT carece de la capacidad de evaluar la calidad y validez de los trabajos de investigación, por lo que no es adecuado para la revisión académica por pares. Los modelos de IA como ChatGPT se entrenan con una gran cantidad de datos de texto y pueden generar respuestas basadas en patrones y conocimientos dentro de sus datos de entrenamiento. Sin embargo, no poseen la experiencia específica del dominio ni las habilidades de pensamiento crítico necesarias para una rigurosa revisión académica por pares.

4- Proporcionar información en tiempo real sobre el progreso de la investigación

Dada su falta de comprensión contextual, ChatGPT no puede proporcionar información en tiempo real sobre los proyectos de investigación en curso. ChatGPT puede no ser capaz de evaluar el progreso de la investigación, lo que requiere un profundo conocimiento del área de investigación específica, las metodologías empleadas y la literatura y marcos teóricos relevantes.

5- Generar revisiones bibliográficas exhaustivas

ChatGPT puede tener dificultades para evaluar la calidad y pertinencia de las fuentes, lo que limita su capacidad para generar reseñas bibliográficas exhaustivas. No puede examinar artículos de investigación, libros, ponencias y otras fuentes académicas por su metodología, análisis de datos, marcos teóricos y contribución al campo.

6- Redactar propuestas de investigación o solicitudes de subvención

Es posible que ChatGPT no comprenda del todo los matices de los requisitos de financiación, por lo que resulta inadecuado para redactar propuestas de investigación o solicitudes de subvención. No puede cumplir los requisitos de redacción de una subvención a medida e incluir detalles sobre los objetivos del proyecto de investigación, la metodología, los resultados esperados, el presupuesto, el calendario y la alineación con las prioridades del organismo de financiación.

7- Desarrollar nuevas metodologías experimentales

ChatGPT carece de la experiencia y los conocimientos específicos necesarios para desarrollar nuevas metodologías experimentales. Los investigadores poseen los conocimientos necesarios para identificar lagunas en la investigación, formular preguntas de investigación y diseñar experimentos a medida para abordar objetivos específicos. El desarrollo de nuevas metodologías experimentales suele requerir una combinación de creatividad, pensamiento crítico y capacidad para resolver problemas, algo que ChatGPT o cualquier otra herramienta de IA no pueden hacer en sus formas actuales.

8- Tomar decisiones éticas en la investigación

ChatGPT no está equipado para emitir juicios morales ni para navegar por los complejos dilemas éticos que pueden encontrar los investigadores. Los propios investigadores proporcionan el marco ético necesario para unas prácticas de investigación responsables y éticas. No está capacitado para comprender y aplicar los principios y directrices éticos específicos de su campo, como los que establecen los comités de revisión ética o los comités de revisión institucional (CEI).

9- Contribuir a los avances científicos

ChatGPT puede proporcionar apoyo y ofrecer ideas basadas en patrones en sus datos de entrenamiento; sin embargo, no puede conducir de forma independiente a avances científicos. Aunque ChatGPT puede ayudar a los investigadores ofreciéndoles información e ideas iniciales, carece de la intuición, la creatividad y el pensamiento innovador de los investigadores humanos.