Stuart, David. Have we reached the limits of altmetrics? | Research Information. (2024.). Recuperado 29 de junio de 2024,

Ver original

Las altmetrics han crecido en popularidad, pero la IA amenaza su legitimidad al facilitar la manipulación de métricas. A medida que la creación de contenido automatizado aumenta, la relevancia y precisión de las altmetrics se debilitan. Las métricas web deberán adaptarse para seguir siendo útiles en el futuro.

Es fascinante observar el crecimiento de las altmetrics y otras métricas web en los últimos 20 años. Han pasado de ser una curiosidad a estar integradas en las páginas web de las universidades y editoriales académicas más grandes del mundo. Los desarrollos tecnológicos, la estandarización y el creciente interés en métricas alternativas han llevado a que la información sobre el número de vistas o menciones en redes sociales de una publicación se destaque junto a otras métricas más establecidas.

Sin embargo, el éxito pasado no garantiza el crecimiento futuro, y la web está en constante cambio. El mayor disruptor de la web hoy en día es indudablemente la inteligencia artificial (IA), y aunque el impacto futuro completo de la IA es actualmente desconocido, surge la pregunta de si hemos llegado a los límites de las altmetrics.

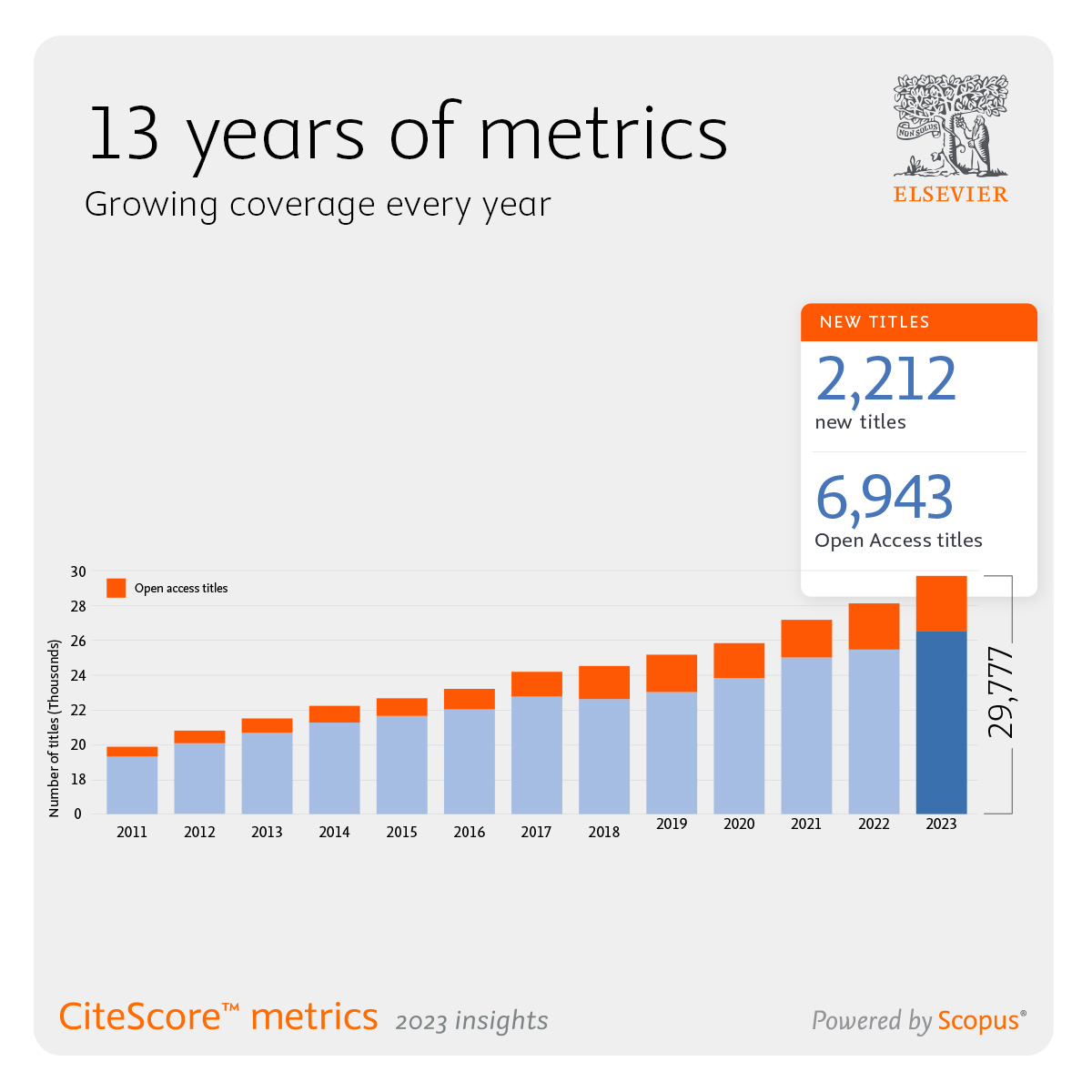

En un mundo que cambia rápidamente, las métricas apelan a la objetividad. Ya sea que se utilicen para evaluación, motivación o celebración, ofrecen la promesa de algo más sólido que una simple opinión individual. Durante mucho tiempo, en la publicación académica, las métricas dominantes se basaron en citas. A pesar de que se reconocen las limitaciones del análisis de citas, se siente que al agregar y normalizar citas de diferentes maneras, se puede indicar algo de valor.

El cambio a la publicación en línea aumentó considerablemente las métricas disponibles. La rica variedad de datos en tiempo real sobre el uso de una publicación y el surgimiento de altmetrics de las redes sociales prometieron proporcionar una comprensión más rápida y matizada del impacto de la investigación, más allá del ámbito académico y de las publicaciones formales. Sin embargo, las publicaciones informales son más susceptibles a la manipulación que las formales, y parece que justo cuando las altmetrics comienzan a ganar mayor aceptación, su legitimidad podría verse socavada. Hasta ahora, los problemas de manipulación han sido mínimos, pero con la IA, existe el riesgo de que estas métricas informales se vuelvan rápidamente insignificantes.

La IA incrementa tanto el riesgo de manipulación deliberada de métricas como el ruido general en el sistema de publicaciones académicas. Todas las métricas están abiertas a la manipulación, y es inevitable que individuos y organizaciones actúen de manera que logren la impresión más favorable. Como establece la ley económica de Goodhart: “Cuando una medida se convierte en un objetivo, deja de ser una buena medida”. Aunque las consecuencias negativas de las métricas en la publicación académica pueden no ser tan evidentes como cuando un médico solo quiere atender a pacientes con resultados favorables, o la policía solo registra delitos que son fáciles de resolver, el énfasis excesivo en las métricas corre el riesgo de socavar el sistema. El problema de las fábricas de artículos de investigación, que producen artículos que luego son retractados, ha crecido recientemente, y es probable que el problema aumente a medida que las mejoras en la IA generativa hagan cada vez más difícil identificar dichos artículos. En la publicación académica, sin embargo, todavía hay muchos controles humanos, pocos de los cuales se aplican a las altmetrics.

La historia de las métricas web ha sido tanto de la creciente facilidad con la que se pueden recopilar como de la facilidad con la que se pueden manipular. Hace casi 20 años, la unidad de elección para contar era el hipervínculo. Aunque cualquiera podría haber creado múltiples sitios web con diferentes dominios para aumentar el impacto de su presencia en línea, el costo en tiempo y dinero, y el poco interés en las métricas web en la comunidad académica, significaba que la mayoría de las personas preferían dedicar su tiempo a crear mejores publicaciones académicas. La estandarización de los grandes sitios de redes sociales, sin embargo, proporcionó tanto mayor interés en las métricas web como una menor barrera para crear un impacto en línea. Ya no era necesario crear múltiples sitios web, solo diferentes perfiles en múltiples plataformas de redes sociales. El costo, en su mayoría, se había reducido a cero, todo lo que se necesitaba era tiempo. Con la IA, sin embargo, el tiempo involucrado también puede reducirse a cero, al menos después de la configuración inicial.

No es difícil imaginar un futuro cercano en el que, si se desea generar cientos o incluso miles de cuentas de microblogging para elogiar la calidad de una investigación, simplemente se puede pedir a un programa de IA generativa que lo haga. No será necesario curar cuidadosamente la imagen de cada cuenta para distinguirlas de los spambots, ya que el contenido se generará automáticamente. Puede resultar un poco molesto descubrir que los insights artificiales ganan más seguidores que los posts cuidadosamente curados, pero el rápido aumento de la puntuación de atención sin duda aliviará el dolor.

No todo el ruido será deliberado. A medida que el contenido se crea automáticamente, la idea de que las piezas de contenido pueden contarse como si cada una hubiera sido creada por un ser humano se volverá cada vez más defectuosa. Proporciones crecientes de la web ya vienen con una advertencia de que «esta página ha sido creada automáticamente con la ayuda de IA», y estas secciones inevitablemente crecerán más rápido que las creadas por humanos. A medida que la creación de contenido se basa cada vez más en otro contenido que ya ha sido creado, la ventaja de ser el primer artículo mencionado sobre un tema será cada vez más difícil de superar.

Con una distribución de atención cada vez más sesgada, también se vuelve cada vez más importante asegurarse de que las menciones se asocien con el documento académico correcto. La mala atribución de menciones académicas y las fluctuaciones resultantes en las métricas solo aumentarán a medida que se genere más contenido automáticamente.

A primera vista, parecería que el uso creciente de la IA generativa inevitablemente anunciará el fin de las altmetrics, pero eso solo si todo lo demás permanece igual. Sin duda, no será así. Los sitios y servicios de redes sociales también cambiarán de muchas maneras. Es posible que los sitios de redes sociales gratuitos sean reemplazados por servicios de suscripción o distribuidos, donde haya mayores restricciones en la generación de contenido, permitiendo que formen la base de nuevas y más robustas métricas. El interés en el impacto académico en un servicio genérico como X podría ser reemplazado por el interés en cuentas verificadas o en servidores seleccionados que formen parte de una red distribuida.

También parece probable que se amplíe el interés en las métricas web más allá de las altmetrics. Se puede obtener una amplia gama de insights de la web, o de rincones de la misma, desde el análisis de las actividades de búsqueda de las personas en Google Trends para conocer el estado de la sociedad hasta cómo el enlace entre sitios web proporciona información sobre las relaciones en el mundo real y la robustez de una economía local. Sin embargo, estas alternativas a menudo han sido marginadas con un enfoque en las métricas evaluativas a gran escala.

Las métricas web siempre han tenido que adaptarse a medida que surgían nuevas tecnologías. Aunque la IA indudablemente marcará el fin de una era de las altmetrics, surgirán nuevas áreas de investigación. La inclusión de literatura gris y citas de patentes que anteriormente se habrían excluido de la bibliometría probablemente continuará, pero la idea de capturar contenido informal a gran escala puede ser cada vez más dudosa.

Las métricas web siempre han tenido fundamentos más suaves que las bibliométricas, más propensas a ofrecer insights interesantes que autoritativos, y no es necesariamente malo que eso sea hasta donde lleguen. Las métricas evaluativas a menudo tienen un impacto negativo, especialmente cuando se les da demasiada credibilidad, por lo que limitar las altmetrics justo cuando están ganando interés no es necesariamente algo negativo.