Deezer. “Up to 70% of Streams of AI-Generated Music on Deezer Are Fraudulent, Says Report.” The Guardian, 18 junio 2025

Siete de cada diez reproducciones de música generada por inteligencia artificial en la plataforma Deezer son fraudulentas, según la plataforma francesa de streaming.

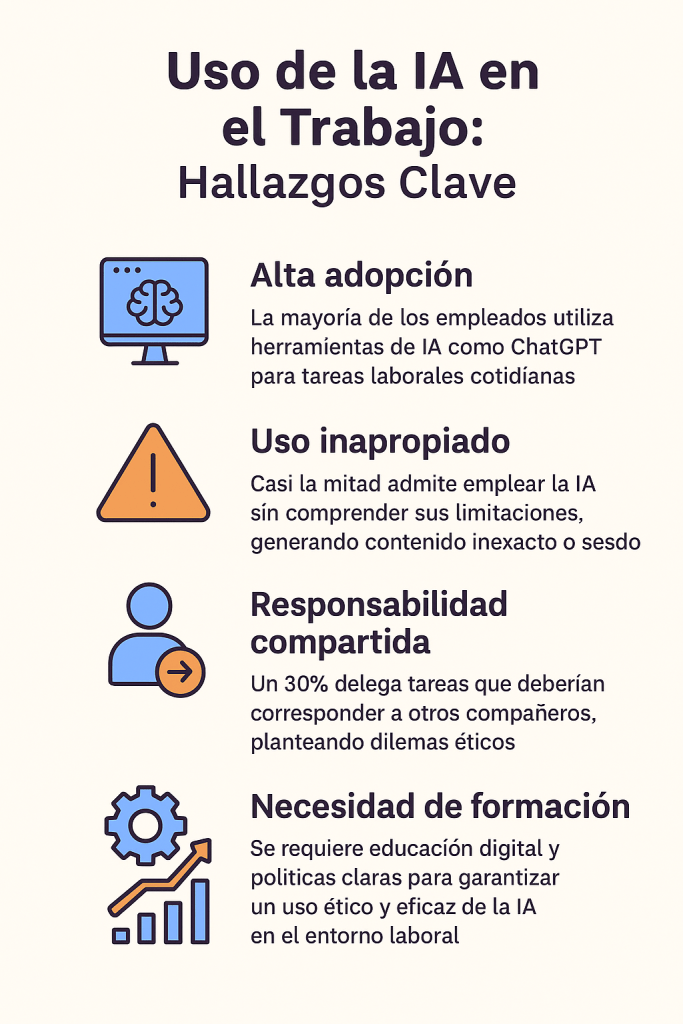

Un informe reciente de Deezer advierte que hasta el 70 % de las reproducciones de canciones generadas íntegramente por inteligencia artificial (IA) en la plataforma son fraudulentas. Estas escuchas corresponden a bots u otras formas de manipulación destinadas a inflar las cifras y obtener regalías de manera indebida. Aunque las pistas creadas con IA suponen apenas el 0,5 % del total de reproducciones, su presencia es mucho más significativa en el volumen de cargas diarias: alrededor de 20.000 temas al día, lo que representa el 18 % de todas las canciones subidas.

Para hacer frente a esta situación, Deezer asegura disponer de herramientas capaces de identificar con total precisión los contenidos producidos por modelos como Suno y Udio. Los temas detectados como totalmente artificiales se etiquetan de forma explícita, quedan fuera de las recomendaciones algorítmicas y de las listas editoriales, y además, las reproducciones fraudulentas que generan no se contabilizan para el pago de regalías.

Deezer afirmó que la música generada por IA que los estafadores transmitían iba desde pop y rap falsos hasta pistas musicales artificiales que estimulaban el estado de ánimo. La plataforma ha decidido bloquear el pago de regalías por las reproducciones que ha identificado como fraudulentas.

En su último informe global sobre música, la IFPI afirmó que el streaming fraudulento roba dinero que «debería destinarse a artistas legítimos». Añadió que la IA generativa había «exacerbado significativamente» el problema.

El año pasado, el músico estadounidense Michael Smith fue acusado en relación con un plan para crear cientos de miles de canciones generadas por IA y reproducirlas miles de millones de veces, obteniendo 10 millones de dólares en regalías.

Según Thibault Roucou, director de regalías de la compañía, muchas de estas canciones creadas de manera automática carecen de una verdadera motivación artística y responden únicamente al ánimo de lucro mediante la manipulación del sistema.