Dolechek, Melanie. “AI in Scholarly Publishing — SSP Pulse Check Report.” The Scholarly Kitchen (blog), 9 de enero de 2026. https://scholarlykitchen.sspnet.org/2026/01/09/ai-in-scholarly-publishing-ssp-pulse-check-report/

El objetivo del informe es explorar cómo las organizaciones del ámbito de la publicación académica están adoptando y respondiendo a la inteligencia artificial (IA). La encuesta, realizada entre el 1 y el 12 de diciembre de 2025 entre 563 profesionales de distintas organizaciones, revela que la IA ya está muy presente en los flujos de trabajo de la publicación académica, aplicándose principalmente en tareas relacionadas con la creación y resumen de contenidos, revisión de integridad y detección de plagio, así como en herramientas de accesibilidad y descubrimiento de contenidos.

A pesar de esta adopción generalizada, el informe subraya que la preparación institucional para gestionar el impacto de la IA sigue rezagada respecto al uso tecnológico. La mayoría de las organizaciones se encuentran en un estado de preparación parcial, con políticas, capacidades y conocimientos aún en desarrollo, lo que refleja que el entusiasmo por la IA va acompañado de incertidumbre y retos organizativos. Entre los principales obstáculos se encuentran preocupaciones éticas y legales, problemas de privacidad y seguridad de datos, y una insuficiente capacidad especializada dentro de los equipos.

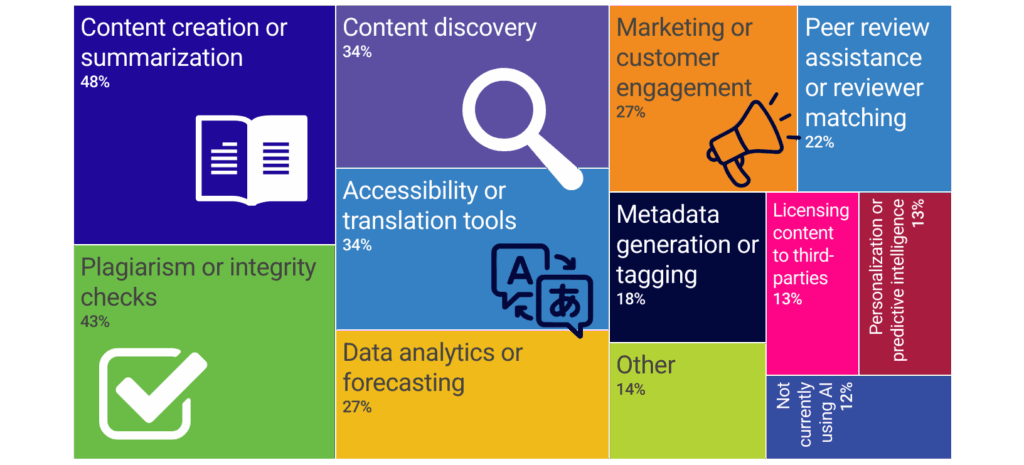

Las respuestas a la encuesta muestran que la adopción de IA ya está en marcha en las organizaciones de publicación académica, y la gran mayoría reporta al menos un caso de uso activo. Las aplicaciones más comunes se centran en los flujos de trabajo relacionados con el contenido, particularmente la creación o resumen de contenido (48%) y la verificación de plagio o integridad de la investigación (43%). Estos usos reflejan áreas donde la IA puede ofrecer ganancias inmediatas de eficiencia y ampliar el soporte a los procesos editoriales existentes sin alterar fundamentalmente la autoridad en la toma de decisiones.

Las herramientas de accesibilidad y traducción (34%) y el descubrimiento de contenido (34%) también son muy relevantes, subrayando el papel creciente de la IA en mejorar el alcance, la usabilidad y la encontrabilidad del contenido académico.

Más allá de las funciones editoriales principales, las organizaciones aplican cada vez más la IA a actividades empresariales y operativas. Más de una cuarta parte de los encuestados informa que utiliza IA para marketing o interacción con clientes (27%) y para análisis de datos o previsiones (27%), lo que indica una mayor comodidad con los conocimientos generados por IA para informar estrategias y alcance de la audiencia. La asistencia en la revisión por pares o la asignación de revisores (22%) y la generación o etiquetado de metadatos (18%) aparecen como aplicaciones emergentes, pero aún no universales, lo que sugiere tanto oportunidad como cautela en áreas que interfieren más directamente con el juicio académico y el control de calidad.

De acuerdo con los datos mostrados, las categorías con mayor peso son:

- Creación o resumen de contenido: Es la aplicación más destacada con un 48%.

- Controles de plagio o integridad: Ocupa el segundo lugar con un 43%.

- Descubrimiento de contenido: Representa un 34%.

- Herramientas de accesibilidad o traducción: Empata con el descubrimiento de contenido con un 34%.

- Marketing o compromiso del cliente: 27%.

- Análisis de datos o pronósticos: 27%.

- Asistencia en revisión por pares o emparejamiento de revisores: 22%.

- Generación de metadatos o etiquetado: 18%.

- Licencia de contenido a terceros: 13%.

- Personalización o inteligencia predictiva: 13%.

- Finalmente, la imagen indica que un 14% corresponde a otros usos y un 12% de los consultados no utiliza IA actualmente.

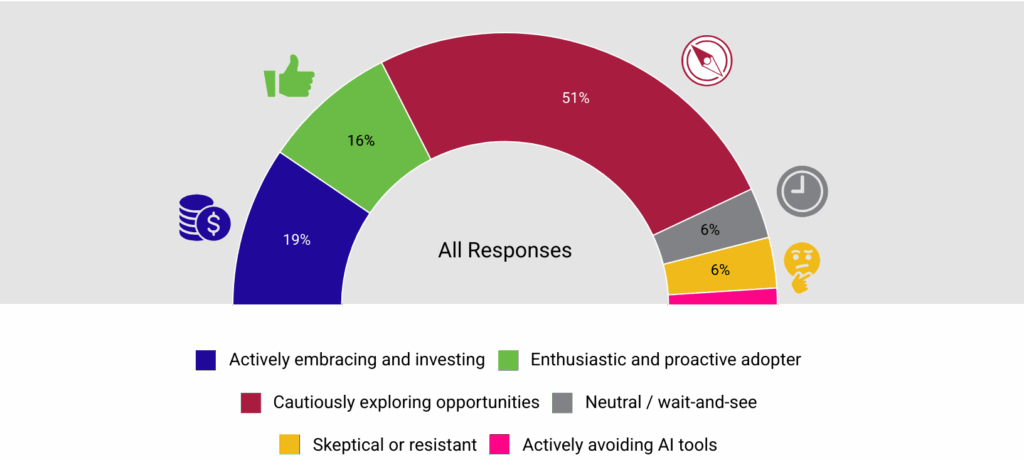

Actitudes hacia la IA

Las respuestas indican que la mayoría de las organizaciones abordan la IA con interés medido, más que con entusiasmo incondicional. La mayoría (51%) describe su postura como exploración cautelosa de oportunidades, lo que sugiere experimentación activa junto con consideración cuidadosa de riesgos, gobernanza y adecuación. Al mismo tiempo, más de un tercio de los encuestados muestra una postura fuertemente positiva hacia la IA: 19% adopta activamente e invierte en IA y 16% se identifica como adoptante entusiasta y proactivo — juntos indican un impulso significativo hacia una integración más profunda.

Solo una pequeña minoría permanece al margen o en contra. Solo el 6% reporta una postura neutral de esperar y ver, otro 6% se declara escéptico o resistente, y solo 2% evita activamente las herramientas de IA. En conjunto, estos resultados sugieren que, aunque la cautela sigue siendo dominante, la resistencia a la IA en la publicación académica es limitada y la trayectoria general apunta hacia una adopción más amplia con el tiempo.

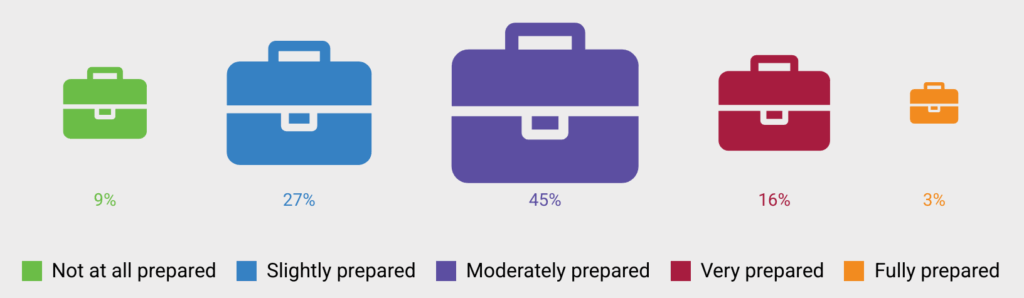

Preparación ante la IA

Las respuestas sugieren que la mayoría de las organizaciones se sienten parcialmente preparadas para enfrentar el impacto de la IA en el próximo año. Casi la mitad (45%) reporta estar moderadamente preparada, mientras otro 27% se siente solo ligeramente preparada, lo que indica que muchas organizaciones todavía están construyendo habilidades, políticas y confianza interna. Un porcentaje menor se siente altamente preparado: 16% se describe como muy preparado y solo 3% como completamente preparado, lo que subraya lo rara que sigue siendo la sensación de preparación total. Al mismo tiempo, 9% reporta no estar preparado en absoluto, destacando la necesidad de orientación, buenas prácticas compartidas y desarrollo de capacidades en toda la comunidad.

El sondeo también identifica oportunidades importantes asociadas con la IA, entre ellas la eficiencia de los flujos de trabajo —que puede liberar tiempo para tareas de mayor valor añadido—, el fortalecimiento de la revisión por pares mediante herramientas de apoyo o asignación de revisores, y el uso de IA para reforzar la integridad y calidad de la investigación a través de la detección de plagio o de prácticas poco éticas. Asimismo, la IA se percibe como una herramienta valiosa para mejorar la descubribilidad del contenido científico y para apoyar a autores de distintas lenguas mediante traducción y servicios lingüísticos.

Barreras para la adopción de IA

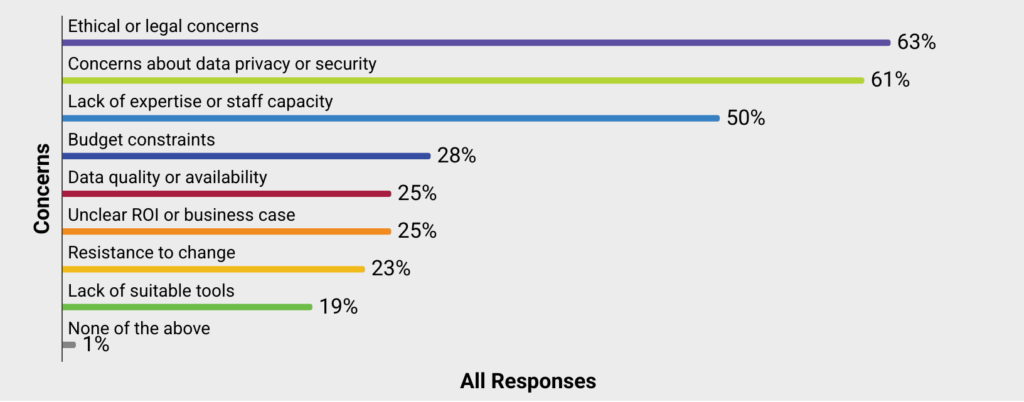

Los encuestados identificaron preocupaciones legales/éticas, privacidad/seguridad y falta de experiencia/capacidad como las principales barreras para la adopción de IA.

A pesar de los altos niveles de adopción e interés en IA, las organizaciones de publicación académica todavía albergan serias preocupaciones sobre su uso en el sector. Las preocupaciones éticas o legales (63%) y los problemas de privacidad o seguridad de los datos (61%) encabezan la lista, reflejando cautela generalizada respecto a cumplimiento, propiedad intelectual y uso responsable — preocupaciones especialmente agudas en la publicación académica. La preparación organizacional también emerge como un desafío significativo, con la mitad de los encuestados (50%) citando la falta de experiencia o capacidad del personal, lo que subraya que las capacidades humanas e institucionales a menudo quedan detrás del interés tecnológico.

Consideraciones prácticas y financieras forman un segundo nivel de barreras. Restricciones presupuestarias (28%), calidad o disponibilidad de datos (25%) y un ROI o caso de negocio poco claros (25%) sugieren que muchas organizaciones todavía evalúan costos frente a beneficios inciertos. Los problemas culturales y de herramientas —como la resistencia al cambio (23%) y la falta de herramientas adecuadas (19%)— son menos dominantes pero todavía significativos. Casi todas las organizaciones reportan algún tipo de fricción al adoptar IA.

No obstante, las preocupaciones sobre los riesgos son profundas y existenciales. Muchos encuestados expresan inquietudes sobre la posibilidad de que la IA degrade la calidad y la integridad de la literatura académica, dificultando la detección de contenidos generados por IA sin rigor científico, y erosionando la confianza en el proceso de revisión por pares tradicional. También existe ansiedad sobre la falta de transparencia en el uso de IA y la autenticidad de las contribuciones cuando las herramientas automatizadas participan en la producción o evaluación de trabajos. En conjunto, estas respuestas reflejan una comunidad editorial que navega entre la oportunidad de mejorar procesos y la necesidad de proteger los valores fundamentales de la comunicación científica.