Kousha, Kayvan, and Mike Thelwall. “How Much Are LLMs Changing the Language of Academic Papers after ChatGPT? A Multi-Database and Full Text Analysis.” arXiv (September 2025). https://arxiv.org/abs/2509.09596

El artículo analiza cómo los modelos de lenguaje grande (LLMs), en particular tras la aparición pública de ChatGPT, están influyendo en el estilo lingüístico de los artículos académicos.

Para ello, los autores se centran en doce términos muy característicos de los textos generados o corregidos con LLMs —como delve, underscore, intricate o meticulous— y estudian su evolución en seis grandes bases de datos: Scopus, Web of Science, PubMed, PubMed Central (PMC), Dimensions y OpenAlex. Además, aplican un análisis exhaustivo a más de 2,4 millones de artículos de PMC publicados entre 2021 y mediados de 2025.

Los resultados muestran un crecimiento espectacular en la frecuencia de estos términos tras la popularización de ChatGPT. Por ejemplo, entre 2022 y 2024, delve aumentó cerca de un 1500 %, underscore un 1000 % e intricate un 700 %. En los textos completos de PMC, el uso de underscore seis o más veces en un artículo se disparó más de un 10.000 % entre 2022 y 2025. También destacan los aumentos de intricate (≈ 5400 %) y meticulous (≈ 2800 %).

El fenómeno no afecta de igual manera a todas las disciplinas. El crecimiento es mucho mayor en áreas STEM (Ciencia, Tecnología, Ingeniería y Matemáticas) que en Ciencias Sociales o en Artes y Humanidades. Asimismo, los autores detectan que la co-ocurrencia de estos términos es cada vez más fuerte: artículos que emplean underscore tienden también a incluir con mayor frecuencia pivotal o delve, mostrando correlaciones que en 2022 eran casi inexistentes.

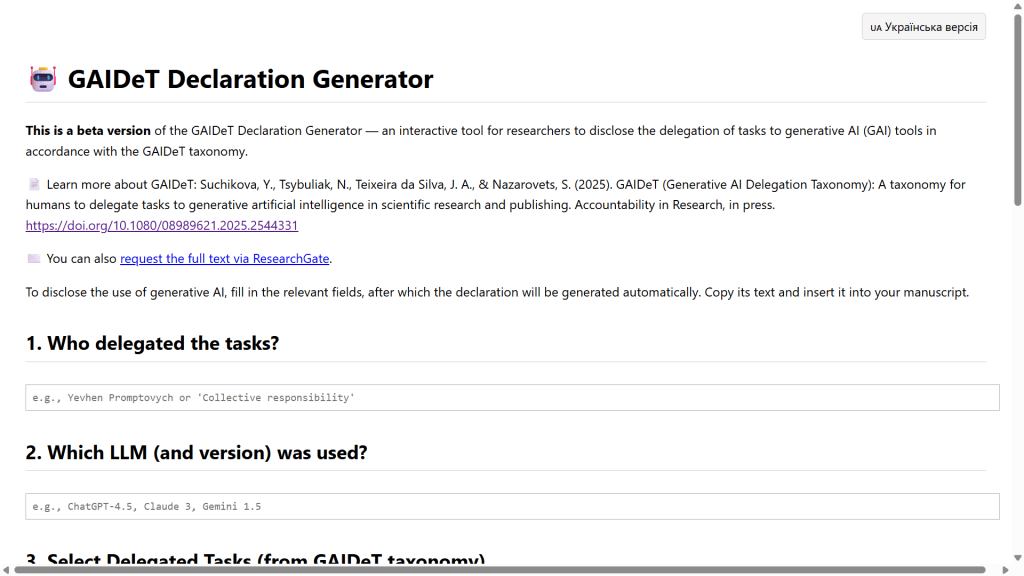

Se evidencia que la influencia de ChatGPT y otros LLMs se percibe claramente en el lenguaje académico, no solo en la frecuencia de ciertos términos, sino también en un estilo más uniforme y “pulido”. Este fenómeno puede ayudar a investigadores no nativos en inglés a acercarse a los estándares de redacción científica, reduciendo barreras lingüísticas en la publicación internacional. Sin embargo, también plantean interrogantes sobre el riesgo de homogeneización, exceso de artificio o pérdida de diversidad estilística en la escritura académica.