Webber, Gerald. “The Future of AI Literacy: Why Everyone Needs to Understand Artificial Intelligence.” Page One Power, September 26, 2025. https://pageonepower.com

La inteligencia artificial (IA) ha dejado de ser exclusiva de laboratorios o industrias especializadas y se ha integrado en aulas, lugares de trabajo e interacciones cotidianas. Al igual que la alfabetización digital se volvió esencial en la era de Internet, la alfabetización en IA está emergiendo como una competencia fundamental para estudiantes, profesionales y comunidades. Ser competente en IA no se limita a usar chatbots o aplicaciones; implica comprender lo que la IA puede y no puede hacer, cómo aplicarla de manera responsable, cuestionar sus resultados y reconocer sus riesgos sin depender excesivamente de ella, todo ello sin necesidad de saber programar.

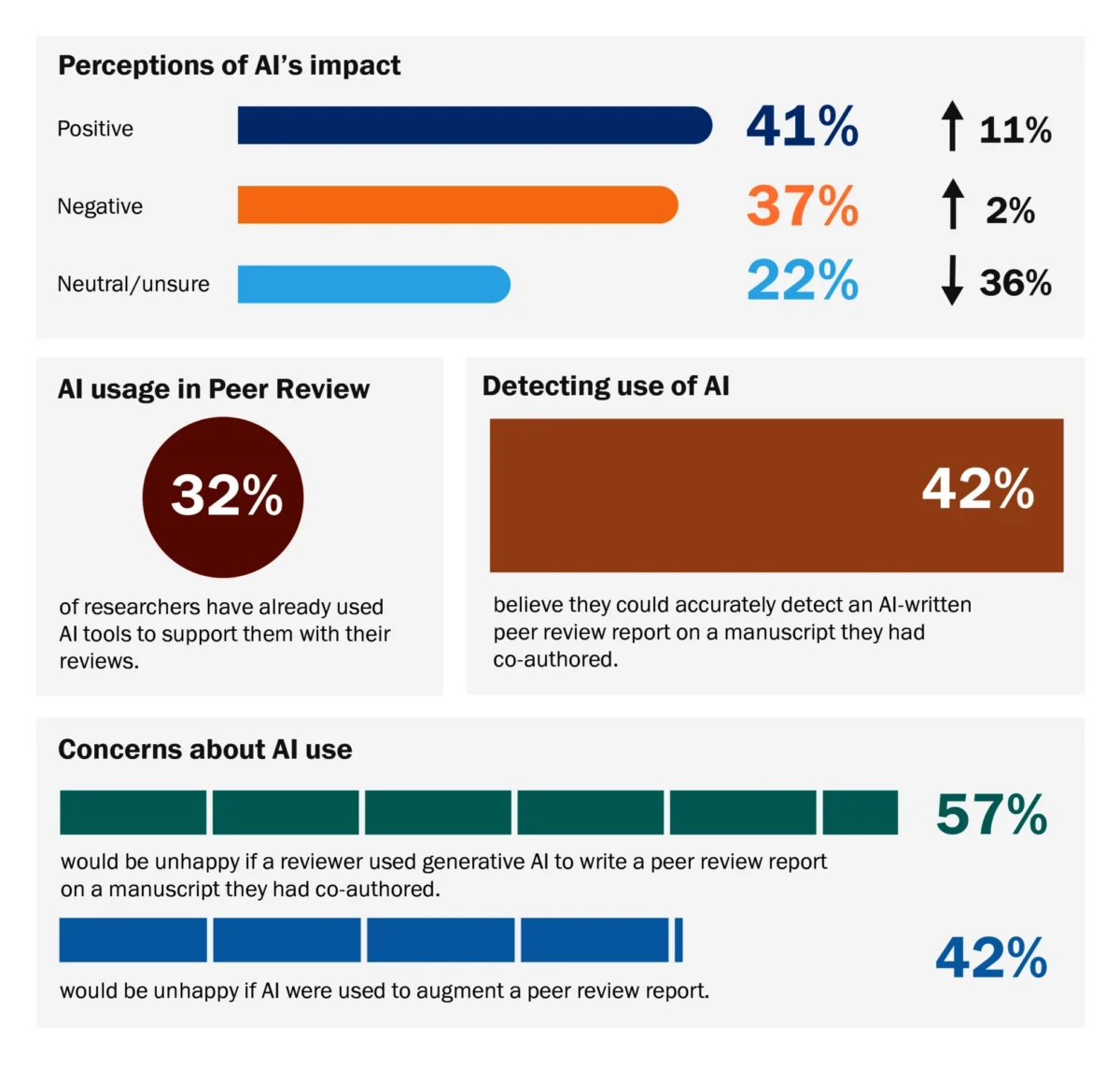

Las percepciones sobre la IA varían según la generación. Estudios recientes muestran que los jóvenes son más propensos a experimentar con herramientas de IA, mientras que los grupos mayores manifiestan cautela, preocupados por la confianza, la privacidad y las consecuencias a largo plazo. Estas diferencias afectan la aceptación de la IA en entornos educativos, laborales y en la formulación de políticas.

Para los estudiantes, la alfabetización en IA es esencial, ya que esta tecnología ya respalda la investigación, la tutoría y la colaboración. Quienes la dominan estarán mejor preparados para carreras donde el uso de herramientas de IA es habitual, al igual que la alfabetización informática benefició a generaciones anteriores. UNESCO destaca que desarrollar competencias en IA dentro de la educación contribuye a mejorar habilidades de resolución de problemas y conciencia ética.

En el ámbito laboral, empleados y líderes deben comprender la IA para adaptarse a nuevas formas de resolver problemas y tomar decisiones más informadas. La inteligencia artificial está transformando prácticas de ingeniería y gestión, aumentando la eficiencia y ampliando las estrategias de resolución de problemas. La comprensión de sus beneficios y limitaciones permite un uso responsable y reduce riesgos de malaplicación.

La alfabetización en IA también ayuda a proteger contra su uso indebido, incluyendo la desinformación y violaciones de privacidad. Comprender cómo funcionan estos sistemas permite identificar problemas, hacer preguntas críticas y responsabilizar a las organizaciones sobre su aplicación. Además, es crucial reconocer los sesgos inherentes en los datos que alimentan la IA, que pueden generar resultados injustos o engañosos. La conciencia de estos sesgos fomenta la equidad y la confianza en el uso de la tecnología. Encuestas, como la de Pew Research Center, muestran que un alto porcentaje de adultos en EE. UU. desea tener más control sobre el uso de la IA y comparte preocupaciones sobre los sesgos en sus decisiones.

A nivel nacional e internacional, la alfabetización en IA representa una ventaja competitiva. Los países que invierten en educación sobre IA preparan a sus ciudadanos para adaptarse, innovar y contribuir al crecimiento económico sostenido. La falta de estas habilidades podría dejar rezagados tanto a individuos como a naciones en la carrera global por el liderazgo tecnológico.