Lo, Leo S. «AI Policies across the Globe: Implications and Recommendations for Libraries». IFLA Journal, 27 de agosto de 2023, 03400352231196172. https://doi.org/10.1177/03400352231196172.

Este artículo analiza las políticas sobre inteligencia artificial propuestas en EE.UU., Reino Unido, Unión Europea, Canadá y China, y sus implicaciones para las bibliotecas. A medida que la inteligencia artificial revoluciona el funcionamiento de las bibliotecas, plantea retos complejos, como dilemas éticos, problemas de privacidad de los datos y cuestiones de acceso equitativo. El artículo destaca temas clave de estas políticas, como la ética, la transparencia, el equilibrio entre innovación y regulación y la privacidad de los datos. También identifica áreas de mejora, como la necesidad de directrices específicas sobre la mitigación de sesgos en los sistemas de inteligencia artificial y la navegación por las cuestiones de privacidad de datos. El artículo ofrece además recomendaciones prácticas para que las bibliotecas se comprometan con estas políticas y desarrollen mejores prácticas para el uso de la inteligencia artificial. El estudio subraya la necesidad de que las bibliotecas no sólo se adapten a estas políticas, sino que se comprometan activamente con ellas, contribuyendo al desarrollo de una gobernanza de la inteligencia artificial más completa y eficaz.

Introduction

La inteligencia artificial (IA) está revolucionando el funcionamiento de las bibliotecas, ofreciendo nuevas vías para las recomendaciones personalizadas, la investigación avanzada y la eficiencia operativa. Sin embargo, el rápido avance de la IA también plantea retos complejos, como dilemas éticos, problemas de privacidad de los datos y cuestiones de acceso equitativo. Por ello, las políticas y normativas sobre IA propuestas por EE.UU., Reino Unido, la Unión Europea, Canadá y China no sólo proporcionan un marco crucial para afrontar estos retos, sino que también revelan áreas de crítica que deben abordarse.

El «Blueprint for an AI bill of rights» de EE.UU. (Office of Science and Technology Policy, 2022), Reino Unido “A pro-innovation approach to AI regulation” (Secretary of State for Science, Innovation and Technology, 2023), Ley de Inteligencia Artificial de la Unión Europea (European Commission, 2021), a Ley de Inteligencia Artificial y Datos de Canadá (Government of Canada, 2023), y las «Medidas para la gestión de los servicios de inteligencia artificial generativa» de China (Webster, 2023) representan cada una un paso significativo para abordar las implicaciones éticas de la IA y garantizar un acceso equitativo a las oportunidades. Estas políticas ponen de relieve temas clave, como la ética, la transparencia, el equilibrio entre innovación y regulación, la privacidad de los datos y la naturaleza del panorama normativo. Sin embargo, también revelan áreas de crítica que deben abordarse, incluida la necesidad de directrices específicas sobre la mitigación de los sesgos en los sistemas de IA, la navegación por las cuestiones de privacidad de datos y la determinación del nivel de riesgo asociado con un sistema de IA en particular.

Aunque muchos otros países también han desarrollado o están desarrollando sus propias políticas u hojas de ruta en materia de IA (OCDE.AI, s.f.), se seleccionaron estas cinco políticas propuestas por varias razones:

- Influencia mundial: EE.UU., Reino Unido, la Unión Europea, Canadá y China son actores importantes en el panorama mundial de la IA. Es probable que sus políticas tengan un impacto sustancial en las normas y prácticas mundiales de IA, influyendo en la dirección del desarrollo y la regulación de la IA en todo el mundo.

- Diversidad de enfoques: las políticas seleccionadas representan una variedad de enfoques de la regulación de la IA, desde el enfoque más laissez-faire y centrado en la innovación del Reino Unido hasta el enfoque exhaustivo y basado en el riesgo de la Unión Europea. Esta diversidad permite una comparación y un análisis más sólidos de las distintas estrategias reguladoras.

- Relevancia para las bibliotecas: cada una de estas políticas tiene implicaciones significativas para las bibliotecas, un aspecto clave de este artículo. Al examinar estas políticas, podemos hacernos una idea de los posibles retos y oportunidades a los que pueden enfrentarse las bibliotecas en la era de la IA.

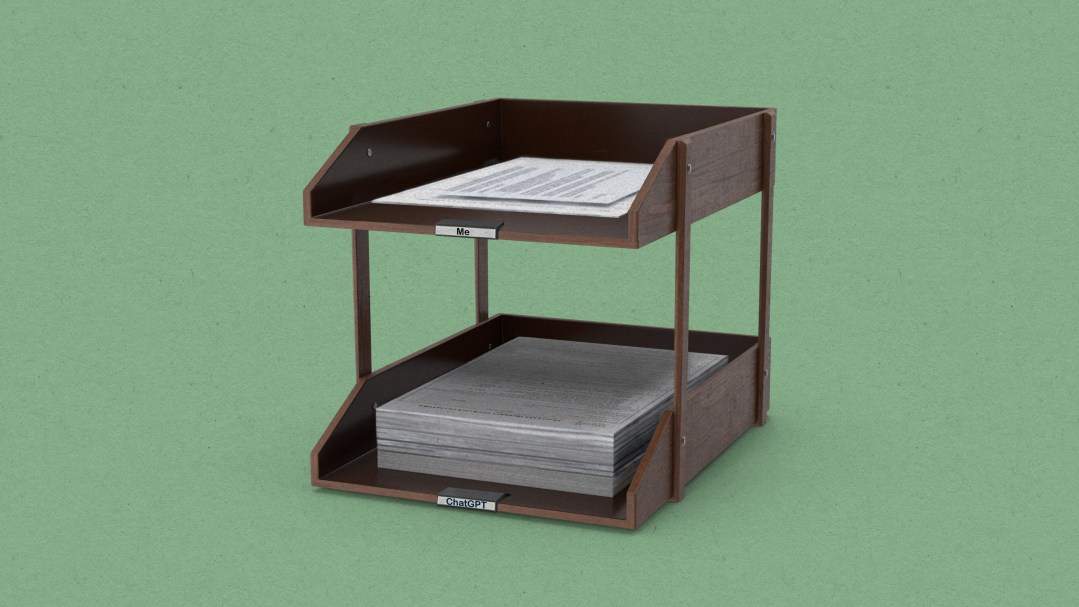

A medida que las bibliotecas aprovechan progresivamente el poder de la IA para aumentar sus servicios y operaciones -incluido el uso de chatbots para los servicios de referencia (Ehrenpreis and DeLooper, 2022), la indexación y clasificación automatizada de materias (National Library of Finland, n.d.) y los repositorios institucionales mejorados con aprendizaje automático (Yelton, n.d.)-, es imperativo que no solo se adapten a las políticas de IA imperantes, sino que también se comprometan proactivamente con ellas. Este compromiso implica la participación activa en el discurso en curso en torno a la gobernanza de la IA, la defensa de políticas que aborden de manera integral sus necesidades y desafíos únicos, y el desarrollo de mejores prácticas para la utilización de la IA que estén en consonancia con su misión y valores. A medida que el panorama de la IA evoluciona rápidamente, las políticas y prácticas de las bibliotecas deben adaptarse y evolucionar al mismo tiempo.

Estas políticas subrayan temas clave, como la ética, la transparencia, el equilibrio entre innovación y regulación, la privacidad de los datos y la naturaleza del panorama normativo. Sin embargo, también exponen áreas que deben seguir explorándose y mejorándose, incluida la necesidad de directrices explícitas sobre la mitigación de los sesgos en los sistemas de IA, el tratamiento de las preocupaciones sobre la privacidad de los datos y la evaluación del nivel de riesgo asociado a sistemas específicos de IA.

Es crucial reconocer que estas cinco políticas de IA, en el momento de redactar este documento, se encuentran en fase de propuesta y desarrollo, y aún no se han codificado como ley. Sus versiones finales pueden desviarse significativamente de sus formas actuales, lo que pone de relieve la naturaleza dinámica del panorama político de la IA. Esta fluidez exige que las bibliotecas permanezcan vigilantes y receptivas a estos desarrollos en evolución. A medida que estas políticas maduren y puedan convertirse en leyes, las bibliotecas tendrán que ajustar sus prácticas para garantizar el cumplimiento de las normativas más recientes, sin dejar de utilizar la IA para aumentar sus servicios y operaciones.

Más allá de estas recomendaciones, las bibliotecas también deberían contemplar el papel de la alfabetización en IA dentro de sus servicios. Las bibliotecas pueden desempeñar un papel fundamental en el fomento de la alfabetización en IA entre el público en general, promoviendo la transparencia, creando una demanda de responsabilidad y fomentando un compromiso crítico con las decisiones sobre IA. Las bibliotecas también pueden implementar medidas para salvaguardar los datos de los usuarios en el contexto de la IA, como garantizar que cualquier experimento con aplicaciones de IA que modifiquen o impulsen el comportamiento de los usuarios de la biblioteca se lleve a cabo sobre una base de consentimiento informado, o revisar meticulosamente las opciones de la biblioteca de aplicaciones de IA de terceros para evaluar su impacto en la privacidad de los usuarios (IFLA, 2020)..