Van Noorden, Richard. 2023. «More than 10,000 Research Papers Were Retracted in 2023 — a New Record». Nature, diciembre. https://doi.org/10.1038/d41586-023-03974-8.

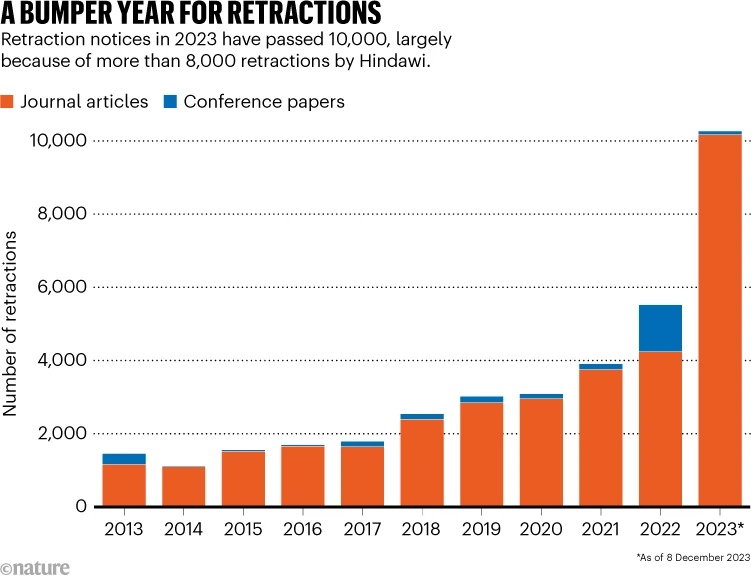

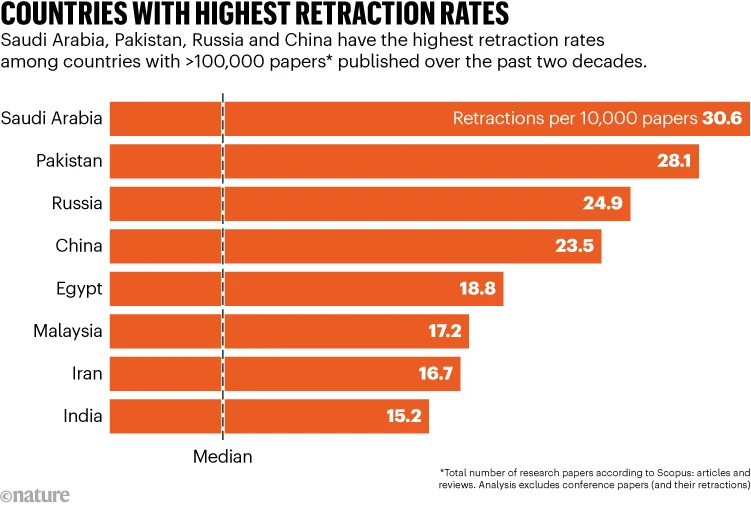

Durante el año 2023, se ha registrado un número sin precedentes de retractaciones para artículos de investigación, superando los 10,000, en medio de esfuerzos editoriales por abordar una proliferación de documentos fraudulentos y prácticas fraudulentas en la revisión por pares. Un análisis realizado por Nature revela que entre las naciones líderes en producción de investigación, Arabia Saudita, Pakistán, Rusia y China destacan por tener las tasas de retractación más elevadas en las últimas dos décadas.

El año 2023 ha experimentado un aumento significativo en la retractación de artículos de investigación, con más de 10.000 retracciones, marcando un nuevo récord. Este aumento se atribuye a los esfuerzos de los editores para abordar documentos fraudulentos y manipulación de la revisión por pares. Entre los países líderes con altas tasas de retractación en las últimas dos décadas se encuentran Arabia Saudita, Pakistán, Rusia y China. Hindawi, una subsidiaria con sede en Londres de Wiley, es responsable de la mayoría de las retractaciones en 2023, con más de 8.000 artículos retirados debido a preocupaciones sobre la revisión por pares comprometida y manipulación del proceso de publicación.

Wiley ha decidido deshacerse la marca Hindawi y ha implementado procesos más rigurosos para garantizar la integridad del proceso de publicación y revisión por pares. El editor espera una pérdida de ingresos de 35-40 millones de dólares debido a estos problemas. A pesar de ser en su mayoría artículos falsos, los documentos retirados de Hindawi fueron citados colectivamente más de 35.000 veces, indicando su impacto.

.

.

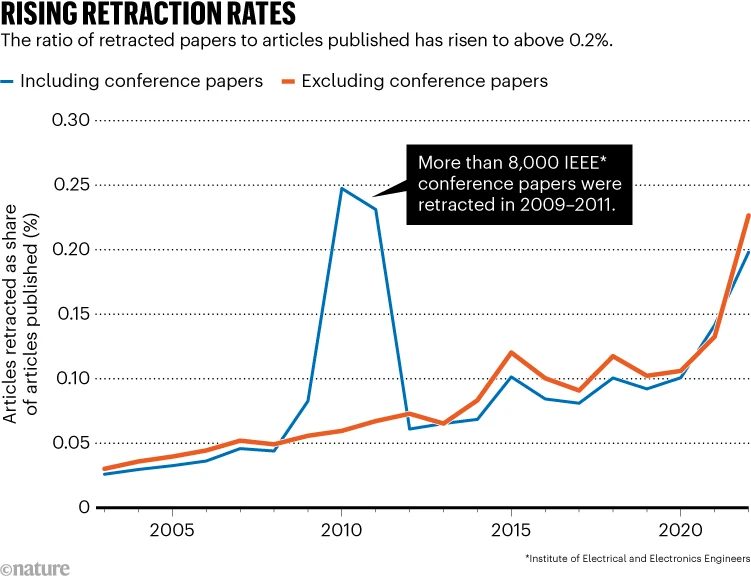

La tendencia general de retractaciones supera el crecimiento de los documentos científicos, con el número total de retractaciones superando las 50.000. El análisis de Nature sugiere que la tasa de retractación se ha triplicado en la última década, alcanzando más del 0.2% en 2022. Arabia Saudita tiene la tasa de retractación más alta entre los países que han publicado más de 100.000 artículos en las últimas dos décadas.

.

.

El análisis también revela que alrededor de una cuarta parte de las retractaciones son documentos de conferencias, siendo el Instituto de Institute of Electrical and Electronics Engineers (IEEE) líder en esta categoría. IEEE ha enfrentado críticas por problemas como el fraude de citas y el plagio en algunos de sus documentos.

.

.

Los expertos en integridad enfatizan que las retractaciones registradas son solo la punta del iceberg, con potencialmente cientos de miles de artículos de «fábricas de documentos» (empresas que venden investigación falsa) que aún no se han abordado. Estos documentos fraudulentos representan un problema, ya que pueden agregarse a artículos de revisión y integrarse en la literatura convencional.

Puntos Clave:

- Más de 10.000 artículos de investigación retractados en 2023, estableciendo un nuevo récord.

- Hindawi, una subsidiaria de Wiley, es responsable de la mayoría de las retractaciones, con más de 8.000 artículos retirados.

- Wiley discontinúa la marca Hindawi y anticipa una pérdida de ingresos de 35-40 millones de dólares.

- Las tasas de retractación están aumentando, superando el crecimiento de los documentos científicos, con un número total que supera las 50.000.

- Arabia Saudita tiene la tasa de retractación más alta entre los países que publican más de 100.000 artículos.

- El IEEE lidera las retractaciones de documentos de conferencias, con medidas preventivas en su lugar pero enfrentando críticas por fraude de citas y plagio.

- Los expertos en integridad sugieren que las retractaciones registradas son solo una fracción del problema, con potencialmente cientos de miles de documentos fraudulentos de «fábricas de documentos» aún por abordar.