Sundar, Sindhu. «How Does ChatGPT Decide What to Say next? Here’s a Quick Explainer.» Business Insider. Accedido 17 de julio de 2023. https://www.businessinsider.com/how-ai-chatbots-like-chatgpt-work-explainer-2023-7.

Como modelo de lenguaje basado en IA, ChatGPT toma sus decisiones sobre qué decir a continuación en función de su entrenamiento en un amplio conjunto de datos. Durante el entrenamiento, se expone a enormes cantidades de texto en varios dominios y aprende patrones lingüísticos y contextuales. Cuando se le presenta un nuevo texto o una pregunta, el modelo intenta generar una respuesta coherente basada en la información que ha aprendido.

ChatGPT y otros chatbots basados en inteligencia artificial pueden hablar con frases fluidas y gramaticalmente correctas que incluso pueden tener un ritmo natural. Pero, según los expertos, no hay que confundir ese discurso bien ejecutado con el pensamiento, la emoción o incluso la intención.

Según los expertos, el funcionamiento de un chatbot es mucho más parecido al de una máquina que realiza cálculos matemáticos y análisis estadísticos para invocar las palabras y frases adecuadas según el contexto. Hay mucho entrenamiento en el backend -incluso por parte de anotadores humanos que también le dan retroalimentación- que ayuda a simular conversaciones funcionales.

Los robots como ChatGPT también se entrenan con grandes cantidades de conversaciones que han enseñado a las máquinas a interactuar con usuarios humanos. OpenAI, la empresa que está detrás de ChatGPT, afirma en su sitio web que sus modelos se instruyen a partir de información procedente de diversas fuentes, incluidos sus usuarios y material del que tiene licencia.

El proceso de toma de decisiones de ChatGPT implica una técnica llamada «aprendizaje por refuerzo». Durante el entrenamiento, el modelo es recompensado cuando produce respuestas coherentes y útiles, mientras que es penalizado por generar respuestas incorrectas o incoherentes. Esta retroalimentación ayuda a ajustar los parámetros internos del modelo y mejora su capacidad de generar respuestas pertinentes.

He aquí cómo funcionan estos chatbots:

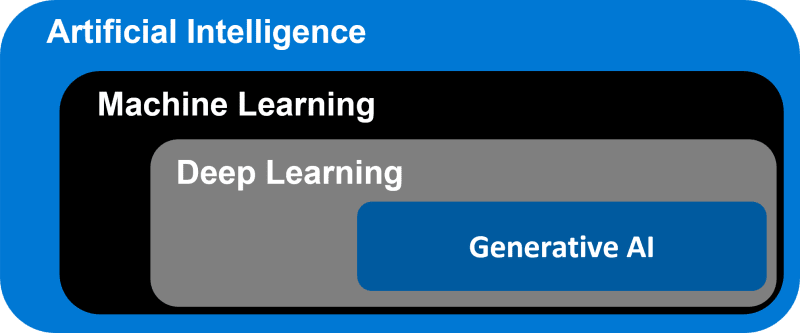

Los chatbots de IA como ChatGPT de OpenAI se basan en grandes modelos lingüísticos, o LLM, que son programas entrenados en volúmenes de texto obtenidos de escritos publicados e información en línea, generalmente contenidos producidos por humanos.

Según los expertos, los sistemas se entrenan en series de palabras y aprenden la importancia de las palabras de esas series. Así, todo ese conocimiento adquirido no sólo sirve para entrenar grandes modelos lingüísticos sobre información objetiva, sino que les ayuda a adivinar patrones de habla y cómo se suelen utilizar y agrupar las palabras.

Los chatbots también reciben formación adicional de los humanos sobre cómo ofrecer respuestas adecuadas y limitar los mensajes perjudiciales. Cuando se pide a un chatbot que responda a una simple pregunta objetiva, el proceso de respuesta puede ser sencillo: Despliega un conjunto de algoritmos para elegir la frase más probable con la que responder. Y selecciona las mejores respuestas posibles en cuestión de milisegundos y, de entre ellas, presenta una al azar. (Por eso, hacer la misma pregunta varias veces puede generar respuestas ligeramente distintas).

También puede dividir las preguntas en varias partes, responder a cada una de ellas en secuencia y utilizar sus respuestas para terminar de responder.

Pero cuidado con lo que los chatbots no saben

¿Qué pasa cuando le haces una pregunta de la que no sabe la respuesta? Ahí es donde los chatbots crean más problemas debido a una característica inherente: no saben lo que no saben. Así que extrapolan lo que saben, es decir, hacen conjeturas.

Pero no te dicen que están adivinando, sino que simplemente presentan la información como un hecho. Cuando un chatbot inventa información que presenta a un usuario como un hecho, se llama «alucinación».

«Esto es lo que llamamos conocimiento del conocimiento o metacognición», explica William Wang, profesor asociado de informática en la Universidad de California en Santa Bárbara. También es codirector del grupo de procesamiento del lenguaje natural de la universidad.