Elsevier. «The Insights 2024: Attitudes toward AI Report Reveals Researchers and Clinicians Believe in AI’s Potential but Demand Transparency in Order to Trust Tools.» 9 de julio de 2024.

El estudio de Elsevier subraya que, aunque existe un reconocimiento generalizado del potencial de la IA para transformar la investigación y la atención médica, su adopción efectiva depende de abordar preocupaciones clave relacionadas con la transparencia, la calidad del contenido y la confianza en las herramientas. Para que la IA sea plenamente aceptada e integrada en estos campos, es esencial garantizar que las herramientas sean desarrolladas y utilizadas de manera ética y responsable

El informe «Insights 2024: Actitudes hacia la IA» de Elsevier ofrece una visión detallada sobre cómo investigadores y profesionales de la salud perciben la inteligencia artificial (IA) en sus campos. Basado en una encuesta a 3,000 participantes de 123 países, el estudio revela tanto el entusiasmo por las oportunidades que brinda la IA como las preocupaciones que genera su implementación.

Potencial percibido de la IA

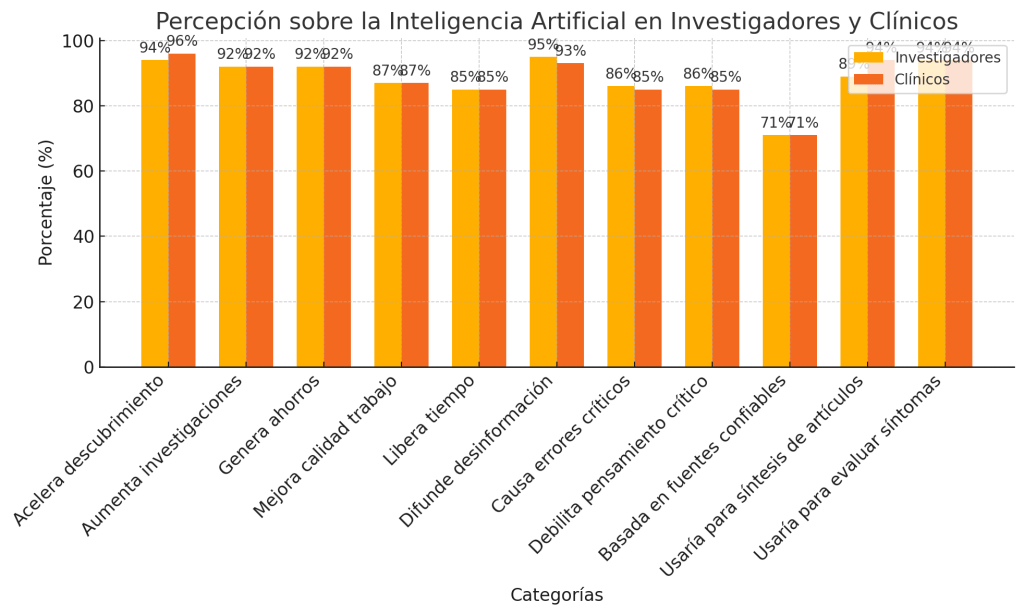

Una mayoría significativa de investigadores (94%) y clínicos (96%) cree que la IA puede acelerar el descubrimiento de conocimientos. Además, el 92% de ambos grupos anticipa que la IA aumentará rápidamente el volumen de investigaciones académicas y médicas, así como generará ahorros de costos para instituciones y empresas. El 87% considera que la IA mejorará la calidad general del trabajo, y el 85% piensa que liberará tiempo para enfocarse en proyectos de mayor valor

Preocupaciones sobre la desinformación y la confianza

A pesar del optimismo, existen inquietudes significativas. El 95% de los investigadores y el 93% de los clínicos temen que la IA se utilice para difundir desinformación. Asimismo, el 86% de los investigadores y el 85% de los clínicos creen que la IA podría causar errores críticos, y una proporción similar expresa preocupación por el debilitamiento del pensamiento crítico debido a la dependencia excesiva de estas herramientas

Necesidad de transparencia y contenido confiable

Los encuestados enfatizan la importancia de que las herramientas de IA se basen en contenido de alta calidad y confianza. El 71% espera que los resultados de herramientas dependientes de IA generativa se basen únicamente en fuentes confiables. Además, si las herramientas de IA están respaldadas por contenido confiable, controles de calidad y principios de IA responsable, el 89% de los investigadores las utilizaría para generar síntesis de artículos, y el 94% de los clínicos las emplearía para evaluar síntomas e identificar condiciones o enfermedades

Variaciones geográficas en la adopción de la IA

El informe también destaca diferencias regionales en la familiaridad y uso de la IA. Por ejemplo, en China, el 39% de los encuestados ha utilizado activamente la IA para propósitos laborales, mientras que en India esta cifra es del 22%. Solo el 11% de los participantes se considera muy familiarizado con la IA o la utiliza con frecuencia. Sin embargo, el 67% de quienes no han utilizado la IA esperan hacerlo en los próximos dos a cinco años, con China (83%) e India (79%) superando significativamente a EE. UU. (53%) en estas expectativas .